AI TRiSM(エーアイトリズム)とは何か?~AI時代に必要なフレームワーク~

昨今活用の進むAI技術ですが、一方、各国で活用に関するルールや罰則がある法令の整備が進んでいます。これらの対応に後れを取らないよう、そして組織としてAIを活用したビジネスを停滞させないためには、Gartnerが示したAI TRiSMという概念にヒントがあるかもしれません。

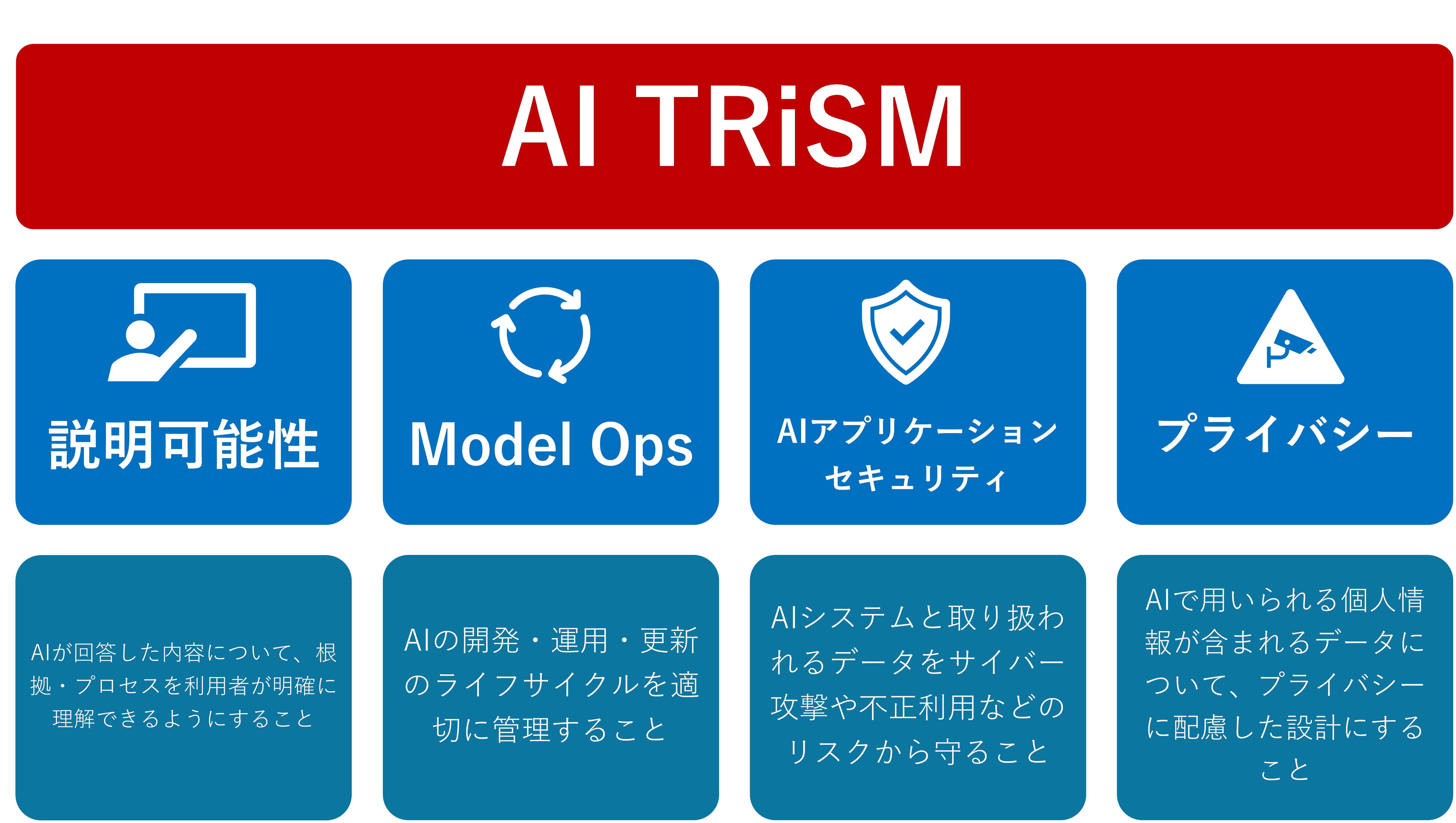

AI TRiSMとはAI TRiSMとは、2022年に米国の調査会社のGartnerにより提唱された、ビジネスにおける安全なAI開発・活用を促すための概念です。AIと、Trust(信頼)、Risk(リスク)、Security Management(セキュリティマネジメント)の頭文字を組み合わせた造語であり、サイバーリスクやプライバシーリスク、倫理面でのリスクについて焦点を当てています。Gartnerが公表した「2024年の戦略的テクノロジのトップ・トレンド」でも筆頭に挙げられている概念です。

●説明可能性:

AIが回答したり予測した内容について、その根拠やプロセスをAIの利用者が明確に理解できるようにすることです。利用者側からはそのアウトプットに至ったプロセスがブラックボックスになりがちですが、これを説明可能なAIは利用者から信頼性が向上するでしょう。以下の記事でも取り上げている通り「ハルシネーション」のリスクは、すべてのAI活用者にとって筆頭に挙げられるリスクでしょう。

参考記事:生成AIのビジネス活用と考慮すべきリスク

●ModelOps(モデル運用):

AIが活用されているビジネスモデルの価値を最大化するために、開発されたAIモデルを効率的に運用・更新を行い、開発・運用・更新のライフサイクルを適切に管理することです。

●AIアプリケーションのセキュリティ:

AIシステムそのものとAIで取り扱うデータをサイバー攻撃や不正利用などのリスクから守るための対策のことです。これまで当メディアの過去の記事でも述べてきた通り、偽情報の生成、正規の生成AIサービスを悪用したランサムウェアを作成、サイバー攻撃者がAIの悪用について常に研究している事例は、国内外問わず枚挙に暇がありません。以下の記事で過去に確認した代表的な事例を紹介していますので、ご確認ください。

また、2024年の代表的な事例では、米国のセキュリティ会社がエンジニアを採用する際に、国外のサイバー攻撃者が再採用面接時にAIを悪用した画像を用いて面接をクリアしたことが報告されています。

参考記事:

・生成AIでランサムウェアを作成した容疑者の摘発事例を考察

・生成AIとセキュリティ

・ディープフェイクとは

●プライバシー:

AIモデルで用いられるデータについて、個人情報などプライバシーに配慮した設計にすることです。これには個人情報ももちろんそうですが、組織内の機密情報など、外部に出ると悪影響がある情報全般が含まれると考えておいてよいでしょう。

AI TRiSMがなぜ重要なのか?もはや組織のDX戦略に欠かせない技術の1つであるAIですが、一方で前述したリスクが実際に被害として表出した際にはその影響度合いが大きいため、行政ではその活用のルール整備や違反した場合の罰則の検討も進んでいます。

この記事の冒頭でも、2023年~2024年の各国の規制や声明について触れています。直近では、2024年8月末、AI開発の主要地ともいえる米国カルフォルニア州の州議会で、AI開発企業に安全対策を義務付ける法案※が可決されました。また、米国商務省産業安全保障局(BIS)は9月上旬に、AI開発者に対してサイバーセキュリティ報告義務を課す規則案を発表しています。

※正式名称は「最先端人工知能(AI)システムのための安全で安心な技術革新法」。同州の司法長官が安全管理の不備を理由に、AI開発企業に差し止めを発動できる内容となっている。

日本では、まだAIについて規制を行う法律は存在していませんが、政府のAI制度研究会で制度の議論が継続しており、経済産業省と総務省から「AI事業者ガイドライン(第1.0版)」が2024年4月に公開されています。

AI開発者・提供者・利用者それぞれにあるべき姿を示した同ガイドラインでは、以下の10項目が柱となっています。

●人間中心:人間の尊厳及び個人の自律、感情操作への留意など

●安全性:人間の身体・財産・精神への配慮、適正利用・学習への配慮など

●公平性:AIモデルのバイアスへの配慮、適切なタイミングでの人間の判断の介在の必要性

●プライバシー保護:取り扱われるデータについてプライバシーを尊重し保護することの必要性

●セキュリティ確保:不正操作による意図せぬ変更や停止が生じないような対策の必要性

●透明性:検証可能性を確保しつつ、ステークホルダーに対し合理的な範囲で情報を提供する必要性

●アカウンタビリティ:トレーサビリティの確保やガイドラインの「共通の指針」対応状況について説明可能性

●教育リテラシー:AIに関わる者に対する正しい理解や利用ができるリテラシー教育の必要性

●公正競争確保:AIをめぐる公正な競争環境の維持に努めることの必要性

●イノベーション:オープンイノベーションの推進、他のAIサービスとの相互接続性・運用性への留意

現在、国内のAI関連の制度については議論が継続していますが、プライバシー関連法や制度の整備状況の経緯から見ると、欧米と同じく法制度の整備強化が進んでいくでしょう。上記のガイドライン上では、言葉の違いはあれど、AI TRiSMで柱に掲げている4つと重複する部分も多く、AIの活用を検討しているすべての組織は今からAI活用のリスク管理について準備をしておくことが、ビジネスを停滞させないためには必要です。