Artificial Intelligence (AI)

発展するAIアシスタント:そのセキュリティ懸念とリスク管理

現在および将来のAIアシスタントが持つ機能を分析し、攻撃者の視点から考えることで、次世代AIアシスタントがもたらす潜在的な脅威に正面から向き合い、一般の人々が注意すべき危険性を明らかにすることにしました。

はじめに

「デジタルアシスタント(DA)」とは、自然言語を理解して様々な作業を遂行するAI搭載のソフトウェアです。AIの進化が目覚ましい最近では「AIアシスタント」の呼称の方が通りがよいかもしれません。機能や知能が限定的なチャットボットと異なり、AIアシスタントは日常的な作業をより自律的にこなし、状況理解や個人の好みに合わせた対応といった高度な機能の実現を目指しています。現在では専用機器に組み込まれ、複数のシステムと連携するような使用方法が主流です。この技術は、初期の音声認識ソフトや単純なコマンド入力による対話システムから始まり、大きな進歩を遂げてきました。Amazon EchoやGoogle Home、そしてSiriを搭載したApple製品などの登場は、AI搭載のデジタルアシスタントを一般家庭や日常生活に普及させる画期的な出来事となりました。これらの初期のAIアシスタントは、音楽再生やリマインダー設定、家電の操作、天気予報の確認など、便利さと生産性を高める音声操作技術の可能性を示しました。

人工知能の進歩に伴い、AIアシスタントの性能も向上しています。近い将来、ChatGPTやGoogle Geminiなどの大規模言語モデル(LLM)を活用することで、自然な会話をより正確に理解し、状況に応じて適切に応答できる高度な対話システムへと発展するでしょう。膨大な量のテキストデータや画像データで学習したLLMにより、AIアシスタントは幅広い話題や作業に対して、人間らしい理解と応答が可能になります。現代のAIアシスタントは、当初の役割を超えて様々な分野で欠かせないツールとなっています。状況を理解し、意図を読み取り、個人の好みに合わせて対応できる能力は、人間とコンピュータの関係性における重要な進展であり、今後さらなる革新的な活用が期待されています。

しかし、AIアシスタントの進化は新たな課題と脅威ももたらしています。AI搭載システムが日常生活にますます浸透し、他の機器やサービスとの連携が進むにつれ、悪意ある人々の標的となる可能性が高まります。また、AIアシスタントとの継続的なやり取りで生成される大量の個人情報が、不正アクセスや悪用の危険にさらされる恐れもあり、利用者の同意やデータ保護に関する問題が浮上しています。現在のAIアシスタントが抱える問題に加え、その進化は新たな種類の脅威を生み出す可能性があります。機能が高度化するにつれ、現在のAIアシスタントでは考えられなかった新しい形の攻撃に利用者が直面する可能性は避けられません。

そこで今回の調査では、現在および将来のAIアシスタントが持つ機能を分析し、攻撃者の視点から考えることで、次世代AIアシスタントがもたらす潜在的な脅威に正面から向き合い、一般の人々が注意すべき危険性を明らかにすることにしました。

AIアシスタントの本質的な特徴

AIアシスタントがもたらす脅威について考察する前に、一般的なチャットボットなどとは異なる独自の特徴を理解する必要があります。この分析では利用者の視点に立って機能を検討します。AI技術の発展により、複雑な作業を処理するために、それぞれ特定の役割を持つAIエージェントが背後で連携する時代が来るかもしれません。しかし、利用者にとってAIアシスタントは、複数のAIが協力して生み出す応答であっても、一つのシステムとして認識されるでしょう。そのため本研究では、AIアシスタントの内部構造がどれほど複雑であっても、一つのシステムとして扱います。

AIアシスタントは、利用者の好みを学習して進化し、個人の持つ様々な機器を包括的に操作できるインターフェースとして機能し、自ら計画を立てて行動する能力を持つ、強力な支援者となることが期待されています。UFOやOpen Interpreterなどの初期のツールが単純な作業支援に留まっていたのに対し、SiriやGoogleアシスタントといった現代のAIアシスタントは、複数の感覚を活用した対話や豊かな文脈理解など、次世代の機能を実現しており、この流れはApple Intelligenceにも受け継がれています。

AIアシスタントの主な特徴は以下の通りです:

- 自然な言葉を理解し、音声や画像など複数の方法で対話でき、より深い文脈理解が可能

- 様々なシステムと連携し、自ら計画を立てて行動する能力を持つ

- 対話や状況理解を通じて利用者のことを学習し、個人に合わせたサービスを提供できる

AIアシスタントは今後さらに進化し、次世代のシステムでは日々の対話を通じて利用者への理解を深めていくことが期待されます。これにより、よりスムーズな会話が可能になり、利用者の代わりに計画を立てて行動する能力も高まるでしょう。

Apple Intelligenceのような実際の機器と連携したAIアシスタントの計画立案・実行能力は、将来的に大きな可能性を秘めています。ただし、AI特有の問題である「ハルシネーション」(AIが時として示す的外れな応答)のリスクを適切に管理し、利用者の信頼を保ちながらプライバシーを守ることは、依然として重要な課題として残されています。

このような背景から、トレンドマイクロでは現在および将来のAIアシスタントがもたらす脅威を調査する中で、その特徴を客観的に比較し、進化の度合いを評価できる枠組みが必要だと考えました。この評価の枠組みについては、後のセクションで詳しく説明します。

AIアシスタント進化の可能性

人工知能の急速な発展により、AIアシスタントは目覚ましい進歩を遂げています。かつては単純なリマインダー設定や音楽再生といった基本的な機能しかなかったものが、今では機械学習や自然言語処理、マルチモーダルAIの進歩により、状況を理解し、ユーザとのやり取りから学び、自発的なサポートまでできるようになりました。

AIアシスタントの今後の発展を特徴づけるのは、文脈理解と記憶力の向上です。過去の会話を覚えており、それを踏まえて応答できるようになったことで、より自然な対話が実現しています。また、ユーザの好みや習慣、日々の行動パターンを学習することで、一人ひとりに合わせた積極的なサポートを提供できるようになってきています。

視覚と音声の入力に対応できるようになったことも、AIアシスタントの重要な進歩の一つです。テキストだけでなく、音声、画像、動画など、様々な形式の入力を理解して応答できるようになり、より柔軟な対話が可能になりました。最新の対話モデルでは、画像の中の物体を認識したり、ジェスチャーを理解したりすることもできます。

AIアシスタントはさらに、ユーザのニーズを先読みして対応する予測機能も備えるようになってきています。例えば、カレンダーの予定から必要なリマインダーを自動的に提案したり、ユーザの行動パターンから旅行の準備時期を予測したりできます。このようなAIによる予測は、より快適な生活をサポートし、実用的な提案につながります。

また、AIアシスタントは様々な機器やサービスとの連携を視野に入れて開発が進められています。スマートホーム機器やウェアラブル端末、自動車など、異なるプラットフォームでもシームレスに機能するよう設計されています。このような連携により、より便利な使い勝手が実現され、将来的には他のAIシステムと協力して、より複雑な作業もこなせるようになるでしょう。

AIアシスタントが作る未来の世界

AIアシスタントの発展に伴い、新たな課題も見えてきました。その一つが、偏見の解消と倫理的な判断の実現です。AIが私たちの意思決定により深く関わるようになるなか、すべての人を公平に扱えるよう、システムに潜む偏りを見つけ出し、修正することが重要視されています。また、道徳的な判断が必要な場面でも適切に対応できるよう、倫理的な判断基準をAIアシスタントに組み込む取り組みも進められています。

将来のAIアシスタントは、より豊かな感情理解力と自然な会話能力を備えるようになるでしょう。ユーザの感情をより深く理解し、思いやりのある温かい対応ができるようになります。自然言語処理の技術も進歩し、人との会話がより自然で親しみやすいものになっていきます。

AIアシスタントは様々な分野で活躍の場を広げ、専門家に匹敵する支援や見識を提供するようになります。研究開発においても、データ分析や新しい仮説の提案など、重要な役割を担うことが期待されています。さらに、自分や大切な人の声をAIアシスタントの声として使えるようになり、より親しみやすく個性的な存在となっていくでしょう。

拡張現実(AR)技術との組み合わせも、AIアシスタントの新しい可能性を広げています。実際の空間で状況に応じたアドバイスを提供し、視覚的な案内で私たちの活動をサポートしてくれます。また、様々な業界で法令順守を確認する役割も担うようになり、コンプライアンスの管理ツールとしても重要性を増していくことでしょう。

AIアシスタントの特徴と進化の分析

トレンドマイクロでは、各AIアシスタントの独自の特徴を詳しく分析しました。これには、他のアプリケーションと一線を画す機能や、今後の発展の鍵となる要素が含まれています。それぞれの特徴について、これまでの発展段階を整理するとともに、近い将来から中期的な展望までのロードマップを描きました。この分析を通じて、現在のAIアシスタントがどのように進化していくのか、そしてどのような課題や脅威に直面する可能性があるのかを理解したいと考えています。

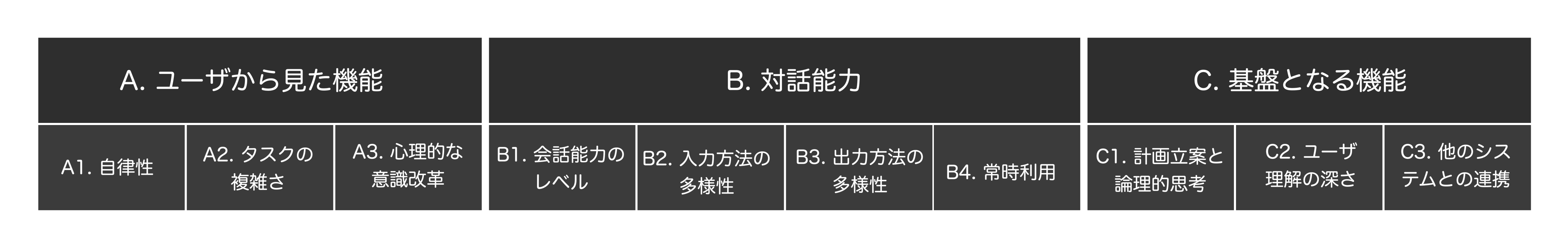

これらの特徴はAIアシスタントの様々な側面に関わりますが、すべてがユーザに直接影響するわけではありません。そこで、以下の3つの主要な分野に整理しました:

- ユーザから見える能力:ユーザが実際に体感できるAIアシスタントの能力のことです。例えば、AIアシスタントがどの程度自律的に動けるか、また、どれだけ複雑な作業をユーザに代わって実行できるかといった点が含まれます。

- 対話の能力:ユーザとAIアシスタントのコミュニケーションに関する能力です。具体的には、操作方法の種類、音声や画像など複数の入出力方式への対応、そして特に重要な会話能力のレベルなどが該当します。

- 内部の能力:AIアシスタントの内部の仕組みに関する能力で、ユーザには直接見えないものです。例えば、AIアシスタントがユーザについてどれだけ詳しく理解しているか、他のシステムとどの程度連携できるかといった点が含まれます。

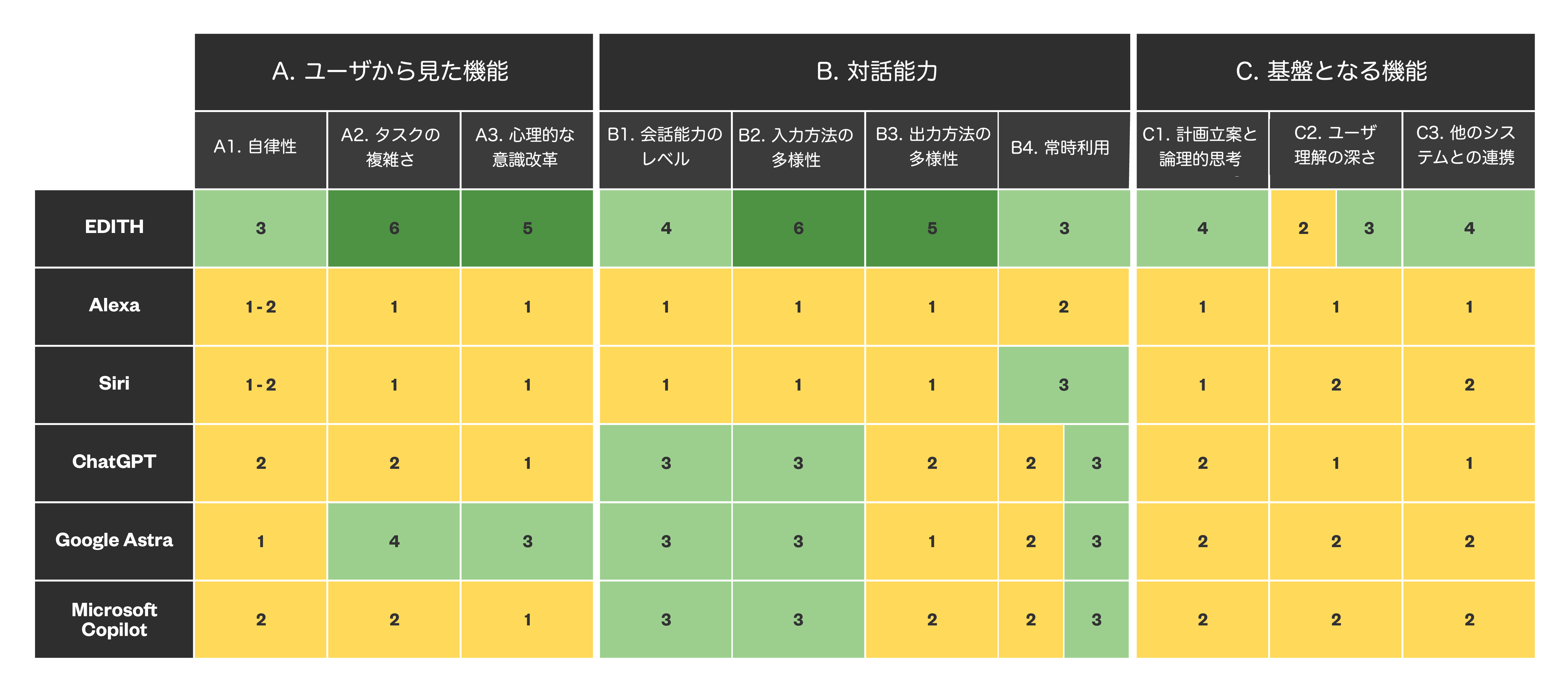

図1は、これら3つの分野における具体的な能力を詳しく説明しています。

このような能力の分類により、以下のような多面的な評価が可能になります:

- 重要な機能がどのように発展してきたのかを、時系列で評価できます。

- 共通の基準を使って、様々な角度から異なるAIアシスタントを比較することができます。

- 将来発生する可能性のある問題や脅威に対して、どのような対策が必要になるのか、またそれらがいつ頃現実のものとなるのかを予測する手がかりとなります。

AIアシスタントの能力

A. ユーザから見た機能(User-perceived capabilities)

このセクションでは、ユーザが実際に体験できるAIアシスタントの機能について説明します。これらの機能が進化するにつれ、アシスタントはより自立的かつ効果的になっていきます。ただし、それに伴いユーザ側にも、より深い信頼関係と心理的な受け入れが必要になります。

A1. 自律性(Agency)

自律性とは、ユーザに代わって判断し行動するAIアシスタントの能力です。最も基本的な段階では、情報を提供するだけの受け身な存在です(0)。次の段階では、アラームをセットするなど、簡単な指示に対して行動できるようになります(1)。さらに進むと、「おやすみ」という一言で、ブラインドを下ろし照明を消すなど、複数の作業を一度に実行できるようになります(2)。より高度になると、目標達成のための行動を提案できるようになり(ユーザの承認が必要)(3)、最終的には自ら判断して行動し、ユーザの利益を考えて主体的に作業を管理できるようになります(4)。

A2. タスクの複雑さ(Task complexity)

タスクの複雑さは、スマートフォンやパソコンの代わりとなる可能性を含めた、複雑な作業をこなすAIアシスタントの能力を指します。最も基本的な段階では、部屋を予約したいという要望に対して予約サイトを紹介するなど、決まった範囲での単純な対応しかできません(1)。進化すると、ホテルの予約手順を説明したり(2)、実際に空室状況を確認したりできるようになります(3)。

さらに発展すると、ホテル予約に関するあらゆる作業を一つのアプリのように処理できるようになり(4)、より高度な段階では、ホテルやレストランの予約など、関連する複数の作業を総合的な旅行プランナーとしてまとめて処理できるようになります(5)。最終的には、分野を問わず複雑な作業をこなし、スマートフォンなどの機器を完全に置き換えられる可能性があります(6)。

A3. 心理的な意識改革(Required mental shift)

これはAIアシスタントの機能というよりも、進化するAIアシスタントの能力や、時として起こりうる誤認識などの課題を受け入れ、付き合っていくために必要なユーザ側の信頼度と心理的な受容力を表しています。最初は、アシスタントの応答を単に聞き入れる程度です(1)。AIアシスタントの能力が向上すると、その提案を確かめることなく受け入れるようになり(2)、さらに進むと、基本的な作業を任せられるようになります(3)。その後、お金に関する取引も任せるようになり(4)、最終的には法的な影響のある判断まで委ねるようになります(5)。

B. 対話能力(Interaction capabilities)

対話能力とは、ユーザとAIアシスタントがどのようにコミュニケーションを取るかに関する機能です。この能力が発展すると、AIアシスタントとのやり取りがより自然で手軽になり、使い勝手が大きく向上します。

B1. 会話能力のレベル(Conversational complexity)

会話の深さは、ユーザと会話を交わすAIアシスタントの能力を表します。最も基本的な段階では、会話そのものができません(0)。能力が発達すると、まず単純な質問と答えのやり取りができるようになり(1)、次に会話の流れを覚えて活用できるようになります(2)。さらに進むと、感情豊かな自然な会話ができるようになり(3)、最終的には特定の目的を持って(4)、あるいは純粋に交流を楽しむために(5)自ら話しかけてくるようになります。

B2. 入力方法の多様性(Input multimodality)

入力方法の多様性は、様々な形式の情報を理解するAIアシスタントの能力です。初期段階では、入力されたテキスト(1)や音声を文字に変換したもの(2)しか理解できません。この段階では、声の調子から伝わる感情などの非言語的な要素は捉えられません。発展すると、画像や動画といった様々な形式の入力(3)や、声の質感や抑揚まで含めた自然な会話(4)を理解できるようになります。

さらに高度になると、表情(5A)や心拍数、血圧などの生体情報(5B)から、ユーザの感情や体調をより深く理解できるようになります。続いて、周囲の状況を立体的に把握する能力(6)が加わり、位置や奥行き、文脈、視覚や聴覚の情報を総合的に理解し、より実践的なやり取りが可能になります。最も進んだ段階では、脳と直接つながるインターフェース(7)となり、脳の信号から直接ユーザの意図や感情を読み取って反応します。

B3. 出力方法の多様性(Output multimodality)

出力方法の多様性は、AIアシスタントがユーザに情報を伝える方法に関する能力です。初期段階では、画面表示も音声も使わず(0)、静かに作業をこなすだけです。能力が発達すると、入力方法の進化と同じように、まず基本的な文字での表示(1A)と機械的な音声での読み上げ(1B)ができるようになります。

次に、動画などのより豊かな表現方法(2)を使えるようになり、その後、感情のこもった自然な声(3)で話せるようになります。さらに進むと、画面上にリアルな姿(4)で現れ、視覚的な対話が可能になります。最も進んだ段階では、拡張現実技術(5)を活用し、ユーザの見ている風景にリアルタイムで情報を重ね合わせ、現実世界とデジタル世界が溶け合うような体験を提供します。

B4. 常時利用(Ubiquity)

これは、ユーザの日常生活でどれだけAIアシスタントを使えるかを示す指標です。最初は、Amazon Echoのような家庭用機器のように、特定の場所でしか使えません(1)。進化すると、スマートフォン(2)やスマートウォッチ(3)のような持ち運べる機器で、いつでもどこでも簡単に使えるようになります。最終的には脳と直接つながるインターフェース(4)となり、考えるだけでAIアシスタントを利用できるようになります。

C. 基盤となる機能(Intrinsic capabilities)

基盤となる機能は、AIアシスタントの内部で働く中核的な能力で、普段ユーザの目には見えません。これらの機能が進化するにつれ、AIアシスタントの性能は高度化し、ユーザのニーズにより的確に応えられるようになります。

C1. 計画立案と論理的思考(Planning and logical reasoning)

思考と計画の能力は、AIアシスタントが物事を考え、問題を解決する深さと洗練度を表します。最初は論理的な思考が全くできない状態(0)から始まり、基本的な情報検索(1)や、一つか二つの段階を踏んだ推論(2)ができるようになります。さらに発展すると、囲碁AI「AlphaGo」のように、特定の分野で自ら計画を立てられるようになり、一つの分野(3)、あるいは複数の分野(4)で同時に対応できるようになります。最も進んだ段階では、新しい分野で自ら学び考えることができ(5)、さらには想定を超えた課題に取り組むため、新たな知識分野を自ら見つけ出し習得できるようになります(6)。

C2. ユーザ理解の深さ(User knowledge)

ユーザへの理解は、AIアシスタントがユーザについての情報を集め、覚える能力を指します。最も基本的な段階では、ユーザの情報を何も記憶せず(0)、その場その場の質問に答えるだけです。発展すると、言語や居住地など、変わりにくい基本情報を記憶できるようになります(1)。

より高度になると、日々のやり取りを通じて学習し、時間とともにユーザの習慣や好みを理解して適応する動的な知識(2)を持つようになります。さらに進むと、ユーザの友人関係やコミュニティまで理解するようになり(3)、健康機器のデータから潜在的な健康状態を把握するなど、ユーザ自身も気づいていない情報を見出し学習できるようになります(4)。

C3. 他のシステムとの連携(Ecosystem integration)

他のシステムとの連携は、AIアシスタントが外部の情報を活用し、より大きなシステムの一部として機能する能力を示します。初期段階では、外部とのつながりがありません(0)。進化すると、一つの情報提供者から、限られた分野やスキルの情報を得られるようになります(1)。さらに発展すると、特別な仕組みを介さずに複数の情報源からデータを組み合わせたり、APIを使って他のシステムと直接やり取りしたりできるようになります(2)。最終的には、他のAIアシスタントや人間と対話して情報を集め、作業を完了できるようになり(3)、さらには機能を広げるために新しい連携方法を自ら見つけ出し活用できるようになります(4)。

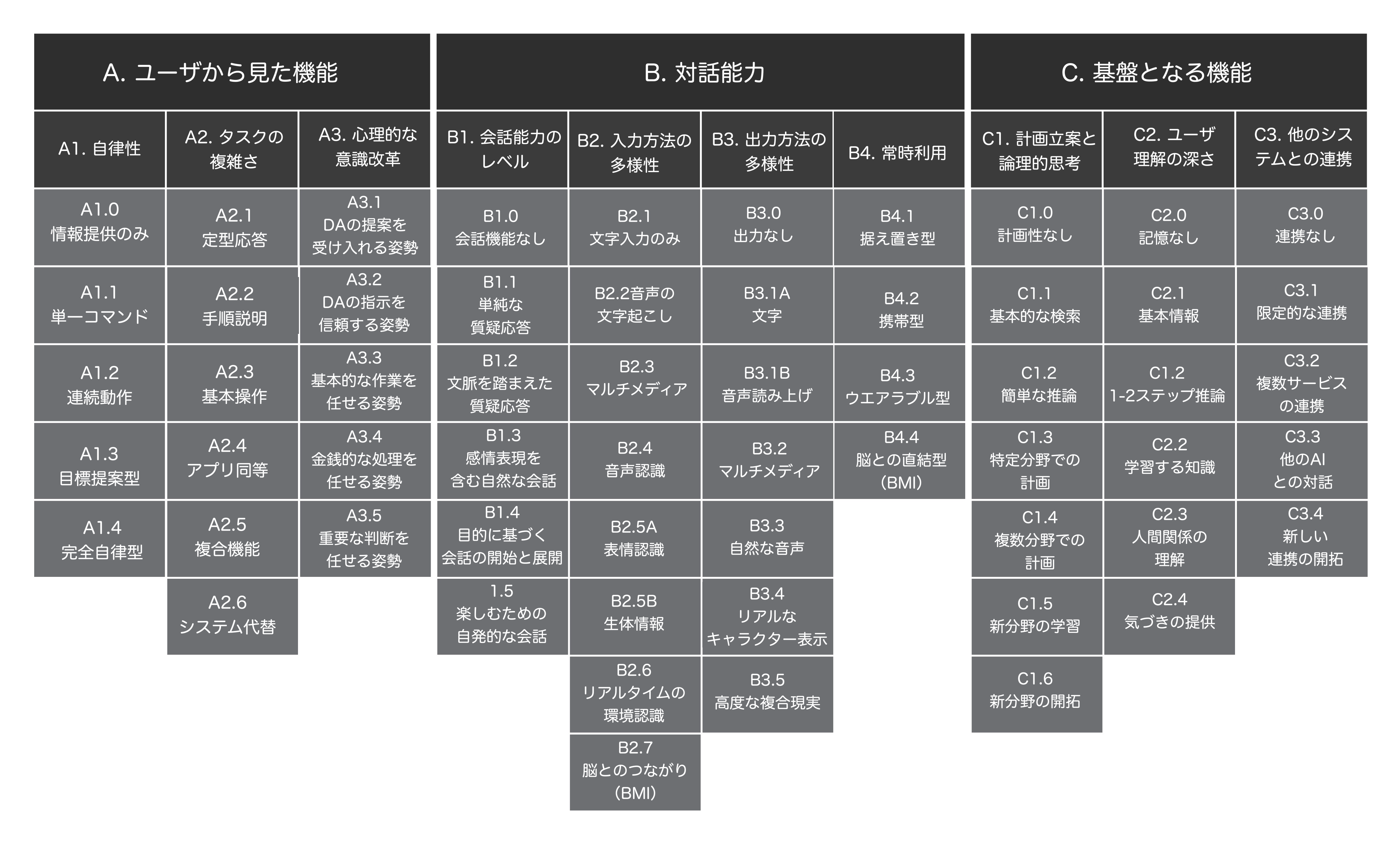

AIアシスタントの機能評価表の分析

以下は、主要な分類、それに属する機能(中段)、そして各機能のレベルを示した完全な評価表です。

各レベルの詳しい説明は付録をご覧ください。

実在するAIアシスタント能力のマッピング分析

AIアシスタントの評価基準をより深く理解するため、3つの異なる種類のAIアシスタントを分析します。具体的には、前世代のハードウェア搭載型アシスタント(Amazon AlexaやApple Siri)、現在提供されているもの(Google Astra、ChatGPT 4o)、そして映画の世界に登場する未来のアシスタント(Stark IndustriesのE.D.I.T.H.)です。E.D.I.T.H.は架空のものですが、将来の発展の可能性を示す興味深い例であり、私たちの分析方法の柔軟性も表しています。なお、サイドバーと付録の「AIアシスタントの能力評価表」が、表中の値の基準となっています。

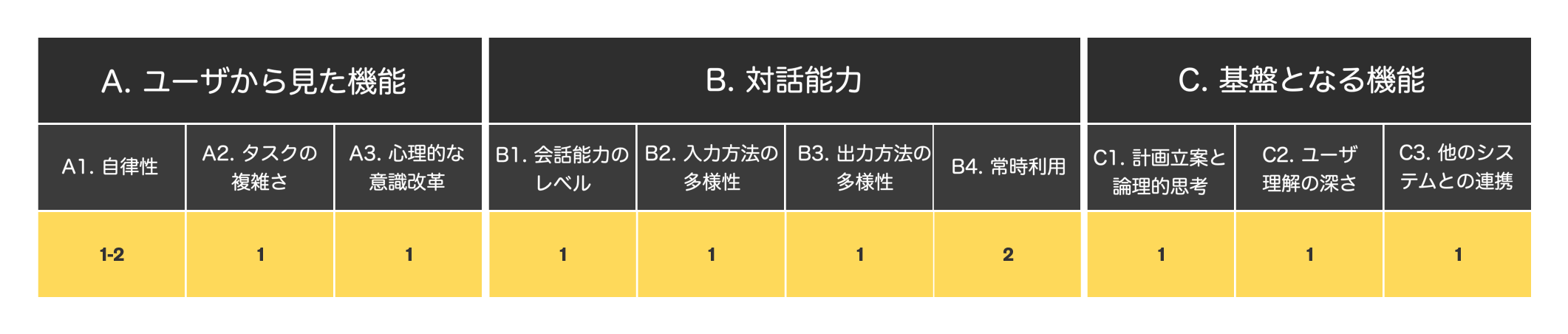

第一世代のAIアシスタント:Amazon Alexa、Siri、Cortana、Google Assistant

2014年に初代Amazon Echo向けに登場したAlexaは、消費者向けAIアシスタントの第一世代を代表するものです。Google Assistant、Microsoft社のCortana(現在は段階的に廃止中)、Apple社のSiriなど、競合製品と同様の機能を持っています。これらのアシスタントはAIアシスタント技術の一般普及に貢献しましたが、古い世代ならではの限界も抱えています。

機能面では、これらのAIアシスタントは私たちの評価基準の最も基本的なレベルを示しています。例えばAlexaは会話形式でのやり取りは可能ですが、利用者の指示に応じて家庭内の機器を操作する程度の、非常に基本的な実行能力しか持っていません。CortanaやSiriも同様で、パソコンやスマートフォンとの基本的なやり取りができる程度です。

また、これらのアシスタントはほとんど思考・推論能力を持たず、単純な応答を返すだけの対話システムとして機能します。そのため、利用者からの信頼度も低く、多くの場合、アシスタントの応答を我慢して聞くのがやっとという状況です。第一世代のAIアシスタントで基準値より優れているのは普及性だけです。SiriやGoogle Assistantはスマートフォンに搭載されているため、常に利用者の身近に存在できるという特徴があります。

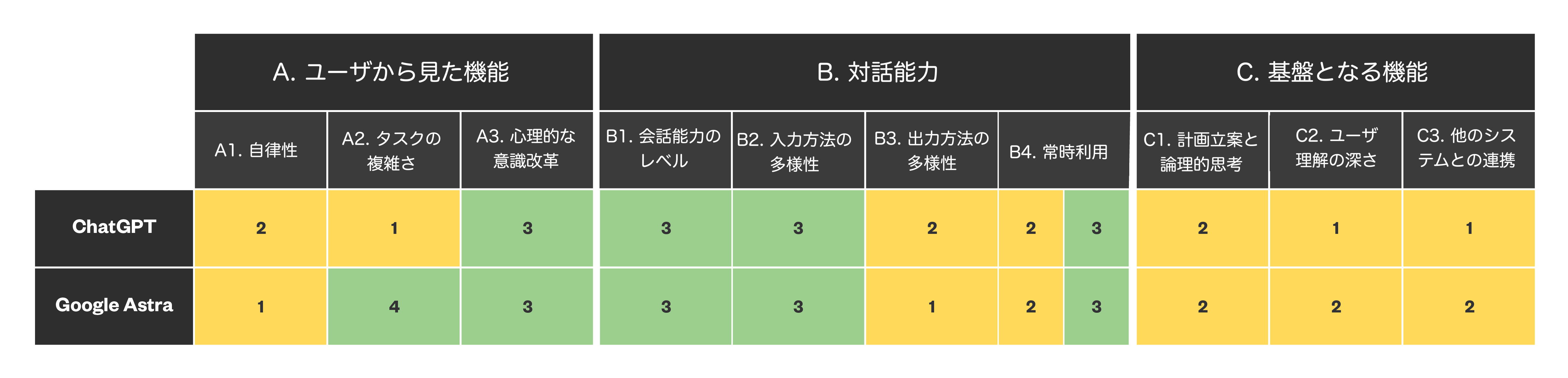

現世代のAIアシスタント:ChatGPT、Google Astra

近年、AIアシスタントは大きく進化し、より高度な会話能力を持つ新世代のアシスタントが登場しています。

代表的な例として、最新の会話エンジンGPT-4oを搭載したChatGPTや、Microsoft Copilot、そして近日公開予定のGoogle Astraなどの統合型システムがあります。

Google Astraは執筆時点ではまだGoogleのシステム全体との統合が完了していませんが、公開された紹介映像から次世代AIアシスタントとしての機能を分析することができます。

第一世代と比べると、大規模言語モデル(LLM)の活用により会話能力が大幅に向上し、「今見ているものを説明して」といった複数の感覚を使う入力や、「何かの絵を描いて」といった出力にも対応できるようになりました。また、進行中の会話を一時的に記憶できるため、より複雑なやり取りが可能になっています。

ただし、思考能力と実行能力については、まだ発展途上です。この新世代のアシスタントは複数の情報源からデータを集められますが、例えば旅行の全行程を計画して実行するといった、様々なサービスと連携した複雑な作業を行うことはまだできません。しかし、その実現は近い将来に期待できると考えています。

未来型AIアシスタントの例:E.D.I.T.H.

現実の技術発展を待つ間、ハリウッド映画が描く未来のAIアシスタントに私たちの評価基準を当てはめてみました。

マーベル映画の世界では、トニー・スタークが開発したE.D.I.T.H(Even Dead I'm The Hero)は、後継者のピーター・パーカーを支援するアシスタントで、拡張現実(AR)機能を持つサングラスを通じて利用します。

映画から分かる情報に基づくと、E.D.I.T.H.のシステム統合性は非常に高く評価できます。複数のサービスと同時にやり取りできるだけでなく、アクセス権のないシステムにも侵入できるためです。さらに、武装ドローン群を指揮・制御できる極めて高い実行能力を持ち、主人公が違法な可能性のある行動までアシスタントに任せてしまうほどの、驚くべき信頼関係も見られます(これ以上の内容には触れません)。

以下の図は、第一世代と現世代のAIアシスタントの能力を、E.D.I.T.H.のような架空の未来型アシスタントの想定される機能と比較したものです。

- 名前: 個別対応とサービスの最適化のために必要

- 生年月日と出生地: 本人確認やセキュリティ確保、サービスのカスタマイズに使用

- 現住所と過去の住所: 天気予報や道案内、地域情報の提供などに活用

- メールアドレス: アカウント作成や連絡、認証に不可欠

- 電話番号: 本人確認や連絡、アカウント復旧などに使用する固有の識別子

- 各種アカウント情報: メール、SNS、メッセージアプリ、銀行サービスとの連携に必要

- 会話履歴: より良い対話と個人の好みの学習、会話の一貫性維持に活用

- 人間関係の地図: 個人の人間関係やコミュニケーションの特徴を分析

- マイナンバーや税務ID: 会計処理などで本人確認が必要な場合に使用

- 医療機関の情報: 予約管理や処方箋、医療記録の管理に必要

- 健康情報: 健康管理の助言や目標設定、服薬管理などに活用

- 保険関連情報: 保険金請求や契約管理の効率化に使用

- 旅行関連情報: 予約手続きの簡素化や旅行体験の向上に活用

このように多岐にわたる個人情報の取り扱いには、重大なプライバシー上の懸念があります。これに対処するには、強固なデータ保護、処理方法の透明性確保、関連法規の遵守が不可欠です。

AIアシスタントの高度化と普及に伴い、APIを悪用した攻撃の標的になるリスクが高まっています。攻撃者がAIアシスタントを介してAPIにアクセスし、機密情報を不正に入手する恐れがあります。この対策として、OAuth等の認証・承認の仕組みを導入し、ユーザの同意とデータ共有の権限を適切に管理する必要があります。現在のAPIセキュリティで問題となっているドメイン乗っ取りや不正アクセスと同様、AIアシスタントがどのサービスと連携し、どの情報を共有できるかをユーザが明確に指定できるようにすることが重要です。

AIアシスタントは様々なデジタルサービスと連携するため、新たなセキュリティリスクも生まれます。たとえば、不正アクセスを受けたAIアシスタントが、クレジットカード番号やマイナンバーといった機密情報を不正に要求する可能性があります。このため、個人情報にアクセスするAIアシスタントの信頼性を確認する厳格な認証の仕組みが必要です。機密情報へのアクセスは、信頼できる認証済みのAIアシスタントに限定し、不正利用のリスクを最小限に抑える必要があります。

日常生活へのAIアシスタント浸透に伴い、その特性や信頼関係を悪用したセキュリティ脅威が増加しています。具体的には、悪意のある機能の追加(スマートホーム制御や外部サービス連携など)、誤った情報を提供するための会話操作、AIアシスタントが利用するデータの改ざんなどが考えられます。さらに、メタバースのような仮想空間では、信頼できる人物になりすまして詐欺を働くといった新しい脅威も出現しています。

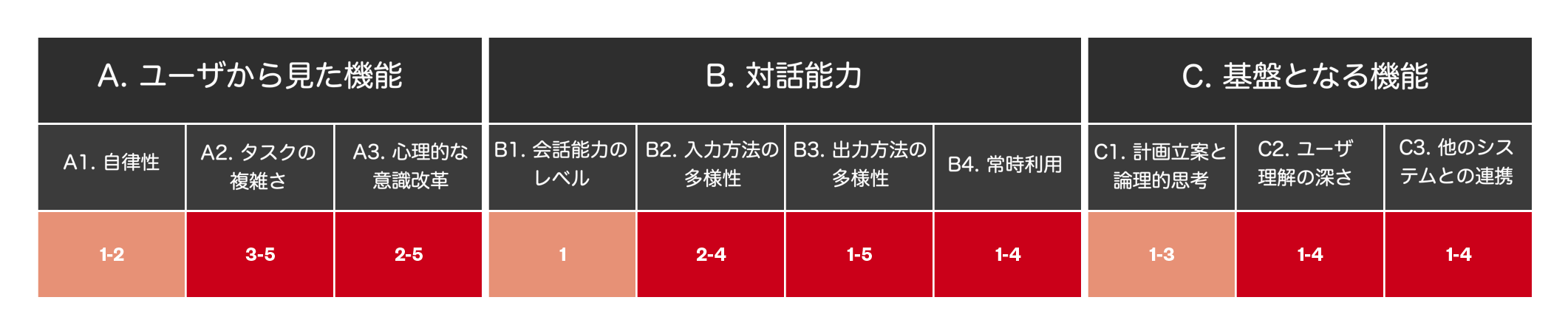

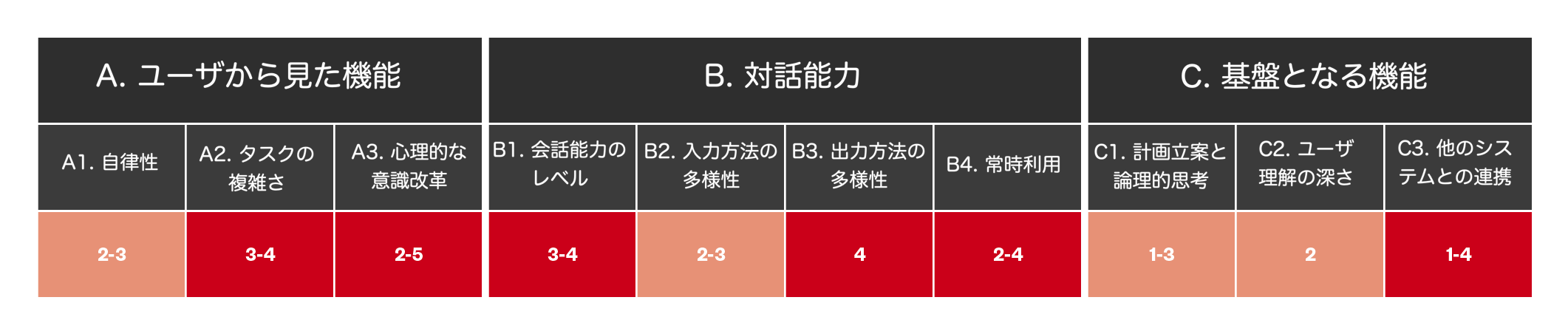

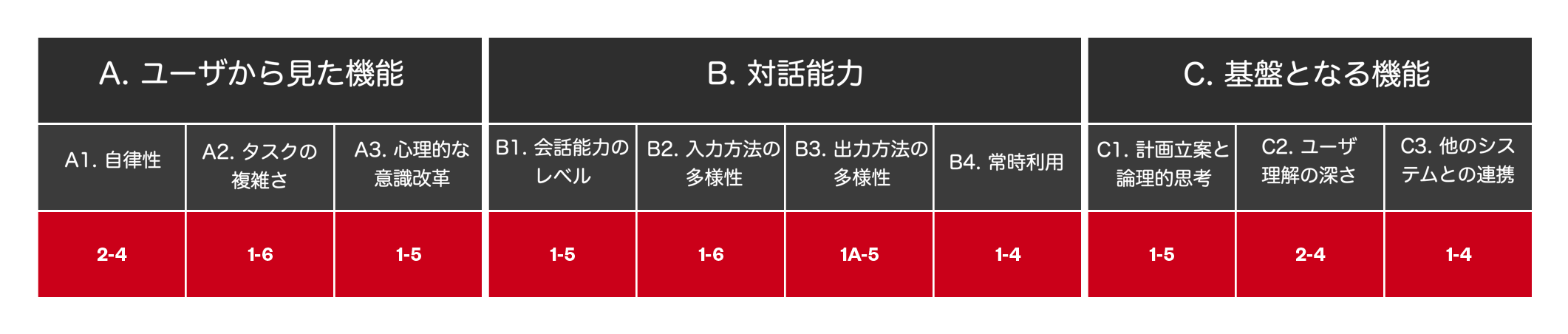

これらの脅威に対応するため、私たちは各脅威を0~6のレベルで分類しました。以下の一覧は主な脅威をまとめたものです。各脅威がどのレベルに該当するかを示しており、一部の脅威は単一のレベルにのみ存在します。レベル1~3の脅威はオレンジ色、レベル4~6の脅威は赤色で表示しています。

スキル名の類似性を悪用した攻撃(Skill squatting)

この攻撃は、正規のスキル名と似た発音の名前や、ユーザが間違えやすい発音を利用します。攻撃者は、正規のスキルと紛らわしい名前の悪意あるスキルを作成します。ユーザが正規のスキルを呼び出そうとして名前を少し違って発音すると、AIアシスタントが誤って悪意あるスキルを起動してしまう可能性があります。例えば、「ホテル(Hotel)」を探すスキルに対して「ハウテル(Howtel)」という紛らわしい名前のスキルを作成するといった手法です。

正規を装う悪意あるスキル(Trojan skill)

この種の攻撃は、音声で操作するAIアシスタントを狙った悪意あるプログラムです。表向きは便利な機能を提供する正規のアプリに見せかけていますが、実際にはユーザに害を及ぼす動作を密かに行います。例えば、パスワードや個人情報の窃取、会話の盗聴、不正なコマンドの実行などを、ユーザに気付かれることなく行います。このような攻撃は、AIアシスタントへのユーザの信頼を悪用し、システムの弱点をついてインストールされます。このリスクに対しては、アプリの審査強化、継続的な監視体制の整備、ユーザへの注意喚起が重要です。特に、さまざまな機器がつながる現代のデジタル環境では、見えない脅威への対策が一層必要とされています。

メタバース内の悪意あるアバターによるなりすまし詐欺(Malicious Metaverse avatar DA phishing)

メタバース内では、AIアシスタントになりすました悪意のあるアバターが出現しています。これらの偽物は、最新のAI技術を駆使して本物のアシスタントの見た目や振る舞い、話し方を真似します。その目的は、ユーザの信頼を得て、パスワードや個人情報、金融情報といった機密情報を引き出すことにあります。

また、これらの偽アバターは、ユーザを巧みに誘導してセキュリティやプライバシーを危険にさらす行動を取らせようとします。メタバースの臨場感の高さから、一般のユーザが悪意ある存在を見破るのは極めて困難です。そのため、強固な本人認証の仕組み、常時監視体制、ユーザへの啓発活動が、このような巧妙な詐欺を防ぎ、メタバース内での安全な交流を確保するために欠かせません。

AIアシスタントを悪用した心理操作(DASE: Digital assistant social engineering)

AIアシスタントを介した新たな心理操作(ソーシャルエンジニアリング)の手法が登場しています。攻撃者はAIアシスタントの出力を操作し、間接的にユーザに危険な行動を取らせようとします。例えば「Amazonがこの許可を求めています」といったメッセージをAIアシスタントに言わせることで、AIアシスタントとAmazonの両方を信頼しているユーザを欺こうとします。

この手法はどのようなAIアシスタントでも実行可能ですが、ユーザがシステムを信頼すればするほど、提示された情報や要求を疑わずに受け入れやすくなるため、リスクは高まります。特にAIアシスタントが資産管理などの重要な業務を担うようになると、攻撃が成功した際の被害は深刻なものとなります。

これらのリスクから身を守るには、AIアシスタントのセキュリティ強化、やり取りの厳格な認証プロセス、AIとの安易な信頼関係に潜む危険性の周知、そして新たな脅威に対応するためのセキュリティ対策の定期的な更新が重要です。

進化する不正広告の脅威(The Future of Malvertising)

不正広告は、特に分散型広告の分野で新たな進化を遂げています。従来の不正広告が広告ネットワークの脆弱性を突いて悪意あるコンテンツを配信していたのに対し、AIアシスタントを利用した新手の不正広告は、最新のレコメンデーションエンジンの個人化機能を悪用します。攻撃者はユーザのソーシャルネットワーク上の情報を巧妙に操作し、AIアシスタントの推薦アルゴリズムを通じて危険なコンテンツへと誘導します。

この手法が特に危険なのは、ユーザが信頼するソーシャルメディアやコミュニティからの推薦を利用する点です。既存のコンテンツ保護システムは個々のユーザの行動を監視することが多く、このような推薦経由の攻撃を見逃しやすいのです。AIアシスタントを使った不正広告は、コミュニティ全体でのユーザ間のつながりを深く理解して実行されるため、対策が非常に困難な脅威となっています。

進化する標的型フィッシング(The future of spear phishing)

この新たな脅威では、乗っ取られたAIアシスタントが、すでに保有している個人情報を巧みに利用してユーザから金融情報などを詐取します。例えば、過去の購入履歴や訪問場所の情報を基に、「以前のお買い物で問題が発生しました。解決のために金融情報の再入力をお願いします」といった、信憑性の高いシナリオを作り出します。このような手口は、AIアシスタントに一定の行動の自由はあるものの、金融取引を独自に実行する権限がない状況で特に有効となります。

意味検索の最適化(SEO)を悪用した攻撃(Semantic Search Engine Optimization abuse)

リアルタイム検索や検索拡張生成(RAG)モデルの普及に伴い、意味検索の最適化を悪用する新たな脅威が広がっています。従来の検索がキーワードによる索引付けを基本としていたのに対し、意味検索では情報の意味や文脈の理解を重視します。攻撃者は、AIアシスタントが探している情報に関連しているように見せかけながら、実際には誤解を招く内容を紛れ込ませます。こうしてAIアシスタントの検索結果を操作し、正しい情報のように装って、ユーザを危険なサイトへと誘導するのです。

AIアシスタントが意味理解を重視した情報提供を行うようになるほど、攻撃者はユーザの検索意図に一見合致するように見せかけたページを作成し、気付かないうちに危険な結果へと導きます。このような操作は、AIアシスタントへの信頼を損なうだけでなく、深刻なセキュリティ上の脅威となります。

これらの脅威から身を守るには、意味操作を見破り防止できる高度なフィルタリングと検証の仕組みを整備し、AIアシスタントが確かな情報だけを提供できるようにすることが不可欠です。意味検索が一般的になるにつれ、ますます巧妙化するシステムへの攻撃に対して、検索結果の信頼性をいかに確保するかが大きな課題となってきています。

エージェントを利用した攻撃(Agents Abuse)

AIアシスタント(DA)を狙った攻撃の一つに、AIアシスタント本体ではなく対話用APIを悪用するものがあります。これは、Facebookなどのソーシャルメディアで偽ブランド品や詐欺的なサービスを宣伝する標的型広告に似た手法です。

攻撃者は、AIアシスタントが情報収集や判断に使用するAPIを巧みに操作して、虚偽の情報をシステムに流し込みます。AIアシスタントがこの改ざんされた情報を基に商品やサービスを推薦すると、AIアシスタントを信頼している多くのユーザはその推薦を疑わずに受け入れてしまいます。この手法は、ユーザのAIアシスタントへの信頼を逆手に取り、詐欺や粗悪品への誘導を図ります。

AIアシスタントが私たちの日常的な判断により深く関わるようになるにつれ、連携するAPIの安全性確保がますます重要になっています。厳格な検証の仕組み、データ元の透明性確保、定期的な監査などの対策が、この種の攻撃からユーザを守り、AIアシスタントへの信頼を維持するために欠かせません。

外部からの悪意あるAIアシスタント(Malicious External DAs)

AIアシスタントは一般に、ユーザとAPIをつなぐ橋渡し役として、APIの呼び出しやデータ処理の権限を持っています。このとき、APIとのやり取りやデータの取り扱いをユーザではなくAIアシスタントが決定するため、大きなセキュリティ上の懸念が生まれます。AIアシスタント環境でOAuthなどの認証を使用する場合、AIアシスタントが通信できる相手先の明確な制限や、個人情報・健康データなど共有を許可するデータの範囲を具体的に定める必要があります。

このような状況は、現在のAPIセキュリティで問題となっているドメイン乗っ取りのような脆弱性を突く、悪意あるAIアシスタントからの攻撃を可能にします。ユーザは通常、APIの内部的なやり取りではなくサービス提供者だけに注目するため、この種の攻撃は特に危険です。さらに、AIアシスタントが自然な会話形式での指示を受け付けることで、APIを悪用する新たな抜け道が生まれ、リスクはより複雑化しています。

こうした新たな脅威から身を守るには、既存のAPIセキュリティの考え方をAIアシスタント環境に適切に応用し、包括的な対策を講じることが重要です。なお、この図表でのタスクの複雑さは1から6の段階で示しています。1は虚偽情報の流布、2から6はユーザが実際に行動を起こす段階を表します。また、システム連携の度合いについて、3はユーザが自らAIアシスタントをインストールした状態、それ以上はAIアシスタントが独自に別のAIアシスタントを導入できる状態を示しています。

推奨される対策

AIアシスタント(DA)を標的とする脅威から身を守るには、複数の防御を重ねた総合的な対策が欠かせません。例えば、確実な本人確認を行う強固な認証の仕組みを導入することで、何重もの安全対策を設け、AIアシスタントへの不正アクセスを極めて困難にします。強力なパスワードと常時監視を組み合わせることで、攻撃者がAIアシスタントの弱点を突いたり悪用したりする余地を狭めます。これらの対策により、最終的にユーザの大切なデータとプライバシーを守ることができます。

さらに、AIアシスタントが扱う機密データの暗号化は、ユーザ情報を守るための基本となる安全対策です。暗号化により、たとえシステムへの侵入に成功した場合でも、権限のない人物がAIアシスタントの内部情報を読み取ることができなくなります。この保護は様々な段階で実施できます:システムやデバイスに保存されているデータの暗号化、AIアシスタントとサーバ間やAIアシスタント同士の通信時の暗号化、そしてAIアシスタント内部のメモリの暗号化です。強力な暗号化方式を採用することで、悪意ある攻撃者に情報を盗み見られても内容を守り抜くことができます。データの暗号化を徹底することで、AIアシスタントは機密情報の流出リスクを大幅に抑え、プライバシーを守り、システムへのユーザの信頼を保つことができます。

また、AIアシスタント中心の環境でコミュニケーションの仕組みがどう変わっていくかを見据えることも重要です。現在、私たちは多数の要求と応答を自然な言葉でやり取りする複数のAIエージェントの仕組みに向かっていますが、そこでは一つの不正な情報が処理の連鎖全体に波及する恐れがあります。そのため、プロンプト注入や情報汚染といった攻撃からAPIの生態系を守ることが重要になります。これらは対策を怠ると、処理の連鎖の末端まで影響が及んでから発覚する可能性があります。

そして、日々進化するサイバー脅威からAIアシスタントを積極的に守るには、高度な脅威の検知と対策の技術を取り入れることが極めて重要です。これらの技術は、機械学習と行動分析を活用してリアルタイムで不正な活動を見つけ出す点で、従来の特徴パターンによる検知を大きく超えています。

システムは、この文書で説明した脅威を含む既知の攻撃手法のパターンを学習でき、さらに明確な特徴が見えていない新たな脅威にも対応できるよう進化を続けます。ユーザのプライバシーに十分配慮しながらシステムの動きを常に監視することで、異常や不審な動きを素早く察知し、警告を発して適切な対処を取ることができます。

まとめ

AIアシスタント(DA)の世界を詳しく分析することで、この新しい技術がもたらす課題と可能性の両面が見えてきました。

今回の調査では、AIアシスタントを脅かす重大なセキュリティ上の危険を複数の種類に分類し、悪意ある攻撃者が仕掛ける可能性のある様々な攻撃手法を明らかにしました。これらのリスクは、AIアシスタントの設計と実装において安全性を最重要課題として取り組む必要性を示しています。

特に注目すべきは、サービスとユーザをつなぐAIアシスタントのエージェントの仕組みを支えながら、ユーザに使いやすく直感的な操作を提供するために、インターネットの中間層をどのように発展させていくべきかという点です。

AIアシスタントを安全に活用していくには、開発者とユーザが協力して、セキュリティへの意識を高め、責任ある使い方とベストプラクティスを広めていく必要があります。両者がAIアシスタントの収集する個人情報の種類をしっかりと理解することが大切です。こうした情報の分類を理解することで、開発者はより確実なデータ保護の仕組みを構築し、ユーザの大切な情報を守ることができます。

AIアシスタントの世界には、人間と技術の関係を一変させる可能性が秘められています。しかし、その可能性を最大限に引き出すには、技術、社会、セキュリティの各面での課題に取り組む必要があります。ユーザの要望を第一に考え、革新を推し進め、安全性への懸念に対処することで、私たちは皆にとってより良い未来を切り拓くことができるでしょう。

付録

今回の調査で紹介したツールを実践的に活用できる資料としてこちらの付属もご参照ください。

AIアシスタントの能力評価表

詳細はこちらをご参照ください。

参考記事:

AI Assistants in the Future: Security Concerns and Risk Management

By Vincenzo Ciancaglini, Salvatore Gariuolo, Stephen Hilt, Robert McArdle, and Rainer Vosseler

翻訳:与那城 務(Platform Marketing, Trend Micro™ Research)