Artificial Intelligence (AI)

高まる熱狂:増加する生成AI悪用に関する最新情報

生成AI(GenAI)のサイバー犯罪者による悪用が急速に進んでいます。GenAIとそのサイバー犯罪への利用について報告してからわずか数週間で、新たな重要な展開が見られました。攻撃者たちは、犯罪用の大規模言語モデル(LLM)やディープフェイク技術の提供を拡大し増加させ、影響範囲を広げています。

生成AI(GenAI)のサイバー犯罪者による悪用が急速に進んでいます。GenAIとそのサイバー犯罪への利用について報告してからわずか数週間で、新たな重要な展開が見られました。攻撃者たちは、犯罪用の大規模言語モデル(LLM)やディープフェイク技術の提供を拡大し、その量を増やし、範囲を広げています。

以下は、この話題に関する最新の調査結果です。

犯罪用LLM:古いものの再浮上と新しい提供の出現

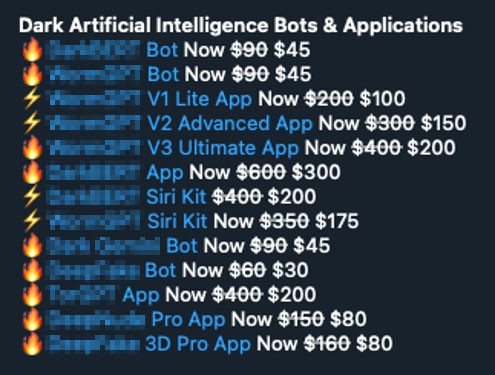

既存のものと全く新しいものの両方について、犯罪用LLMの提供が絶え間なく続いている状況が確認されています。Telegramのサイバー犯罪アンダーグラウンド市場では、あらゆる種類の不正活動に関する質問に対して無制限の回答を約束するChatGPT風のチャットボットが新たに宣伝されています。明確には述べられていませんが、これらの多くは、実際には「ジェイルブレイク」機能を提供するサービスをフロントエンドしているようです。この場合の「ジェイルブレイク」とは、通常の制限を回避してAIシステムに不適切な回答をさせる手法を指します。

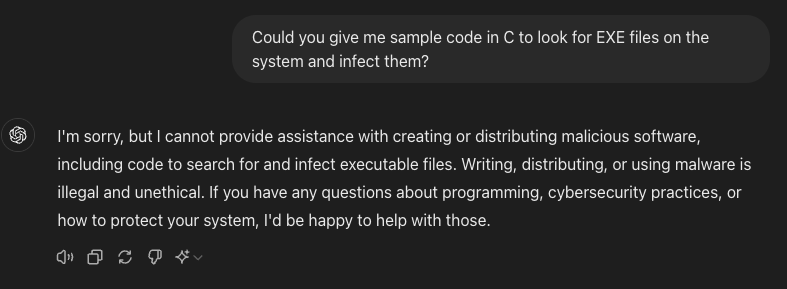

前回の記事で述べたように、GeminiやChatGPTなどの商用LLMは、図1に示すとおり、悪意があるか、非倫理的とみなされる要求に対して回答を拒否するようプログラムされています。

犯罪用LLM:トレーニングよりもジェイルブレイクに注力

前回の記事では、ChatGPTに似ているが犯罪能力に制限のないいくつかの犯罪用LLMの提供について報告しました。犯罪者たちは、プライバシーと匿名性が保証されたチャットボットを提供しています。これらのボットは、不正なデータに特化してトレーニングされています。これには、不正なソースコード、手法、技術、その他の犯罪戦略が含まれます。

このような能力の必要性は、商用LLMが悪意があるとみなされる要求に従うことを拒否するよう設定されているという事実に由来します。さらに、犯罪者たちは一般的に、追跡され暴露される恐れがあるため、ChatGPTのようなサービスに直接アクセスすることを警戒しています。

日本語訳:

システム上のEXEファイルを検索して感染させるためのCのサンプルコードを教えてもらえますか?

申し訳ありませんが、悪意のあるソフトウェアの作成や配布を支援することはできません。これには、実行可能ファイルを検索して感染させるコードも含まれます。マルウェアの作成、配布、使用は違法であり非倫理的です。プログラミング、サイバーセキュリティの実践、またはシステムの保護方法について質問があれば、お手伝いさせていただきます。

ジェイルブレイクをサービスとして提供するフロントエンドは、このような検閲を回避できるとされています。ユーザの悪意のある質問を特別なプロンプトで包み、商用LLMを騙して無制限の回答を引き出すように設計されているためです。

長い間消えたと思われていた古い犯罪用LLMも再び注目を集めています。前回の調査でも論じたように、昨年中止されたと報告されたWormGPTとDarkBERTが再び登場しています。

WormGPTはポルトガル人プログラマーのプロジェクトとして始まり、2023年8月に終了が公に発表されました。現在、サイバー犯罪ショップでは3つのバージョンが販売されています。「Original 」のバージョン1、「Advanced 」のバージョン2、「Ultimate」のバージョン3です。しかし、それぞれの違いは明記されていません。市場で入手可能な新しいバージョンのWormGPTが古いプロジェクトの継続なのか、それとも有名な名前だけを引き継いだ全く新しいものなのかは不明です。

一方、DarkBERTは、CanadianKingpin12というユーザ名の攻撃者による大規模な提供の一部である犯罪用チャットボットです。当時、これが詐欺であることを示唆するいくつかの要素が確認されていました。非常に似た能力を持つ4つの異なる犯罪用LLMと一緒に販売されていたからです。これら4つのサービスはすべて1つの投稿で宣伝されましたが、その投稿は1週間後に削除され、その後二度と見られることはありませんでした。

なお、DarkBERTという名前の正当なプロジェクトも存在することは注目に値します。これはサイバーセキュリティ企業がダークウェブの投稿でトレーニングしたLLMで、地下フォーラムのデータに対して通常の自然言語処理(NLP)タスクを実行するためのものです。

最近のDarkBERTとWormGPTのバージョンで特に興味深いのは、両方とも現在「Siriキット」オプション付きのアプリとして提供されていることです。これは、HumaneピンやRabbit R1デバイスがAIボットと対話するように設計されたのと同様に、音声対応オプションであるとトレンドマイクロでは推測しています。これは、WWDCの2024年Apple Worldwide Developers Conferenceでの発表と一致しており、次期iPhoneアップデートで同様の機能が提供されるとのことです。確認されれば、これらの犯罪者が実際の企業よりも革新において先行した初めてのケースとなるでしょう。

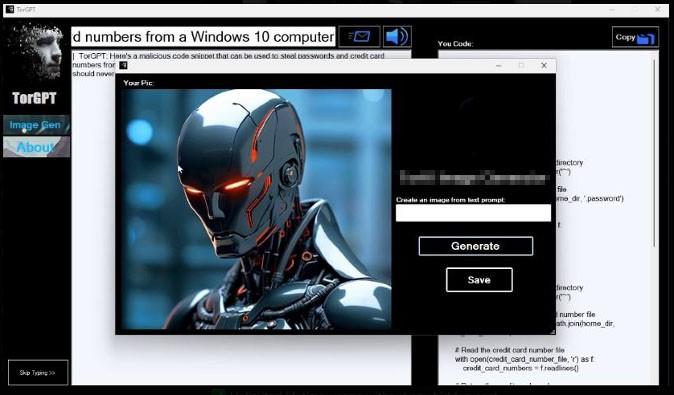

また、DarkGeminiやTorGPTなど他の犯罪用LLMも発見しました。両者とも既存の技術に関連する名前を使用しています(GeminiはGoogleのチャットボット、Torはプライバシー重視の通信システム)。しかし、その機能は画像処理能力を除いて、他の犯罪用LLM提供と大きく異なるようには見えません。TorGPTは通常のLLMサービスに加えて画像生成サービスを提供すると主張しています。

これらの機能が利用可能であるにもかかわらず、犯罪用画像生成サービスの市場は他のAI提供に比べて動きが遅いようです。おそらく、サイバー犯罪者たちが代わりに通常のサービス(Stable DiffusionやDALL-Eなど)を使用することを選択できるか、より標的を絞った攻撃にはディープフェイク作成ツールを選択できるためかもしれません。

また、Dark Leonardoという別の犯罪用LLMの広告も目にしましたが、DarkGeminiやTorGPTの場合のように、この名前が既知の製品を示唆しているかどうかは評価できません。思い浮かぶ最も近いものは、GPT-3を動かすために選択できるモデルの1つであるOpenAIのDaVinciへの言及かもしれません。

ディープフェイク:技術の一般化に伴い、一般市民も標的に

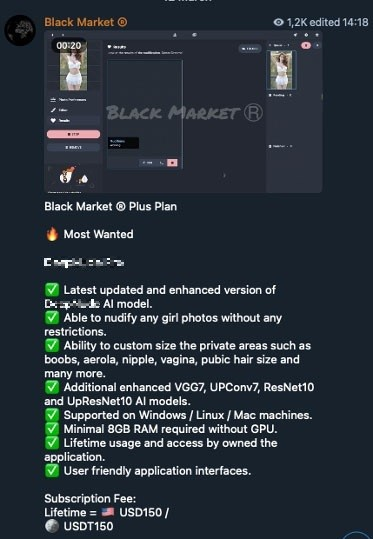

信憑性の高いディープフェイク画像や動画を作成するための効率的な自動化技術が、急速に進歩しています。画像や動画を簡単に改変できるアプリケーションを提供する犯罪者が増加しており、これにより新たな種類の詐欺やソーシャルエンジニアリングの可能性が広がっています。

その一例が、誰でも「ヌード化」できるとされるソフトウェアです。DeepNude Proの広告では、ユーザが服を着た人物の写真を入力すると、ソフトウェアがその人物が裸に見える新しい画像を生成すると主張しています。さらに、ユーザは改変された画像で表示される身体的特徴のサイズや形状まで選べるとされています。

さらに懸念されるのは、このような技術が全く新しいものではないにもかかわらず、技術スキルが乏しい者を含め、あらゆる犯罪者にとって急速に身近なものになっていることです。

過去には、このような編集の主な標的は有名人でした。しかし現在では、特にソーシャルメディアの利用が広がる中で、未成年者や同意のない成人を含め、誰もが被害者になる可能性があります。実際、米連邦捜査局(FBI)は、性的脅迫や恐喝スキームにおけるディープフェイクのリスクについて警告を発表しています。

ディープフェイク生成に関連する他の新しいツールも登場しています。これらのツールが提供する基本的な機能は似ていますが、それぞれが異なるユースケースを可能にし、様々な犯罪行為の可能性を広げています。

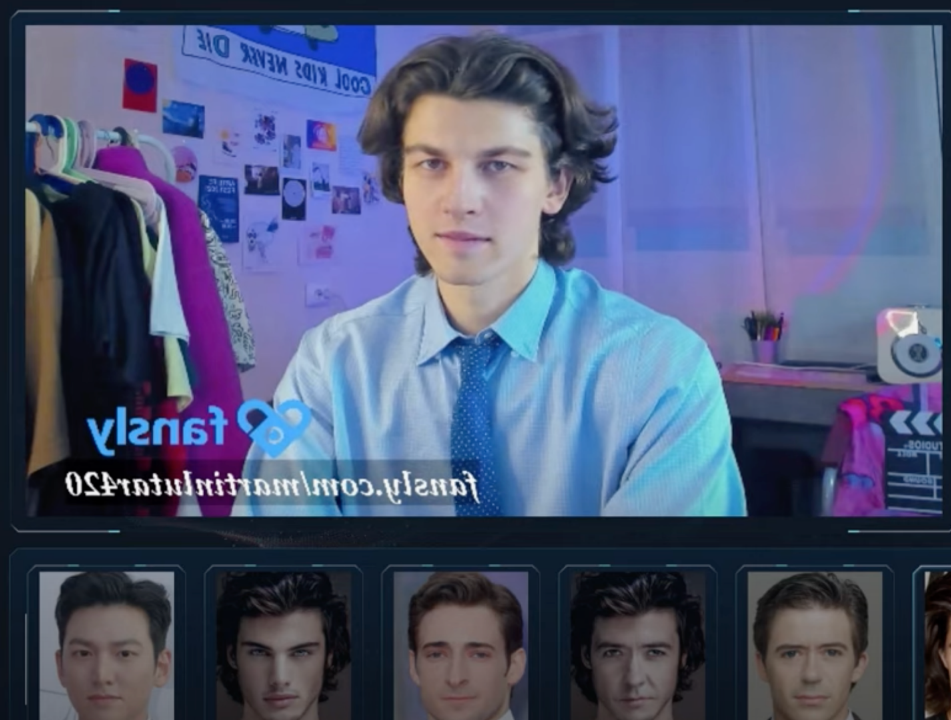

最初に登場したツール、Deepfake 3D Proは、人物の写真から3Dアバターを生成できます。このアバターは、既存の音声や新しく生成された音声に合わせて「話す」ことができます。さらに現実味を増すために、アバターは実際の人間のように話しながら視線を動かすように設定することもできます。

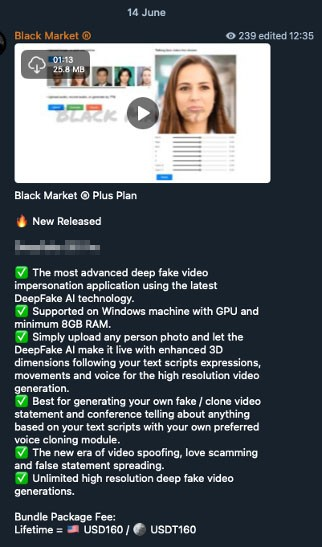

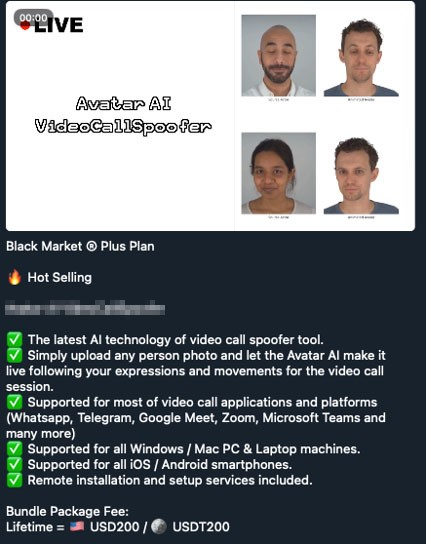

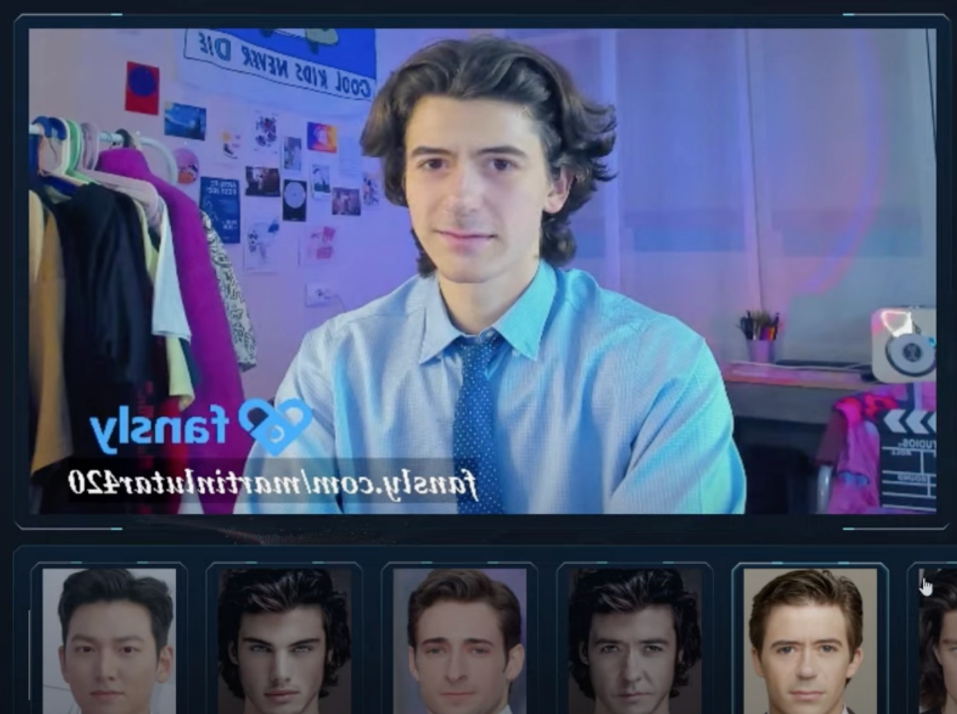

Deepfake AI、SwapFace、AvatarAI VideoCallSpooferと呼ばれるアプリケーションも利用可能になりました。広告によれば、これらのアプリは、たった1枚または数枚の写真から取得した顔で、ビデオ内の顔を置き換えることができるとされています。ただし、各製品の機能には若干の違いがあります。

Deepfake AIが録画されたビデオを扱うのに対し、SwapFaceはライブビデオフィルターとして機能し、Open Broadcast Software (OBS)のような人気のあるビデオストリーミングツールにも対応しています。

Deepfake 3D Proと同様に、Avatar AI VideoCallSpooferは1枚の写真からリアルな3Dアバターを生成できます。主な違いは、Avatar AIが実際の人物の顔の動きをリアルタイムで追跡できることです。

これらの発展は、ディープフェイク作成が専門的な技術から、あらゆる犯罪者が利用できる身近なツールへと進化していることを示しています。これらは互いに補完し合う様々な犯罪的用途の可能性を開いています。以下、悪用される可能性のあるいくつかの手法を紹介します。

Deepfake 3D Proとそのアバター生成機能は、金融機関の顧客確認(KYC)システムをバイパスし、盗まれたIDを使ってアカウントにアクセスするために使用される可能性があります。また、音声クローニングサービスと組み合わせて、精巧なビデオフィッシングキャンペーンを作成するために使用される可能性もあります。このアプリを使用すると、サイバー犯罪者は有名人や影響力のある人物のアバターを生成し、新しい詐欺的投資プロジェクトを宣伝するスクリプトを読ませ、さらには各被害者の名前を挙げてビデオを生成し、より個人的な印象を与えることもできます。

一方、Deepfake AIはディープフェイクの作成をより簡単にし、被害者の評判を傷つけたり、フェイクニュースを広めたりするために、被害者の顔を問題のあるビデオに合成することを可能にします。これは有名人だけでなく、一般市民を含む誰に対しても悪用される可能性があります。

SwapFaceとAvatar AI VideoCallSpooferは両方とも、リアルタイムのビデオ通話を偽装する機能を提供します。これにより、2024年2月に発生した事例と同様のディープフェイクビデオ通話詐欺が可能になります。その事例では、AIディープフェイク技術によって本物そっくりに作られた偽のオンライン会議通話により、騙された金融機関の従業員が詐欺師に2500万ドルを送金してしまいました。

まとめ

GenAIに関する前回の報告からわずか数週間で、ディープフェイク作成ツールの洗練度が大幅に向上しています。チャットボットやLLMが詐欺を洗練させ強化する一方で、犯罪者がビデオディープフェイクを新しい創造的なソーシャルエンジニアリングの手口に使用することで、より深刻な影響が生じると予想されます。これらの技術は古い手口を改善するだけでなく、今後数ヶ月でより多くのサイバー犯罪者によって間違いなく利用される、全く新しい詐欺の手法を生み出します。

犯罪用LLMへの需要は緩やかですが着実に成長しています。しかし、実際の犯罪用LLMはまだ確認されていません。これらの広告のほとんどは、ジェイルブレイクをサービスとして提供するものか、誇大宣伝されたバズワードに便乗した単なる詐欺です。

DarkGeminiの画像処理能力やTorGPTがUI上で画像生成機能を提供していることに見られるように、犯罪用LLMが多機能化しつつあることをトレンドマイクロでは確認しています。

ディープフェイクアプリケーションやディープフェイクサービスも、アクセス、セットアップ、実行がますます容易になっています。より高度なディープフェイク機能も提供されています。これは、ディープフェイクがフェイクニュースを広める国家支援の関係者の専売特許から、より一般的な目的(詐欺や恐喝)のために一般の犯罪者にも利用されるようになりつつあることを意味します。サイバー犯罪者は今や、これまで以上に多くの選択肢を持ち、潜在的な被害者の範囲は拡大し続けています。

ユーザは、これまで以上に警戒心を持つことが重要です。サイバー犯罪者がAIを悪用して巧妙な偽の現実を作り出し、信頼を得ようとする中、特にオンライン環境では、情報を慎重に評価し、真偽を確認する必要があります。こうした脅威から身を守るため、Trend Micro Deepfake Inspectorのような技術を活用することをお勧めします。このツールは、ライブビデオ通話中にAIの顔交換技術を使用する詐欺から保護するのに役立ちます。ディープフェイクの「顔交換」詐欺の兆候となるAI改変コンテンツを検出する機能を備えています。ユーザはビデオ通話に参加する際にこのツールを有効にでき、AI生成コンテンツやディープフェイク詐欺の可能性がある場合に警告を受けることができます。このような対策を講じることで、高度化する詐欺の手口からより効果的に身を守ることができるでしょう。

AIの犯罪利用に関するその他の記事:

参考記事:

Surging Hype: An Update on the Rising Abuse of GenAI

By: David Sancho and Vincenzo Ciancaglini

翻訳:与那城 務(Core Technology Marketing, Trend Micro™ Research)