フィルターバブルとは? 意味と危険性をわかりやすく解説

フィルターバブルとは、過去の行動、好み、検索履歴などによってパーソナライズされた情報のみを受け取ることによって、ユーザが偏った信念や価値観を持ってしまう事象を指します。

フィルターバブルとは?

「フィルターバブル(Filter Bubbles)」とは、インターネットを通じて見る情報が、自分が好きなものや興味のあるものに限られてしまう状態のことです。YouTubeやInstagram、Amazon、TikTokなど様々なインターネットサービスでは、ユーザが何を見て、何に興味があるのかを記録しています。そして、その情報を使って、次にユーザが求めるコンテンツを予測して、それにあったものを提示します。いわゆる「パーソナライズ(サービスの最適化)」と呼ばれる機能です。

このパーソナライズが用いられているサービスでは、自分が興味を持っているコンテンツを中心に提示してくれるので、一見ユーザからすると便利な機能といえます。一方で、他の異なる意見や新しいトピックに触れる機会が大きく損なわれてしまいます。

自分の興味や信念に基づく情報に囲まれ、他の異なる情報から隔離されてしまったユーザは、いつの間にか自身の価値観に疑問を投げかけたり、視野を広げる情報に触れたりする機会を失っており、まるで「泡(バブル)」のなかに閉じ込められたような状態に陥ります。これがフィルターバブルと名付けられた理由です。

フィルターバブルはイーライ・パリザー氏によって2011年に提唱された概念ですが、その課題は現在も続いている状態だと言えます。特に昨今はインフルエンスオペレーション(影響力工作)の脅威が増大していく中で、フィルターバブルへの対策も重要になってきています。

インフルエンスオペレーションは、特定の政治的、社会的目的を達成するために、公共の意見や信念に影響を与えようとする作戦です。この目的は、選挙の結果を左右することや、特定の政策に影響を与えること、民衆の分断を作り出すことなどが挙げられます。フィルターバブルによって、特定のタイプの情報に繰り返し晒されることで、その情報に対する感受性が高まり、意見形成において偏った視点が強化されていきます。インフルエンスオペレーションを用いる攻撃者は、このフィルターバブルの性質を利用して、特定の情報を意図的に複数拡散することで、公共の意見を形成または操作することが可能です。つまり、フィルターバブルの対策を取らなければ、自分が意識しないうちに偏った方向に誘導されやすくなります。

パーソナライズされているサービス例

パーソナライズはフィルターバブルを作り出す要因です。インターネットの世界では、今や多くのサービスがパーソナライズを提供しています。以下はパーソナライズされているインターネットサービスの代表例です。

Google検索

過去に調べた検索キーワードや過去に訪問したサイトやクリックしたリンクなどを基に、パーソナライズを行っています。同じ検索語句でも異なるユーザには異なる結果が表示されることがあります。

Facebookはユーザの過去の「いいね!」やコメント、共有などの行動を分析して、ニュースフィードで表示するコンテンツをカスタマイズします。友人の投稿や広告も、ユーザが興味を持ちそうなものが選ばれて表示されます。

TikTok

TikTokでのリアクション(アカウントのフォローや投稿への「いいね」など)を通じて、関連の深い動画が表示されやすくなります。

LINE NEWS

個人に最適化された記事を推薦するAIを活用したパーソナライズ配信機能「FOR YOU」を提供しており、ユーザごとに最適化したニュースを配信しています。(参考:LINE NEWSのトップ面は1億通り、AIで実現した「ニュースの個人化」)

ユーザ体験を向上させ、サービスの利便性を高める目的でパーソナライズは広く採用されている機能です。この技術自体は多くの場面で非常に有効であり、ユーザにとっても価値のあるものです。一方で、フィルターバブルにつながる潜在的な課題も持ち合わせています。パーソナライズを提供している企業には、多様な視点が失われないようにするための取り組みも社会的な側面から求められています。

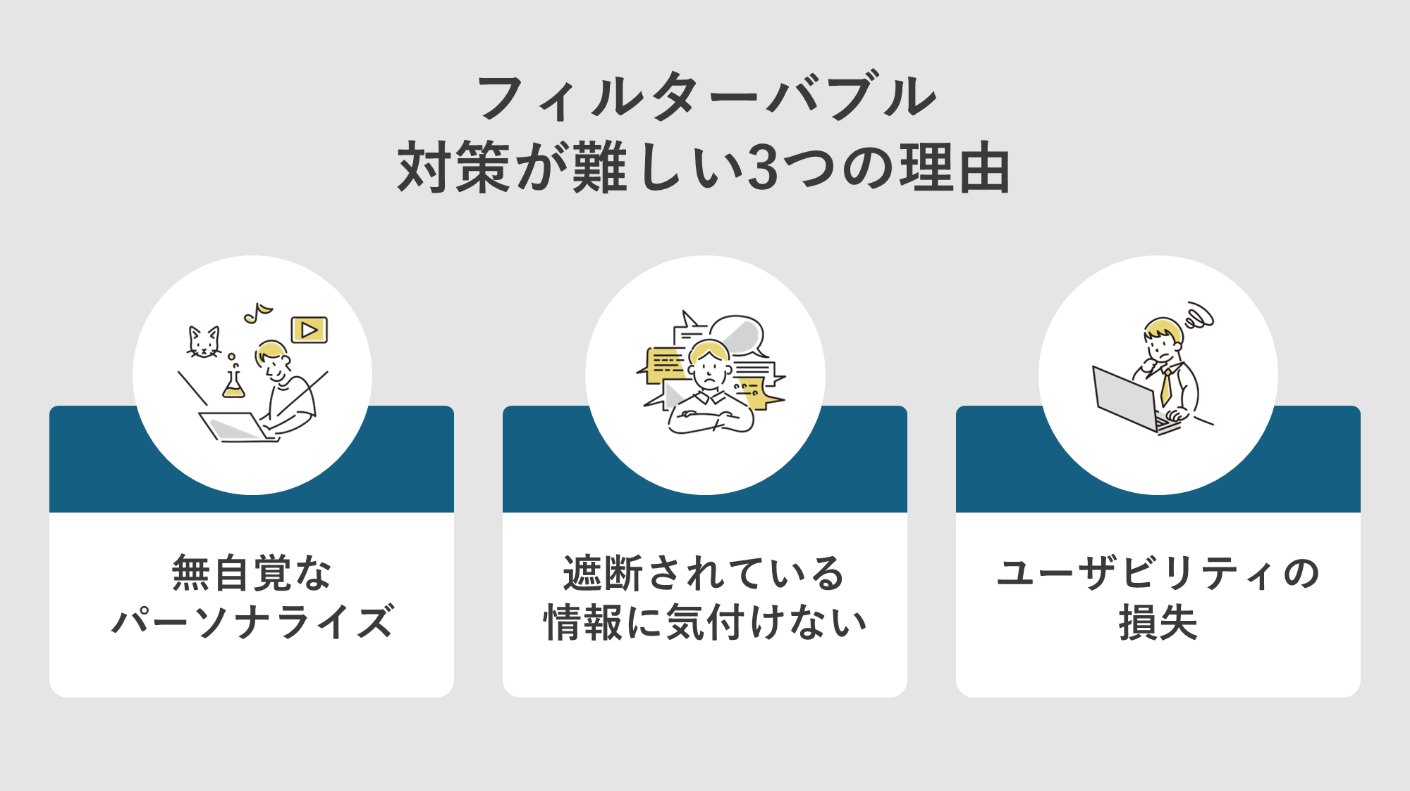

無自覚なパーソナライズ

ユーザの大半はパーソナライズの機能を自ら選択したわけではなく、インターネットサービスのデフォルト設定によって自動的に利用しています。これにより、自覚がないままパーソナライズされた情報を受け取っているのです。この状況では、検索エンジンが過去の検索履歴に基づいて結果を表示していても、ユーザは自分が特定の視点や情報から隔離されていることに気づきません。その結果、パーソナライズされているにも関わらず、「通常」の検索結果だと認識してしまいます。

遮断されている情報に気付けない

フィルターバブルの状態にあるユーザは、どの情報が遮断されているのか、何が「通常」で何が「パーソナライズ」された情報なのかを区別して見ているわけではありません。自分の情報消費パターンを客観的に評価しない限り、自分の情報環境が偏っている可能性に気づきにくいといえます。

ユーザビリティの損失

自身がフィルターバブルの状態にあることに気づけたとしても、通常はユーザにとってパーソナライズされたサービスの方が使いやすく、提供される情報も自分に関連性が高いと感じます。つまり、パーソナライズの設定を解除することはユーザビリティの損失に繋がるため、心理的側面から見ても、ユーザはフィルターバブルを継続することを選択してしまいがちです。

フィルターバブルとエコーチェンバーの違い

フィルターバブル以外にもインターネット上での意見形成や対話に大きな影響を与えている問題があります。自分と同じ意見や考えを持つ人々とだけ交流している状態である「エコーチェンバー(Echo Camber)」と呼ばれる問題です。様々な資料でフィルターバブルと並列で説明される概念です。エコーチェンバー内では、同じような意見や情報が繰り返し強調されるため、ユーザは自分の見解が広く受け入れられていると感じることがあります。

フィルターバブルではパーソナライズが要因になっていると解説しましたが、エコーチェンバーの形成には人間の心理的な特性とSNSのフォロー機能が大きな要因となっています。

人間には「確証バイアス」という自分の既存の信念や意見を支持する情報を好み、それに反する情報を無意識のうちに避ける傾向があります。このバイアスにより、自分に都合の良い意見だけを受け入れ、異なる意見には耳を傾けなくなります。また、SNSではユーザが自分の興味や意見に合った人々をフォローすることが一般的です。たとえば、特定の政治的意見や趣味を共有する他のユーザを積極的にフォローすることで、自分のタイムラインは同じ考えを持つ人々の投稿で満たされます。その結果、特定の政治的思想が強化され続けていく、などの状況に陥ります。

このように、同じ意見や価値観を共有する人々が集まり、自分たちの意見がグループ内で繰り返し共有され続ける状態が、音が部屋の中で反響(エコー)して何度も繰り返し聞こえることと似ているため、エコーチェンバーと名付けられています。

フィルターバブルとエコーチェンバーはどちらもユーザが一方向的な情報を受け取る状態を作り出し、多様な視点や意見からの隔離を引き起こします。さらに、フィルターバブルとエコーチェンバーはお互いに影響を与え合い、相互にその状態を強化し合う関係にあります。例えば、フィルターバブルにより、ユーザが自分と異なる視点に触れる機会が減少した状態でSNSに参加することで、エコーチェンバーが形成されやすくなり、自分の意見に対して同意だけを示すコミュニティを自然と形成してしまう可能性があります。

フィルターバブルの対策

フィルターバブルの対策には、企業側とユーザ側の両方の視点から取り組む必要があります。それぞれの視点からの対策を具体的に見ていきましょう。

企業側の対策

インターネットサービス企業には、単にユーザの過去の行動に基づくだけでなく、意図的に異なる視点や情報を含むコンテンツを推薦することで、情報の多様性を保つ努力が必要です。また、ユーザが選択してパーソナライズの機能をオフにできるようにするなど、選択の自由を尊重していくことも求められます。今後インフルエンスオペレーションの脅威が増大していく中では、このような多様性のある情報をユーザに届ける社会的責任が企業に課されていくと考えられます。

ユーザ側の対策

様々なインターネットサービスで自身がパーソナライズされた情報を受け取っていることを認識したうえで、自分の視野を広げる努力をするべきです。例えば、受け取る情報に対して批判的に考える習慣を持つことで、情報のバイアスや根拠を自分で評価できます。また、一部のサービスだけではなく、様々な情報源を利用することで、よりバランスのとれた視点を持つことが可能です。

参考記事:

・2023年サイバー脅威総括:日本の安全保障に影響を及ぼすサイバー脅威とは?

・ディープフェイクとは

Security GO新着記事