Zusammenfassung

- Auf der CES wurden mehrere digitale KI-Assistenten vorgestellt, die eine nahtlose Integration in unseren Alltag versprechen.

- Die zunehmende Komplexität der KI-Assistenten birgt jedoch erhebliche Risiken für die Cybersicherheit, darunter Datenschutzprobleme und einen potenziellen Missbrauch sensibler personenbezogener Daten.

- Wir haben die Merkmale drei dieser Produkte auf der Grundlage einer Digital Assistant Matrix bewertet, um potenzielle Probleme und Schwachstellen zu diskutieren.

- Die kontinuierliche Audioüberwachung und der Umgang mit kritischen Informationen machen die Assistenten anfällig für Angriffe wie die Manipulation von Sprachbefehlen und Identitätsdiebstahl.

Das Aufkommen von digitalen KI-Assistenten (DA) markiert einen entscheidenden Meilenstein für die Technologie, die die Art und Weise, wie Menschen mit ihrer Umgebung interagieren, revolutionieren könnte. Auf der CES 2025 zeigten Innovationen in diesem Bereich das transformative Potenzial dieser Systeme.

KI-DAs verarbeiten sensible personenbezogene Daten, kontrollieren den Zugriff auf kritische Geräte und arbeiten oft innerhalb komplexer Ökosysteme miteinander verbundener Systeme. Das Verständnis dieser Risiken ist von entscheidender Bedeutung, um die Sicherheit und das Vertrauen der Benutzer zu gewährleisten.

Wir haben drei der neuen KI DAs untersucht und bewerten die potenziellen, damit verbundenen Bedrohungen. Da es sich um innovative, neuartige Geräte handelt, stützt sich die Bewertung auf öffentliche Beschreibungen ihrer Funktionen. Wir haben öffentlich zugängliche Open Source-Daten verwendet, um potenzielle Sicherheitsprobleme zu identifizieren, auf die wir die Hersteller dieser und ähnlicher Produkte aufmerksam machen wollen.

Stets empfangsbereiter KI-Assistent

Der stets empfangsbereite KI-Assistent von Bee arbeitet mit kontinuierlicher Audioüberwachung, um in Echtzeit Antworten zu liefern. Diese Funktionalität bietet zwar einen außergewöhnlichen Komfort, wirft aber ernste Sicherheitsbedenken auf. Das Wearable, der Bee Pioneer, verfügt über Mikrofone, die Daten erfassen und an die Bee-KI senden.

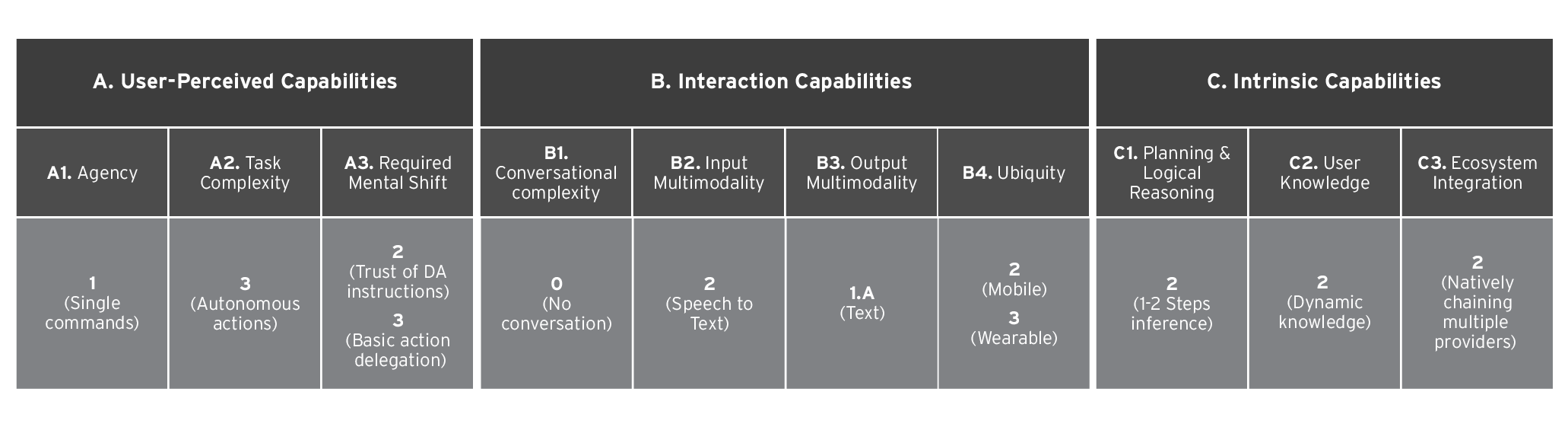

Tabelle 1. Level-Zuordnungen der Fähigkeiten des Bee KI-Assistenten als digitaler Assistent (DA)

Wer sich für diesen KI-Assistenten interessiert findet Einzelheiten der Zuordnung im Originalbeitrag.

Geräte wie dieses bergen erhebliche potenzielle Datenschutzprobleme. Die kontinuierliche Audioaufzeichnung erhöht die Wahrscheinlichkeit, dass sensible Gespräche aufgezeichnet und sogar missbraucht werden. Wenn die Verschlüsselungsstandards unzureichend sind oder der Speicher nicht ordnungsgemäß gesichert ist, könnten Angreifer diese Daten für böswillige Aktivitäten wie Identitätsdiebstahl abfangen. Am wahrscheinlichsten ist es, dass Kontodaten gestohlen und Täter sich in die Apps einloggen, um sensible Daten zu entwenden. Der Assistent ist wahrscheinlich auch anfällig für Manipulationen von Sprachbefehlen, bei denen synthetische oder vorab aufgezeichnete Stimmen nicht autorisierte Aktionen auslösen können. Bei Geräten mit Input Multimodality (B2) sind Angriffe durch Audioaufnahmen zu berücksichtigen. Dies würde bedeuten, dass die künftigen Bedrohungen dafür Skill Squatting, Trojaner, Metaverse-Avatar DA-Phishing SEO-Missbrauch oder bösartige externe Das umfassen.

KI Wellness Coach

Der KI-Wellness Coach Umi aus Panasonics Well-Portfolio konzentriert sich auf Gesundheits- und Wellness-Beratung. Er sammelt biometrische sowie Verhaltensdaten und bietet Nutzern auf sie zugeschnittene Beratung zur Fitness, Schlaf und Ernährung. Doch diese umfassende Funktionalität bringt Sicherheitsrisiken mit sich.

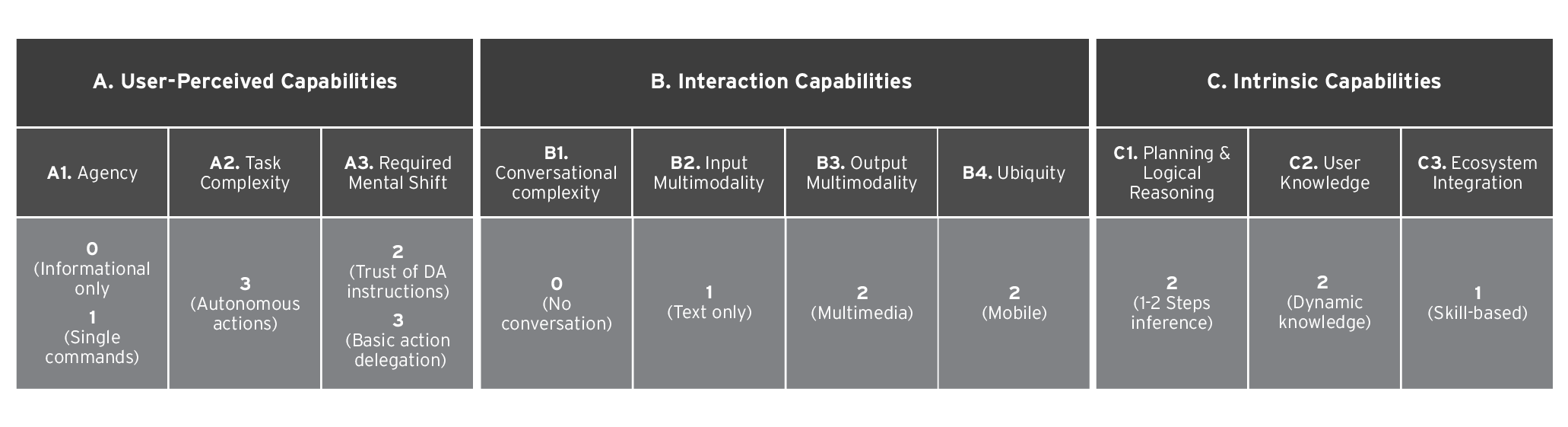

Tabelle 2. Level-Zuordnungen der Fähigkeiten von Panasonic Umi als DA

Wer sich für diesen KI-Assistenten interessiert findet Einzelheiten der Zuordnung im Originalbeitrag.

Unserer Recherche nach birgt der Umgang mit biometrischen Daten kritische Risiken für Dienste wie diesen KI-Wellness-Coach. Gesundheitsdaten wie Herzfrequenz oder Schlafmuster sind hochsensibel und könnten, wenn sie kompromittiert werden, zu gefälschten Krankenakten oder falschen Gesundheitsempfehlungen durch Betrüger führen. Darüber hinaus lässt sich der Wellness-Coach mit Gesundheitsgeräten und -anwendungen von Drittanbietern integrieren, wodurch eine größere Angriffsfläche entsteht. Eine einzige Schwachstelle in diesen Verbindungen könnte es Angreifern ermöglichen, in das System einzudringen und auf private Benutzerdaten zuzugreifen.

Social-Engineering-Angriffe stellen ein weiteres erhebliches Risiko dar. Der Angriff auf MyFitnessPal hat gezeigt, wie sich infolge von Schwachstellen in Wellness-Apps die Daten von Millionen von Benutzern offenlegen lassen, und macht gleichzeitig deutlich, welchen Stellenwert robuste Sicherheitsmaßnahmen in KI-gestützten Wellness-Geräten haben. Cyberkriminelle könnten sich als Gesundheitsdienstleister ausgeben. Diese Art von Angriffen wird noch glaubwürdiger, wenn geschützte Gesundheitsdaten direkt als Teil des Angriffs zitiert werden. In extremen Fällen könnten Angreifer betrügerische Gesundheitsdienste anbieten, wenn sie einen Weg finden, sich mit einem Ökosystem von Wellness-Apps zu verbinden. Opfer geben möglicherweise unwissentlich persönliche Daten preis oder bezahlen für unnötige Dienstleistungen. Die KI-Assistenten sind ebenfalls für die oben angeführten Bedrohungen anfällig.

KI-Reise-Concierge

Die AI Concierge von Delta soll den Reisekomfort verbessern, indem sie die persönlichen Reisedaten analysiert und darauf beruhende Empfehlungen abgibt. Sie wird in die Fly Delta-App integriert werden. Auch hier ergeben sich Sicherheitsrisiken. Wer sich für diesen KI-Assistenten interessiert findet Einzelheiten für die Level-Zuordnung im Originalbeitrag.

Der digitale Assistent von Delta verarbeitet sensible Informationen, darunter Reisepräferenzen, Reiserouten und Zahlungsdetails, was ihn zu einem lukrativen Ziel für Cyberkriminelle macht. Eine Datenpanne könnte zu Identitätsdiebstahl oder Finanzbetrug führen. Der Assistent ließe sich auch ausnutzen, um Phishing-Nachrichten zu verschicken, z. B. betrügerische Reisewarnungen, die die Nutzer zur Preisgabe von Passwörtern oder Zahlungsdaten verleiten. Und selbst eine E-Mail, die vorgibt, ein Reiseassistent zu sein, wäre aufgrund der Daten, die ein Angreifer stehlen könnte, glaubwürdiger.

In Zukunft werden diese reisebezogenen Assistenten noch viel leistungsfähiger werden und vollständige Reisebuchungen im Namen des Benutzers über mehrere Anbieter hinweg abwickeln. Dadurch sind sie jedoch auch neuen Bedrohungsarten ausgesetzt, wie z. B. Angriffen auf die Lieferkette und Datenmanipulation, bei denen ein böswilliger Akteur die Ergebnisse der Reiseverfügbarkeit verfälscht, um bösartige Informationen einzuschleusen, und im Falle von Personen, die für Nationalstaaten von Interesse sind, könnte dies der Überwachung dienen.

Schwache Authentifizierungsmechanismen erhöhen das Risiko eines unbefugten Kontozugriffs, über den sich Reisepläne ändern, unbefugte Reisen buchen oder Zahlungsinformationen stehlen lassen.

Fazit

KI-Assistenten werden stetig weiterentwickelt, jedoch mangelt es vielen aktuellen Implementierungen an echten multimodalen Fähigkeiten, nahtloser Integration und kontextbezogener Wahrnehmung. Trotz dieser Einschränkungen setzen sie die Benutzer bereits jetzt Risiken wie Datenschutzverletzungen, KI-Manipulationen durch Gegner und ausgeklügelten Social-Engineering-Angriffen aus.

Wir haben bereits in einer früheren Analyse die Bedeutung der Korrelation der Fähigkeiten eines KI-Assistenten mit den entsprechenden Sicherheitsbedrohungen betont, um gezielten Schutz einrichten zu können. Jede Fähigkeitsebene weist unterschiedliche Schwachstellen auf:

- Einfache KI-Assistenten (wie sprachgesteuerte Anwendungen, die einfache Anfragen bearbeiten) sind anfällig für das Abfangen von Daten, das Abhören und den unbefugten Zugriff.

- Kontextsensitive Assistenten (wie Systeme, die Antworten basierend auf dem Benutzerverhalten und History anpassen) bergen Risiken wie das Kapern von Sitzungen, Datenschutzlecks und manipulierte Entscheidungsfindung.

- Hochintegrierte KI-Systeme (wie Assistenten, die plattformübergreifende Aufgaben automatisieren, Finanztransaktionen ausführen und autonome Entscheidungen treffen) sind Bedrohungen wie tiefgreifendem Social Engineering, feindlichen Eingaben, Missbrauch der Automatisierung und Ausnutzung von Privilegienerweiterungen ausgesetzt.

Die Sicherheitsmaßnahmen haben mit den wachsenden Fähigkeiten der KI-Assistenten nicht Schritt gehalten. Viele aktuelle Implementierungen sind nach wie vor fragmentiert und verfügen nicht über robuste multimodale Interaktionen, nahtlose Ökosystemintegration und adaptive Sicherheitsmechanismen. Diese Lücke unterstreicht den Bedarf an proaktiven Schutzmaßnahmen, die die wachsende Autonomie der KI vorwegnehmen. Entwickler müssen Sicherheits-Frameworks entwerfen, die mit der KI-Entwicklung mitwachsen, anstatt Schutzmaßnahmen nach dem Auftreten von Schwachstellen nachzurüsten.

Auch das Sicherheitsbewusstsein der Nutzer muss mit den Fortschritten der KI Schritt halten. Digitale Assistenten werden oft als einfache Werkzeuge wahrgenommen, was dazu führt, dass die Sicherheitsrisiken unterschätzt werden, die damit verbunden sind. Nutzer müssen erkennen, welche Kompromisse sie eingehen müssen, wenn sie sich auf zunehmend autonome KI-Systeme verlassen.

Ohne eine auf die sich entwickelnden KI-Fähigkeiten abgestimmte Verteidigung laufen diese Systeme Gefahr, eher zu hochwertigen Angriffszielen als zu vertrauenswürdigen digitalen Verbündeten zu werden.

Trend Vision One™ ist eine Cybersicherheitsplattform, die Unternehmen dabei unterstützt, Bedrohungen schneller zu erkennen und zu stoppen, indem sie mehrere Sicherheitsfunktionen konsolidiert, eine bessere Kontrolle über die Angriffsfläche des Unternehmens ermöglicht und einen vollständigen Überblick über die Cyber-Risikolage bietet. Die Cloud-basierte Plattform nutzt KI und Bedrohungsinformationen von 250 Millionen Sensoren und 16 Bedrohungsforschungszentren auf der ganzen Welt, um umfassende Risikoanalysen, eine frühere Erkennung von Bedrohungen und automatisierte Optionen für die Reaktion auf Risiken und Bedrohungen in einer einzigen Lösung bereitzustellen.