Cyberbedrohungen

KI-Gespräch mit Forrester: Hype versus Tatsachen

GenAI mag dem Hype um ihr transformatives Potenzial noch nicht gerecht geworden sein, aber sie hat dennoch sinnvolle Anwendungen im Bereich der Cybersicherheit. Wir haben im Gespräch mit einem Forrester-Analysten den Realitätscheck gemacht.

Sie wird den Fachkräftemangel in naher Zukunft nicht beheben, aber sie kann den Sicherheitsteams einen Teil der Last abnehmen, und je besser Unternehmen ihre IT-Daten verwalten und pflegen, desto mehr wird KI im Laufe der Zeit erkennen und sogar verhindern können. Indem sie die Lehren aus den jüngsten Erfahrungen mit Schatten-IT und Cloud-Einführung ziehen, können sich Sicherheitsteams effektiv auf den Tag vorbereiten, an dem KI beginnt, ihre wilden Träume zu verwirklichen - und ihre Unternehmen sicher zu machen.

Je nachdem, wen man fragt, bedeutet generative KI entweder die Rettung der Menschheit oder ihren Untergang. Speziell im Bereich der Cybersicherheit wird sie sowohl als eine Art Allheilmittel als auch als Quelle noch nie dagewesener neuer Bedrohungen angesehen.

David Roth CRO Enterprise America, von Trend Micro, und Gastredner Jeff Pollard VP, Principal Analyst bei Forrester setzten sich kürzlich für ein Webinar zusammen, um die Spreu (sprich Hype) vom Weizen (sprich Tatsachen) bezüglich der heutigen KI zu trennen. Die beiden waren sich einig, dass KI und maschinelles Lernen für die Sicherheit nicht neu sind, auch wenn es generative KI ist, und untersuchten einige der Bereiche, in denen genAI für Cybersicherheitsteams heute praktisch und nützlich ist. Fünf Thesen lassen sich aus ihrem Gespräch ableiten.

„Ich trau mich nicht zu sagen, wir haben den Höhepunkt des KI-Hypes erreicht. Wir müssen wohl nahe dran sein, aber ich glaube, wir haben alle eine schwierige Zeit in der Branche, weil es so viele falsche Versprechen oder Erwartungen gibt, die im Moment einfach nicht erfüllt werden.“

Jeff Pollard

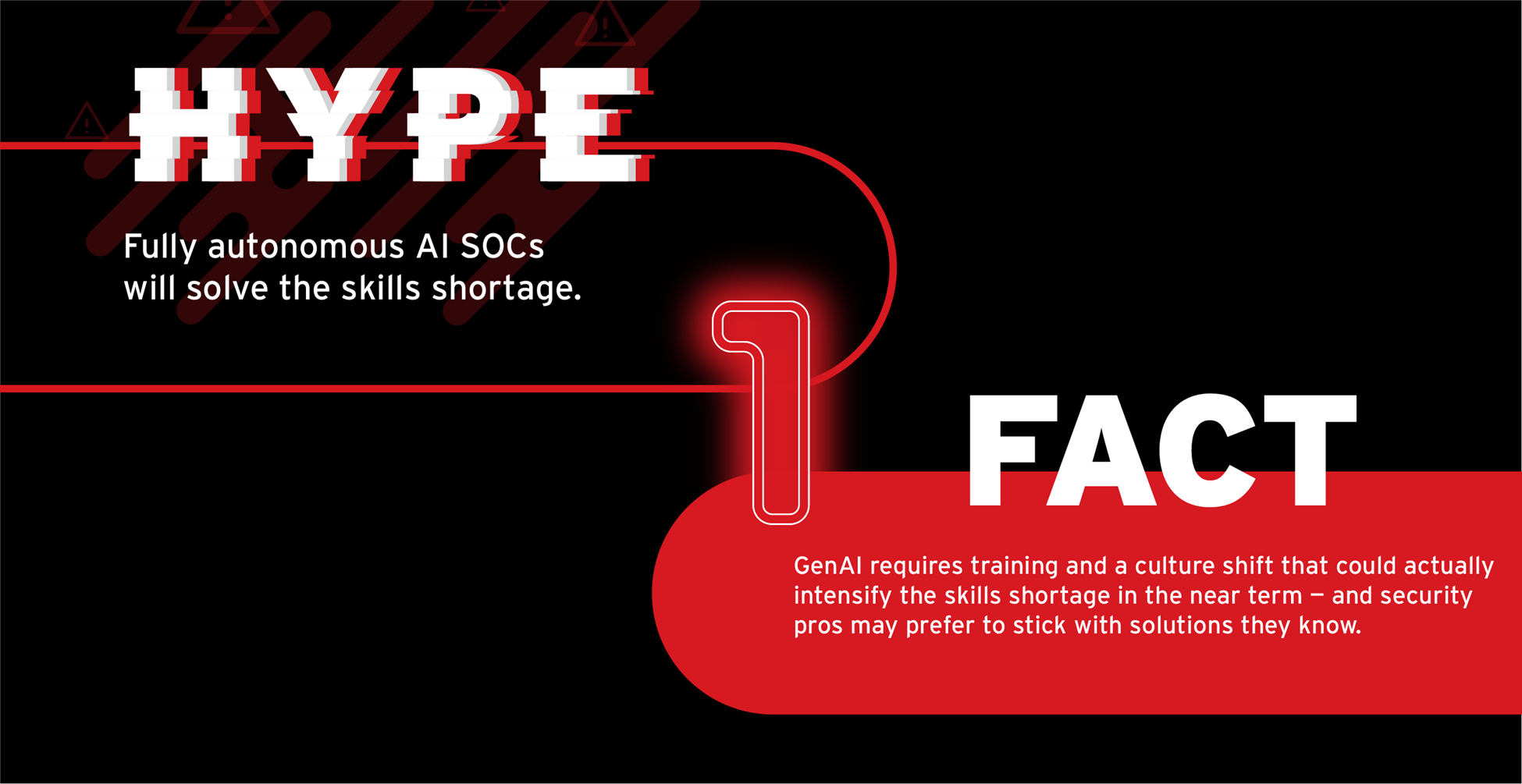

#1 - Vorsicht vor dem KI-Hype

Es ist nicht nur die Faszination für ein neues „schillerndes Objekt“, die den Hype um generative KI für die Cybersicherheit angefacht hat. Sicherheitsteams suchen verzweifelt nach Erleichterung. Sie stehen unter Druck, haben zu wenige Ressourcen, leiden unter dem jahrelangen Fachkräftemangel und sind mit Bedrohungen konfrontiert, die sich ständig vermehren und verändern.

Es ist daher verständlich, dass beim Aufkommen von genAI, sich viele Menschen dem Traum von völlig autonomen Security Operations Centers (SOCs) hingaben, in denen Agenten im Stil von Terminator auf Malware-Jagd gehen.

Doch die heutigen genAI-Systeme sind nicht effektiv genug, um ohne menschliches Eingreifen und Aufsicht zu funktionieren. Generative KI löst den Fachkräftemangel nicht auf magische Weise, im Gegenteil sie könnte ihn kurzfristig noch verschärfen, da neue Ausbildungsanforderungen entstehen. Kultur ist ebenfalls ein Faktor. Auch wenn erfahrene Fachkräfte neue KI-Tools schnell erlernen, kann es Wochen oder Monate dauern, bis sie ihre Gewohnheiten ändern und diese Tools in ihre Arbeitsabläufe integrieren.

Trotz alledem gibt es faszinierende Anwendungsszenarien für aktuelle genAI-Systeme in der Sicherheit. Durch die Erweiterung bestehender Fähigkeiten kann KI den Experten dabei helfen, mehr zu tun und bessere Ergebnisse mit weniger Arbeit zu erzielen, insbesondere in Bereichen wie Anwendungsentwicklung sowie Detection and Response.

„Je schneller man in der Lage ist [Berichte zu erstellen], desto mehr Zeit bleibt für die Arbeit an einem Event/Vorfall.“

Jeff Pollard

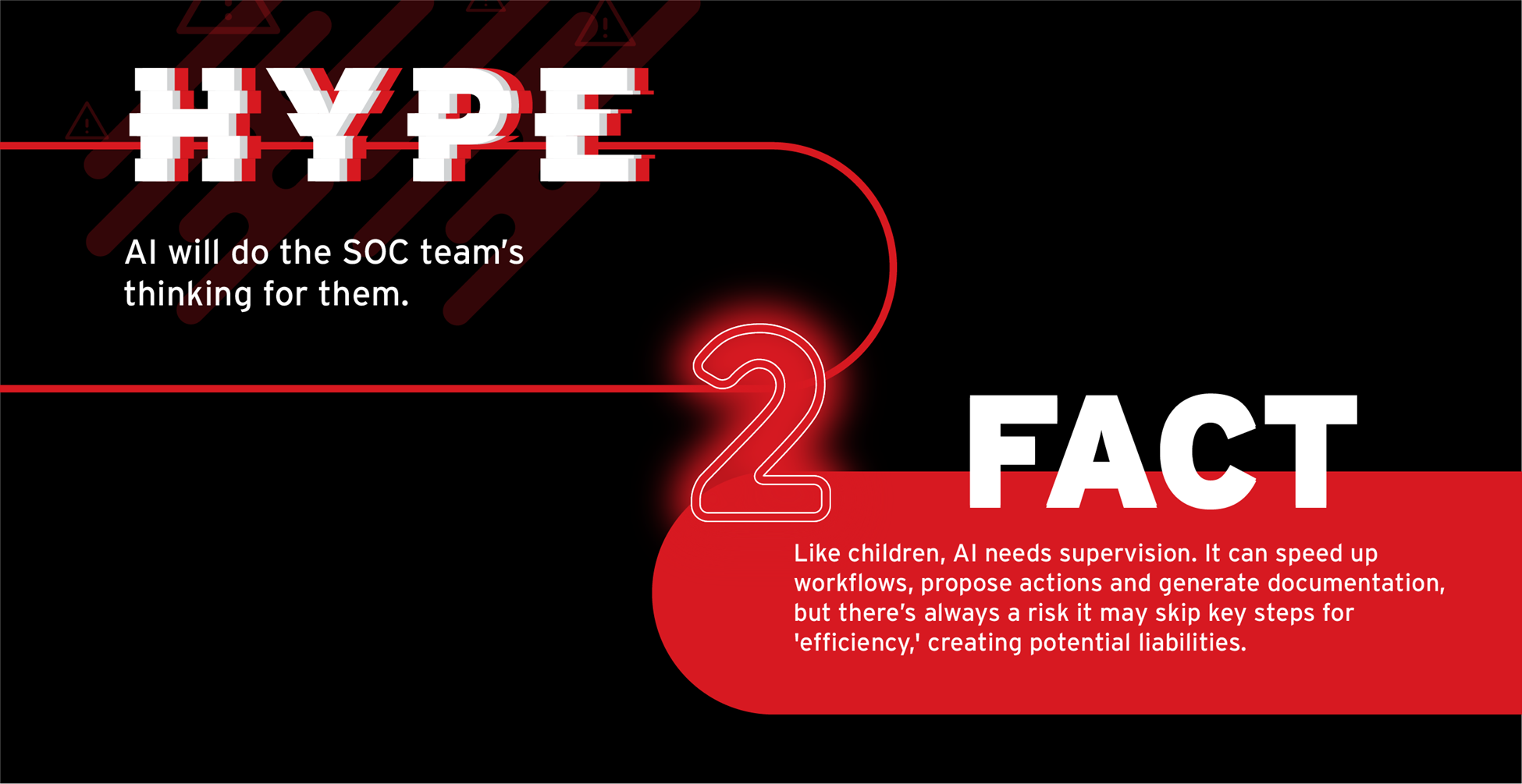

# 2 - Nutzen Sie die schnellen Erfolge

Eine Aufgabe, bei der Sicherheitsteams schnell von genAI profitieren können, ist die Erstellung von Dokumentationen. Aktionszusammenfassungen, Ereignisprotokolle und andere Arten von Berichten sind mühselig und zeitaufwändig zu erstellen. Aber die Arbeit muss getan werden. Generative KI kann diese m Handumdrehen erstellen, so dass die Sicherheitsexperten mehr Zeit haben, sich mit Events und Vorfällen zu befassen.

Einen Vorbehalt gibt es: Sicherheitsexperten benötigen gute Kommunikationsfähigkeiten, um ihre Rollen zu erfüllen. KI-generierte Berichte können Zeit sparen, dürfen aber nicht auf Kosten der beruflichen Entwicklung gehen.

GenAI kann auch schneller als ein Mensch die nächsten besten Aktionen empfehlen und bestehende Wissensdatenbanken abfragen, um verwertbare Informationen zu erhalten. Der entscheidende Faktor in diesen Fällen ist, dass die KI-Ergebnisse mit den Anforderungen und Methoden des Unternehmens übereinstimmen. Ein Beispiel: Umfasst ein definierter Prozess sieben Schritte und ein KI Companion empfiehlt vier, muss ein Mitarbeiter sicherstellen, dass alle sieben Schritte befolgt werden, - um die gewünschten Ergebnisse zu erzielen und um sicherzustellen, dass die durchgeführten Maßnahmen mit den Unternehmensrichtlinien und externen Vorschriften übereinstimmen. Unbeabsichtigte Abkürzungen könnten schwerwiegende Folgen haben.

„Es läuft nicht wie in der Fernsehserie 'Minority Report' mit der PreCrime Unit, aber zumindest kann man aus einer riesigen Datenmenge genug ablesen, um die Wahrscheinlichkeit und Art und Weise eines Angriffspfades zu bestimmen.“

David Roth

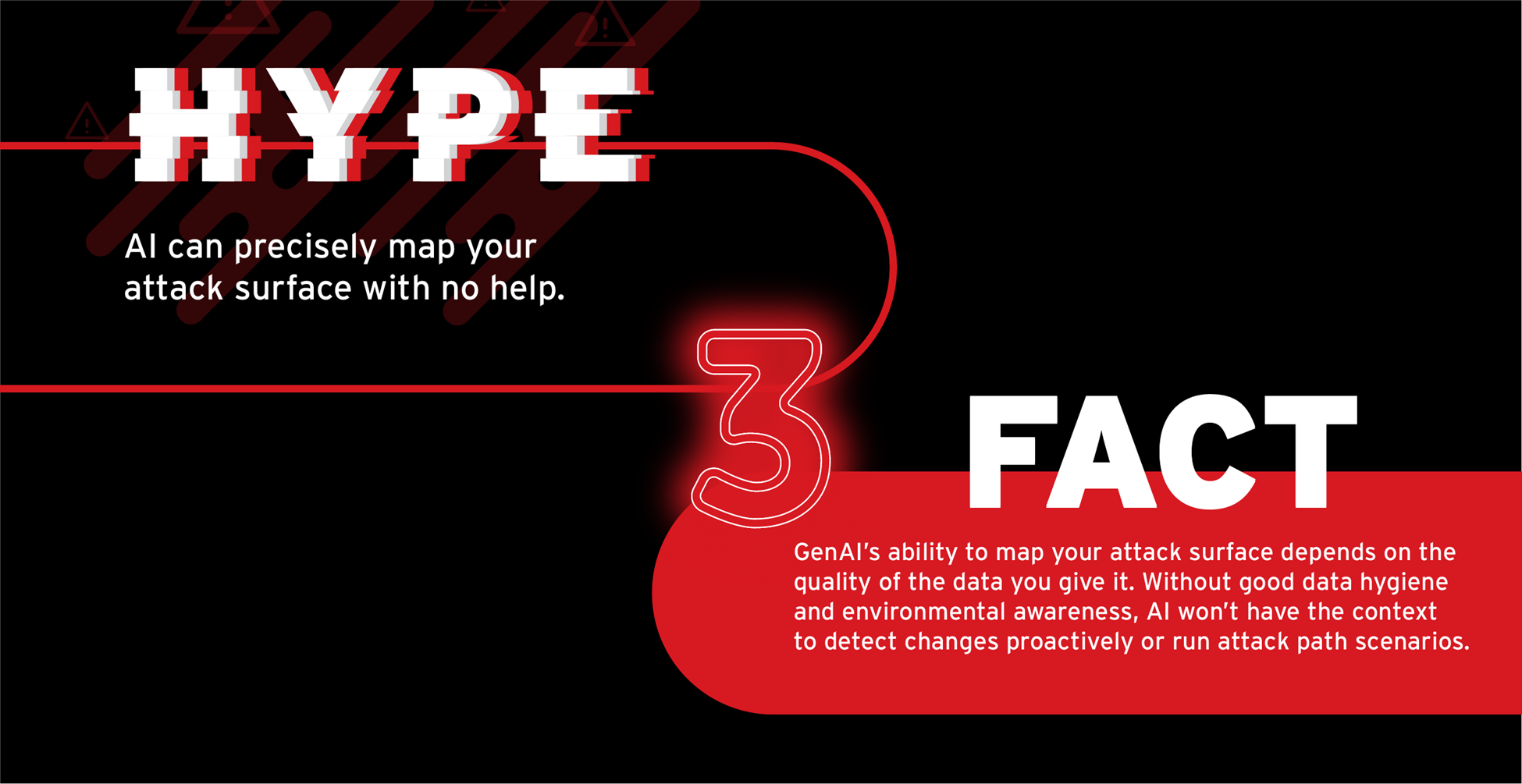

# 3 – Proaktiver sein mit KI

GenAI hat das Potenzial, das „Big-Data-Problem“ in eine Big-Data-Chance zu verwandeln und Sicherheitsteams zu ermöglichen, viel proaktiver als heute zu werden, indem sie Veränderungen in einer Angriffsfläche erkennen und Angriffspfadszenarien durchspielen. Auch wenn nicht genau vorhergesagt werden kann, was passieren wird, könnten die Experten damit Bedrohungen zuvorkommen, die sonst unbemerkt durchschlüpfen würden.

Wie effektiv sich dies in der Praxis gestalten wird, hängt davon ab, wie gut ein Unternehmen seine Systeme, Konfigurationen und aktuellen Zustände kennt. Gibt es Lücken, wird auch die KI Lücken haben. Heutzutage sind diese Lücken leider weit verbreitet, denn selbst in großen Unternehmen werden Daten und Dokumentation in mehreren Spreadsheets auf verschiedenen Computern gespeichert.

Dies macht deutlich, wie wichtig eine gute, KI-fähige Datenhygiene und die Anwendung standardisierter Ansätze für die Datenverwaltung sind. Je besser das Rohmaterial ist, desto mehr kann die KI damit anfangen.

„Wenn Sie Unternehmenssoftware in Ihrem Unternehmen einsetzen, verfügt diese jetzt über KI. Sei es SAP Joule, Salesforce mit Einstein GPT, Microsoft mit Copilot, seien es die vielen anderen Namen da draußen. Auch über diesen Bereich müssen Sie sich Gedanken machen, weil dies die Art und Weise verändert, wie Benutzer mit Unternehmensdaten interagieren.“

Jeff Pollard

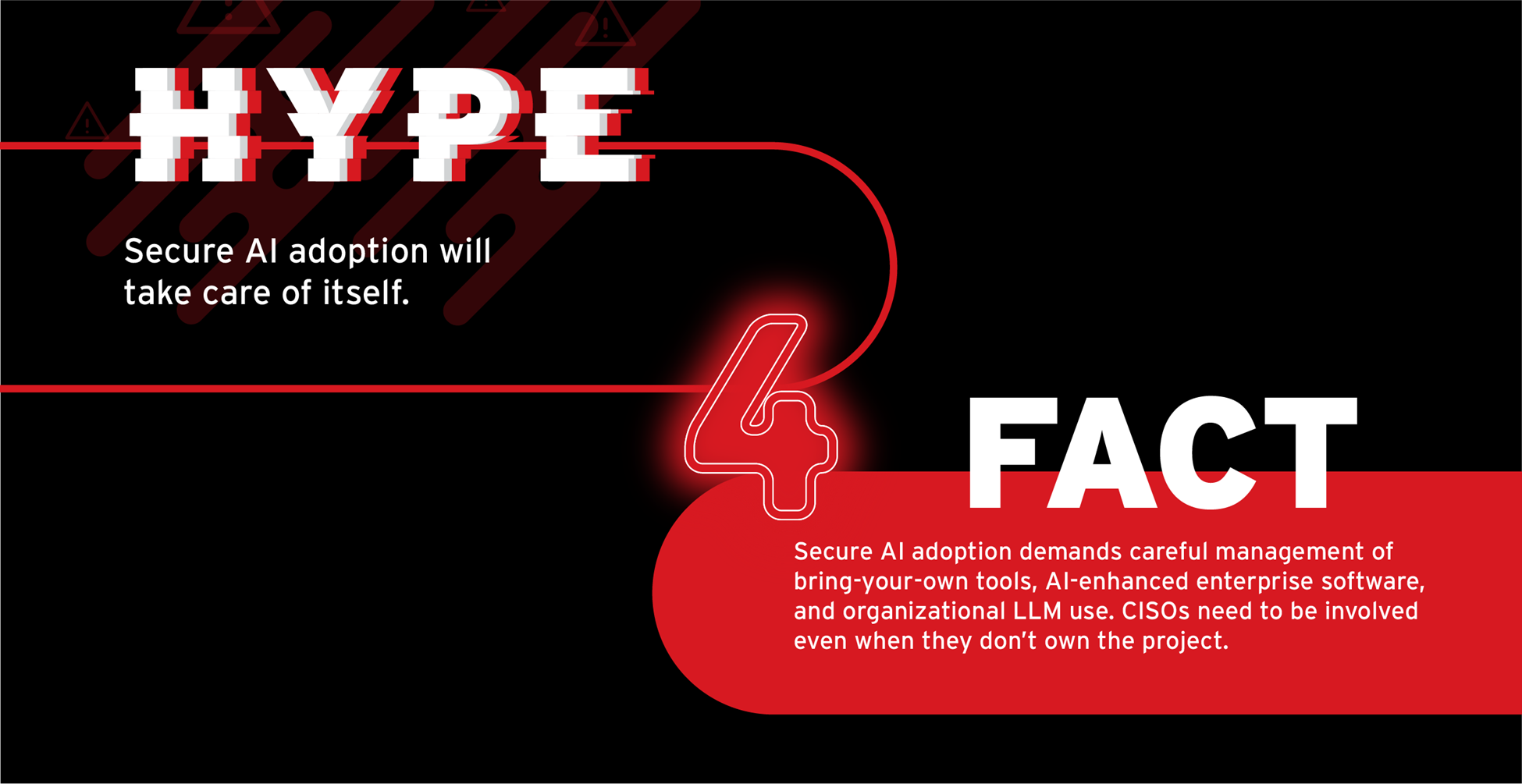

# 4 - Vorsicht vor Schatten-KI

Unternehmen haben berechtigte Bedenken, dass KI sensible Unternehmens- oder Kundendaten leakt. Dies kann durch die Nutzung nicht autorisierter Tools durch Mitarbeiter oder über sanktionierte Unternehmenssoftware geschehen, die zunehmend mit KI-Funktionen erweitert wird. Früher musste ein bösartiger Akteur wissen, wie er sich in ein ERP-System einhacken kann, um auf nicht autorisierte Daten darin zuzugreifen. Mit KI könnte der richtige Prompt die gleichen Informationen nur zu einfach zugänglich machen.

Unternehmen müssen sich vor der Schatten-KI ihrer Mitarbeiter und der unrechtmäßigen Nutzung zugelassener KI-Tools schützen. Sie müssen auch dafür sorgen, wenn sie große Sprachmodelle (LLMs) verwenden, Anwendungen für sich selbst zu erstellen. Die zugrunde liegenden Daten müssen zusammen mit der zu erstellenden Anwendung, dem LLM selbst und dem Eingabeaufforderungssystem gesichert werden.

Diese Risiken laufen im Grunde auf eine neue Reihe von Problemen hinaus: Bring-your-own-AI-Sorgen, Enterprise-App-Probleme und solche mit der Produktsicherheit- oder Innovation. Jede dieser Typen erfordert eigene Schutzmaßnahmen und betrifft die Verantwortlichkeiten der CISOs - auch wenn diese nicht für die entsprechenden Projekte zuständig sind.

„Ich fühl mich fast an die frühen, wachstumsstarken Cloud-Tage erinnert ... Die Durchsetzung von Governance- und Sicherheitskontrollen ist schwieriger, wenn man nicht mit der Geschwindigkeit des Geschäfts Schritt halten kann.“

David Roth

# 5 - Sie brauchen eine KI-Strategie

Es gibt hilfreiche Parallelen zwischen der Begeisterung für Schatten-IT-Apps sowie den Anfängen der Cloud und dem heutigen Stand der KI. Während Sicherheitsverantwortliche nicht genehmigte Apps als „Schatten-IT“ bezeichneten, sahen Unternehmensleiter und Investoren ihre Nutzung als „produktgesteuertes Wachstum“. Und die Sicherheitsteams lernten schnell, dass sie diese Innovationen nicht verbieten konnten: Jeder Versuch sie einzudämmen, trieb die Nutzung nur in den Untergrund, wo die Dinge überhaupt nicht mehr verwaltet werden konnten.

Sicherheitsteams müssen die KI-Realität akzeptieren und sich daran anpassen. Auch wenn die KI derzeit noch nicht alle Hoffnungen und Träume ihrer glühendsten Verfechter erfüllt - und selbst wenn es einige Rückschläge gibt - wird sie in zwei bis drei Jahren viel ausgereifter und leistungsfähiger sein als heute. Unternehmen können es sich nicht leisten zu versuchen, sie zu schützen, nachdem sie eingeführt wurde.

Das bedeutet, jetzt ist die Chance da, sicherheitsorientierte KI-Strategien zu entwickeln, mehr über die Technologie zu erfahren und darauf vorbereitet zu sein, wenn sie wirklich durchstartet. Viele Beobachter glauben, dass Sicherheitsteams bei der Cloud auf dem falschen Fuß erwischt wurden, obwohl sie viel Vorlaufzeit hatten. Angesichts der Potenz und Komplexität von KI können sie es sich nicht leisten, diesen Fehler zu wiederholen.