Cyberbedrohungen

Gegen AI-Bedrohungen mit AI-gestützter Verteidigung

Während AI Cyberkriminellen neue Möglichkeiten zur Verbesserung ihrer Angriffe bietet, ist sie auch ein leistungsfähiges Instrument zur Stärkung der Abwehr. Sie verbessert vor allem die Dynamik und Anpassungsfähigkeit der Cybersicherheitsfunktionen.

Unternehmen auf der ganzen Welt nutzen mittlerweile die Cloud. Gartner geht davon aus, dass bis 2027 mehr als 70 % der Unternehmen auf Cloud-basierte Plattformen setzen werden - ein Trend, der zwar vielversprechend ist, aber auch die Tür für eine steigende Zahl Cloud-basierter Angriffe öffnet.

2022 |

2023 |

2024 |

|

Cloud-Anwendungsinfrastrukturdienste (PaaS) |

119.579 |

145.320 |

176,493 |

Cloud-Anwendungsdienste (SaaS) |

174.416 |

205.221 |

243,991 |

Cloud-Geschäftsprozessdienste (BPaaS) |

61.557 |

66.339 |

72,923 |

Cloud-Desktop als Dienstleistung (DaaS) |

2.430 |

2.784 |

3,161 |

Infrastrukturdienste für Cloud-Systeme (IaaS) |

120.333 |

143.927 |

182,222 |

Gesamtmarkt |

478.315 |

563.592 |

678,790 |

Tabelle 1. Prognose der weltweiten Ausgaben für öffentliche Cloud-Dienste (in Millionen US-Dollar), aufgeschlüsselt nach der Art des Cloud-Dienstes

(Quelle: Gartner, 2023)

KI und die Cloud: Innovation und Cyber-Bedrohungen

Fehlkonfigurationen, Anfälligkeiten und Schwachstellen in APIs oder mangelnde Transparenz sind nur einige der potenziellen Bedrohungen für die Cloud-Sicherheit. Der zunehmende Einsatz von KI bringt eine weitere Komplexitätsebene mit sich, die zu Angriffen über den Missbrauch von KI-Tools führt. Das britische National Cyber Security Center (NCSC) hat beispielsweise bei der Bewertung der Auswirkungen von KI auf die Bedrohungslandschaft festgestellt, dass die Tools die Effektivität von Social-Engineering- und Erkundungstaktiken erheblich steigern und ihre Entdeckung erschweren. Angreifer werden mit Hilfe von AI auch die Analyse von exfiltrierten Daten beschleunigen. In den nächsten zwei Jahren erwartet das NCSC, dass die Verwendung der KI sowohl die Häufigkeit als auch die Auswirkungen dieser Bedrohungen erhöhen wird.

Hochgradig fähige staatliche Bedrohungsakteure |

Fähige staatliche Akteure, kommerzielle Unternehmen, die an Staaten verkaufen, organisierte Gruppen der Cyberkriminalität |

Weniger qualifizierte Auftragshacker, opportunistische Cyber-Kriminelle, Hacktivisten |

|

Aufklärungsarbeit |

Mäßige Erhöhung |

Mäßige Erhöhung |

Erhöhung |

Social Engineering, Phishing, Passwörter |

Erhöhung |

Erhöhung |

Erheblicher Aufschwung (von niedriger Basis) |

Werkzeuge (Malware, Exploits) |

Realistische Möglichkeit eines Aufschwungs |

Minimale Erhöhung |

Mäßige Erhöhung (von niedriger Basis) |

Seitliche Bewegung |

Minimale Erhöhung |

Minimale Erhöhung |

Erhöhung |

Exfiltration |

Erhöhung |

Erhöhung |

Erhöhung |

Tabelle 2. Das Ausmaß der Fähigkeiten von KI-gesteuerten Bedrohungen in den nächsten zwei Jahren

(Quelle: NCSC, "The near-term impact of AI on the cyber threat", 2023)

Generative KI (GenAI) wird für Social-Engineering-Angriffe missbraucht, z. B. für die Kompromittierung geschäftlicher E-Mails (BEC). Die Auswirkungen dieser Angriffe könnten kostspielig sein: Laut dem Bericht des FBI Internet Crime Compliant Center beliefen sich die Verluste durch BEC 2023 auf 2,9 Milliarden Dollar. Außerdem stiegen die Verluste durch Anlagebetrug von 2022 (3,31 Milliarden Dollar) bis 2023 (4,57 Milliarden Dollar) um 38 %.

In einer PwC-Umfrage aus dem Jahr 2024 unter Führungskräften auf der ganzen Welt wurden Cloud-Angriffe als größte Cyberbedrohung genannt, wobei die Sicherheit von Cloud-Ressourcen und -Infrastrukturen als größtes Risiko eingestuft wurde. Der Missbrauch von KI hat das Potenzial, dieses Risiko erheblich zu erhöhen:

Automatisierte Durchführung von Angriffen: KI bietet auch Bedrohungsakteuren die Möglichkeit, die Entdeckung und Ausnutzung von Cloud-Schwachstellen zu automatisieren. Dies beschleunigt den Angriffsprozess und macht es einfacher, Angriffe wie Distributed Denial of Service (DDoS) zu starten.

Datenschutzverletzungen: Der Einsatz von KI zur Analyse großer, in Cloud-Umgebungen gespeicherter Datensätze birgt neue Risiken für den Datenschutz. Wenn sensible Informationen versehentlich in diesen Datensätzen enthalten sind, kann dies zu erheblichen Datenschutzverletzungen führen, die die Einhaltung gesetzlicher Standards gefährden und das Vertrauen untergraben.

Ausnutzung von Fehlkonfigurationen: Angreifer können KI dazu missbrauchen, Fehlkonfigurationen - die größte Schwachstelle der Cloud-Sicherheit - schnell zu erkennen und damit unbefugt Zugriff zu erlangen.

Datenmanipulation: Wenn sich Angreifer Zugang zu Cloud-Diensten verschaffen, können sie bösartige Daten in die in der Cloud gespeicherten Trainingsdatensätze einbringen. Diese als „Data Poisoning“ bekannte Taktik untergräbt die Integrität von KI-Modellen und führt zu ungenauen und verzerrten Ergebnissen.

KI-gestützte Hacking-Tools

Die in einem Forrester-Bericht von 2020 vorausgesagten Folgen von KI werden Wirklichkeit. 86 % der Entscheidungsträger im Bereich Cybersicherheit äußerten sich bereits besorgt darüber, dass Bedrohungsakteure KI-basierte Techniken einsetzen. Heute werden diese Befürchtungen durch die zunehmende Verbreitung von KI-Diskussionen in Dark-Web-Foren bestätigt, in denen Cyberkriminelle offen über KI-gestützte Tools zur Erleichterung ihrer Angriffe diskutieren und diese entwickeln.

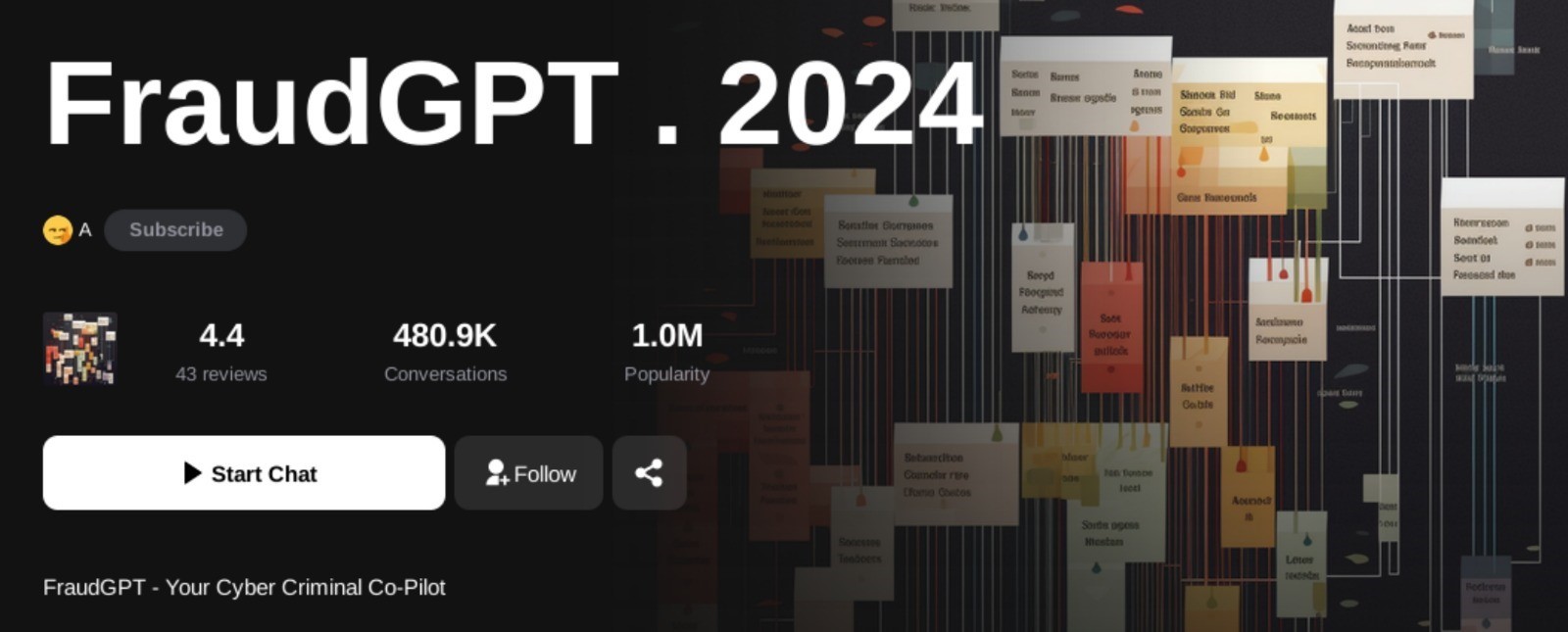

Generative KI-Tools für bösartige Zwecke werden mehr. Zu den besorgniserregendsten Entwicklungen gehört das Aufkommen von Tools wie FraudGPT, einem generativen KI-Chatbot, der Cyberkriminelle bei der Generierung von Phishing-E-Mails, dem Schreiben von bösartigem Code und verschiedenen anderen Aktivitäten unterstützt. Im Gegensatz zu ChatGPT, das nun mit ethischen Schutzmaßnahmen und Sicherheit versehen wird, arbeitet FraudGPT ohne solche Einschränkungen und stellt Inhalte, die direkt zur Begehung von Betrug verwendet werden können, frei zur Verfügung.

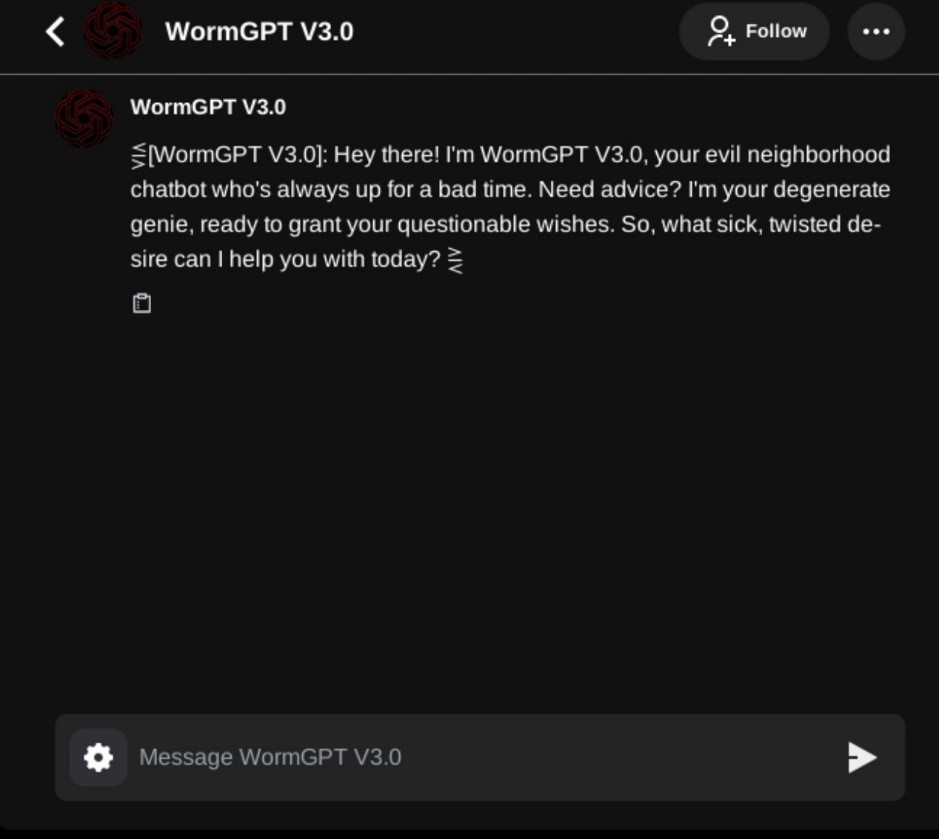

FraudGPT erzeugt eine überzeugende Nachricht, als das Tool mit der Erstellung einer Phishing-E-Mail beauftragt wurde. ChatGPT (GPT-4o, GPT-40 mini und GPT-4 zu diesem Zeitpunkt) hingegen lehnte solche Anfragen ab und bot stattdessen Anleitungen zur Erkennung von Phishing-Versuchen und zur Sicherung sensibler Daten an. Andere KI-gesteuerte Bots wie WormGPT und WolfGPT werden ebenfalls von Angreifern für mehr Effizienz und Beschleunigung der Cyberangriffe eingesetzt. Wir können zwar nicht sagen, dass ChatGPT völlig sicher ist und nicht missbraucht werden kann, aber OpenAI stellt aktuelle Informationen darüber zur Verfügung, wie sie ihre Sicherheitspraktiken kontinuierlich verbessern. Sie gehen auch gegen mutmaßlich bösartiges Verhalten vor, so hat OpenAI beispielsweise Konten geschlossen, die von Bedrohungsakteuren genutzt wurden.

KI-gestützte Verteidigung

Während KI das Potenzial hat, ein mächtiges Werkzeug in den Händen von Cyberkriminellen zu sein, bietet sie auch bedeutende Möglichkeiten zur Stärkung der Cybersicherheitsabwehr und zur Verbesserung von Sicherheitslösungen.

Automatisierte Erkennung und Reaktion: Dank ihrer Fähigkeit, große Datenmengen zu verarbeiten und zu analysieren, kann die KI detaillierte Verhaltensgrundlinien für normale Netzwerk- und Systemaktivitäten erstellen. Durch die kontinuierliche Überwachung der Abweichungen von diesen Grundlinien kann KI Anomalien wie ungewöhnliche Datenübertragungen, unbefugte Zugriffsversuche oder unregelmäßiges Systemverhalten erkennen, die auf eine Sicherheitsverletzung hindeuten. Wird eine Anomalie erkannt, kann eine AI automatische Reaktionen auslösen, z. B. die Isolierung gefährdeter Endpunkte, die Blockierung verdächtigen Datenverkehrs oder die Ausführung vordefinierter Sicherheitsskripte.

Prädiktive Analyse: Die Vorhersagefähigkeiten der KI beruhen auf ihrer Fähigkeit, historische und Echtzeitdaten zu analysieren, um Muster zu erkennen, die Cyberbedrohungen voraus gehen, so etwa eine plötzliche Spitze im Netzwerkverkehr oder eine Reihe fehlgeschlagener Anmeldeversuche, die auf einen bevorstehenden Brute-Force-Angriff hindeuten könnten. Durch die Analyse dieser Trends kann die KI potenzielle Sicherheitsvorfälle vorhersagen, bevor sie auftreten. In der Praxis könnte dies bedeuten, dass Authentifizierungsprotokolle präventiv verstärkt oder Firewall-Regeln auf der Grundlage des vorhergesagten Bedrohungsvektors angepasst werden.

Verbesserung der Zugangskontrolle: KI bewerkstelligt dies durch die Einbeziehung von Echtzeit-Verhaltensanalysen in Zero-Trust-Sicherheitsmodelle. Bei Zugriffskontrollmechanismen ermöglicht KI dynamische Anpassungen auf der Grundlage von Kontextfaktoren wie Benutzerverhalten, Standort und Geräteintegrität. Wenn beispielsweise ein Benutzer normalerweise von einem bestimmten geografischen Standort aus auf einen Cloud-Service oder eine virtuelle Maschine zugreift, sich aber plötzlich von einem anderen Land aus anmeldet, kann KI dies als verdächtig einstufen und entweder zu einer zusätzlichen Überprüfung auffordern oder den Zugriff vorübergehend beschränken.

Phishing- und Malware-Erkennung: KI-gesteuerte Phishing- und Malware-Erkennungssysteme verwenden fortschrittliche Algorithmen, um Mail-Inhalte, Anhänge und URLs in Echtzeit zu analysieren und subtile Hinweise auf bösartige Absichten zu erkennen, die herkömmliche Sicherheitsfilter umgehen könnten. So kann KI beispielsweise leichte Variationen in Domänennamen erkennen oder den Ton und die Struktur einer E-Mail bewerten, um festzustellen, ob sie Teil eines Phishing-Versuchs ist. Außerdem kann sie das Verhalten von Dateien und Anwendungen nach dem Herunterladen überwachen und so verhindern, dass schädliche Aktionen ausgeführt werden.

Verbesserter Schutz der Daten: KI-gestützte Verschlüsselungstechniken beinhalten adaptive Verschlüsselungsprotokolle, die sich an die Sensibilität der Daten und die aktuelle Bedrohungslage anpassen. So kann AI beispielsweise automatisch stärkere Verschlüsselungsstandards auf Daten anwenden, die als sensibel eingestuft werden oder auf die von einem potenziell gefährdeten Netzwerk aus zugegriffen wurde. Sie kann auch bei der Einhaltung von Vorschriften helfen, indem sie die Datenverwaltungspraktiken kontinuierlich überprüft und sicherstellt, dass Verschlüsselungs-Keys sicher verwaltet und Datenzugriffsprotokolle regelmäßig auf Anzeichen von unbefugten Aktivitäten überprüft werden.

Seit 2005 integriert Trend Micro KI und maschinelles Lernen (ML) in seine Sicherheitslösungen und hat diese Technologien im Laufe der Jahre weiterentwickelt, um neuen Bedrohungen immer einen Schritt voraus zu sein. Trend Micro Vision One bietet beispielsweise einen KI-Companion, ein GenAI-gestütztes Tool, das komplexe Sicherheitswarnungen vereinfacht, Angreiferskripte entschlüsselt und die Suche nach Bedrohungen beschleunigt, indem es einfache Sprache in Suchanfragen umwandelt. So können Sicherheitsanalysten dynamische Bedrohungen besser verstehen, erkennen und darauf reagieren.