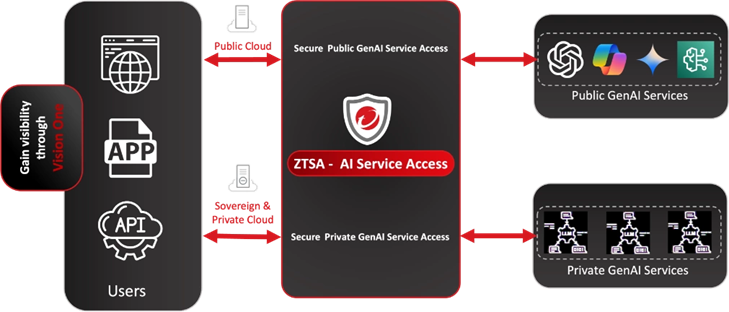

談到生成式 AI 解決方案,企業正面臨著四大關鍵資安挑戰。他們需要確保 AI 的使用方式符合法規要求,也要確保機敏資料不會意外曝光,而且 AI 模型本身也不會被用來傷害企業。除此之外,還需要讓網路和資安團隊掌握 AI 平台的可視性,以便有效管理其使用情況。Trend Vision One™ – Zero Trust Secure Access (ZTSA) – AI Service Access 能滿足這些資安需求,消除 GenAI 服務在存取控管上的漏洞,確保企業的安全。

在 GenAI 第一波普及之後,企業已開始思考一些更深入的問題:「我們如何發揮 AI 模型的最大價值?」、「這些模型未來將如何變化?」,還有,最重要的,「如何確保我們企業使用 AI 時的安全?」

就某種層面來說,這三個問題環環相扣。AI 模型需要資料來運作,到了明年,這些資料全球加起來將達到 175 ZB (zettabyte) 左右。根據 IDC 指出,這些資料有 80% 會是非結構化資料:各種螢幕截圖、AI 提示,以及協同作業應用程式訊息,絕大部分都無法採用舊式的工具來加以有效偵測及保護。

與其放任這些「非結構化資料」閒置而不加以分析 (等於對企業毫無價值),倒不如讓 GenAI 吸收這些資料並加以善用。但如果沒人知道這些資料當中包含了什麼,那麼使用 GenAI 將冒著洩漏私密資訊的風險。

此外,Gartner 分析師也指出,到了 2027 年,企業使用的 GenAI 模型將有一半以上是產業專屬或針對特定業務功能而量身打造,這比例在 2023 年僅有百分之一。如此一來,將創造出許多新的機會讓企業將營運最佳化、提高員工生產力,並且重新想像所謂的數位客戶體驗。但話說回來,隨著更多 GenAI 工具接觸到機密或敏感的營業競爭資料,那這些原本受保護的資訊遭到外流的風險將變得更大。

企業已面臨更多的風險

讓 AI 使用非結構化資料及營運資料所帶來的風險,與今日企業面臨的風險類似。例如,假使企業訓練一套 GenAI 模型來提高毛利,勢必得將各類型的企業資料餵給 AI 模型,而這些資料若沒有適當分類,就可能發生 AI 在生成內容時洩漏或濫用機敏資料的情況。

基本上,導入 GenAI 系統的企業將面臨四大主要資安挑戰:

- 可視性:網路與資安營運中心 (SOC) 團隊缺乏 AI 平台的可視性,無法監控或管制 AI 的使用並管理相關風險。這對企業的整體資安狀況將造成實質影響。

- 法規遵循:企業很難落實全企業政策並知道企業內有誰正在使用哪一項 AI 服務。

- 對外暴露:機敏資料可能因為員工與 GenAI 服務互動而洩露,或是 GenAI 本身在未經認證的服務回應當中將不適當的資料提供給終端使用者。

- 操弄:歹徒可能利用一些精心製作的輸入來操弄 GenAI 模型,藉此觸發非預期的動作,或達成惡意的目的 (也就是提示注入攻擊),例如:模型越獄/欺騙、虛擬化/角色扮演、迴避規定。

零信任方法可提供一個絕佳的框架來解決資安疑慮,同時又能讓企業跟著 GenAI 的演進而發揮其完整效益。ZTSA – AI Service Access 讓企業很容易套用,提供一套雲端原生平台來保護企業內任何存取公有或私有 GenAI 服務的使用者。

消除 GenAI 與安全存取之間的鴻溝

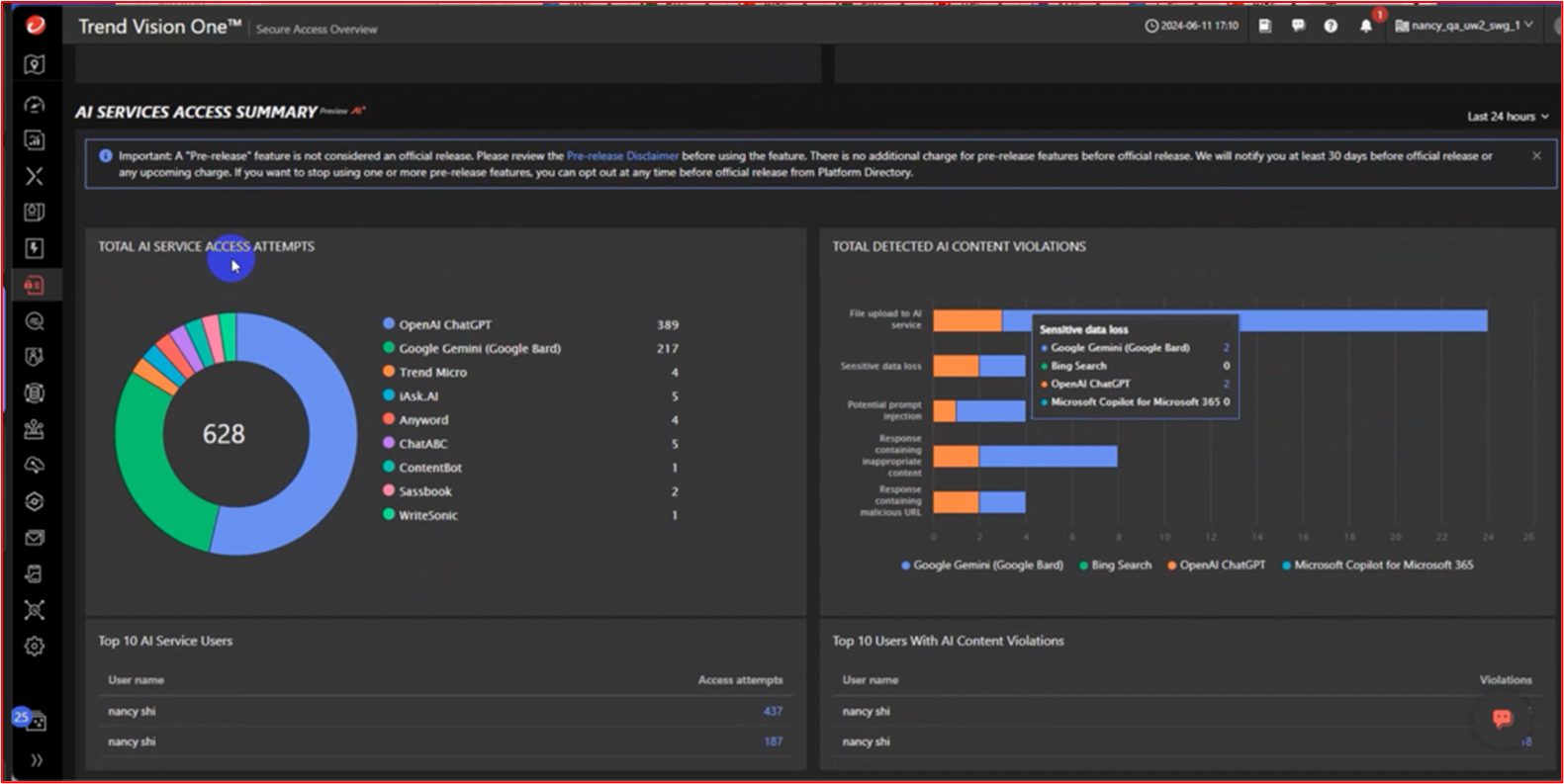

Trend Vision One™ ZTSA – AI Service Access 能為公有和私有 GenAI 服務提供零信任存取控管。它可監控 AI 的使用情況並檢查 GenAI 的提示和回應來偵測、過濾及分析 AI 內容,進而避免在公有或私有雲環境內發生機密資料外洩或輸出不安全的情況。

ZTSA – AI Service Access 包含以下核心功能:

- 即時監控所有 GenAI 活動並立即偵測 AI 內容違規情況。

- 集中管理員工對 GenAI 的存取與使用。

- 透過及時檢查來防止資料外洩與惡意的注入攻擊。

- 藉由內容過濾來確保符合法規要求。

- 防範大型語言模型 (LLM) 攻擊。

防範風險並發揮最大潛能

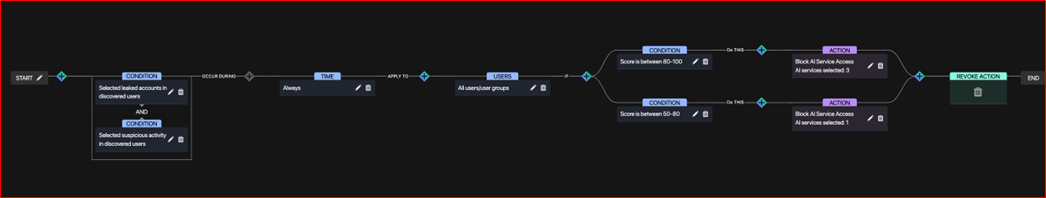

此外,ZTSA – AI Service Access 還能協助網路與資安系統管理員解決 GenAI 系統的某些風險,例如:不安全的擴充元件及延伸功能、供應鏈攻擊、針對 AI 模型的阻斷服務 (DoS) 攻擊。藉由判斷這些風險的優先次序,並主動對 GenAI 服務套用動態的風險導向存取控管,資安團隊就能強化企業的韌性。

例如,系統管理員可以針對企業內特定數量的使用者持續檢查其風險條件、持續監控使用者的風險評分,並強制實施存取控管規則以便在必要時自動封鎖使用者對 GenAI 服務的存取。

ZTSA – AI Service Access 還能讓資安團隊確保 AI 系統符合道德標準,例如透過監控和稽核 LLM 的輸出品質和準確度。這對於資安營運的透明度和責任歸屬不可或缺。

解決所有的 GenAI 資安挑戰

ZTSA – AI Service Access 能解決企業在 GenAI 資安方面的所有四大主要挑戰,並支援零信任實務。

| 資安挑戰 | ZTSA – AI Service Access 可以讓您做些什麼 |

|---|---|

| 可視性 | 存取監測資料與歷史記錄的分析及摘要,保護使用者的存取歷程。 |

| 法規遵循 | 享受全方位風險洞見所帶來的效益,套用風險導向的適應性 GenAI 服務存取控管。 |

| 對外暴露 | 檢查 GenAI 的提示/回應以避免潛在的機敏資料外洩和不預期的回應。 |

| 操弄 | 執行進階的提示注入偵測來降低 GenAI 服務遭攻擊可能帶來的風險。 |

ZTSA – AI Service Access 已整合至 Trend Vision One™ 網路資安平台當中來提供擴充性並強化企業整體資安狀況,此外也確保符合法規,並提供統一的使用體驗。有了 Trend Vision One,企業就能產生豐富、適應性的風險與資安評估,建置符合業務目標的零信任架構。在 ZTSA 底下,沒有任何使用者或裝置天生可以被信任。立即開始您的 Trend Vision One™ 試用 。

在 AI 崛起的時代與威脅情勢持續演變的情況下,所有企業,不論規模大小,也不論任何產業,都在試圖了解使用 GenAI 可能帶來的風險。有了一套零信任的 GenAI 存取控管所提供的信心,企業就能安心擁抱新的能力,並安全地釋放其商業價值。

更多趨勢科技對 AI 的觀點

請參閱以下其他文章: