La inteligencia artificial (IA) es una tecnología que empodera a las computadoras y a las máquinas para aprender, crear, resolver problemas, predecir resultados y tomar decisiones.

Índice

En su nivel más básico, la IA se refiere a las computadoras, máquinas o sistemas que usan tecnologías como machine learning (ML), redes neuronales y arquitecturas cognitivas para realizar los tipos de tareas complicadas que anteriormente solamente los seres humanos podían realizar.

Estas incluyen de todo, desde crear contenido hasta planear, razonar, comunicar, aprender de la experiencia y tomar decisiones complejas. Dicho esto, debido a que los sistemas y herramientas de IA son tan variados, no hay una sola definición que aplique perfectamente a todos.

Desde que la IA se introdujo inicialmente en los años 50, ha transformado casi todos los aspectos de la vida moderna, la sociedad y la tecnología. Con su capacidad de analizar grandes cantidades de datos, comprender patrones y adquirir nuevos conocimientos, la IA se ha convertido en una herramienta indispensable en prácticamente cada campo de la actividad humana, desde los negocios y el transporte, hasta el sector salud y la ciberseguridad.

Entre otras aplicaciones, las organizaciones usan la IA para:

- Reducir costos

- Impulsar la innovación

- Empoderar a los equipos

- Optimizar las operaciones

- Acelerar la toma de decisiones

- Consolidar y analizar los hallazgos de investigación

- Brindar soporte y servicio a los clientes

- Automatizar tareas repetitivas

- Asistir con la generación de ideas

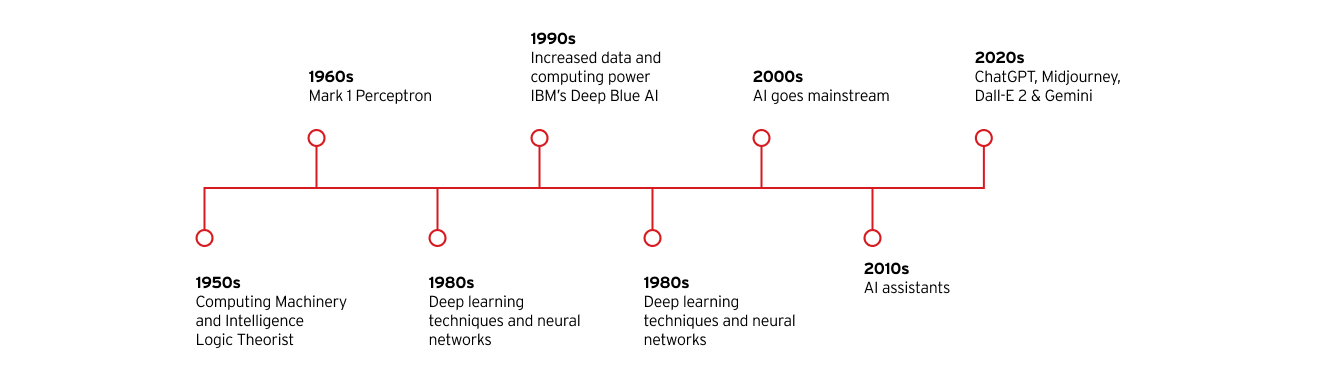

Una breve historia de la IA

La idea de una máquina que pueda pensar por sí misma se remonta a miles de años. En su contexto moderno, la inteligencia artificial como un concepto definido puede verse por primera vez en 1950, cuando el matemático y científico computacional Alan Turing, creador de la famosa “Prueba de Turing” para determinar si una computadora puede pensar como un ser humano, publicó un artículo sobre la noción de la inteligencia artificial, llamado Computing Machinery and Intelligence.

En las décadas desde que fue publicado el artículo de Turing, la IA ha evolucionado dramáticamente en su alcance y capacidades, impulsada por avances exponenciales en el poder de cómputo, el desarrollo de algoritmos, la disponibilidad de la información y la introducción de tecnologías como machine learning, minería de datos y redes neuronales.

Hitos clave en la evolución de la inteligencia artificial

Año

Hitos

1950's

- Publicación de “Computer Machinery and Intelligence” de Alan Turing

- John McCarthy acuña el término “inteligencia artificial”

- Creación de Logic Theorist, el primer programa computacional de IA

1960's

- Creación de Mark 1 Perceptron, la primera computadora en aprender por ensayo y error

1980's

- Crecimiento de técnicas de aprendizaje profundo y redes neuronales

1990's

- Un incremento en el poder de cómputo acelera el crecimiento de, y la inversión en, IA

- La computadora Deep Blue de IBM derrota al campeón mundial de ajedrez Garry Kasparov

2000's

- La IA llega al público general con los lanzamientos del motor de búsqueda impulsado por IA de Google, el motor de recomendaciones de Amazon, el sistema de reconocimiento facial de Facebook y los primeros coches autónomos

2010's

- Se introducen al público los asistentes de IA como Siri de Apple y Alexa de Amazon

- Google lanza su framework de código abierto de machine learning, TensorFlow

- La red neuronal AlexNet popularize el uso de unidades de procesamiento gráfico (GPUs) para entrenar los modelos de IA.

2020's

- OpenAI lanza la tercera generación de su modelo de lenguaje de gran tamaño (LLM) altamente popular ChatGPT

- La ola de IA generativa (GenAI) continua con el lanzamiento de generadores de imágenes como Midjourney y Dall-E 2 y chatbots con LLMs como Gemini de Google

¿Cómo funciona la IA?

Los sistemas de IA funcionan al ingerir grandes cantidades de información y al usar procesos cognitivos similares a los de los humanos para analizar y evaluar esa información. Al hacerlo de esta forma, los sistemas de IA identifican y categorizan patrones y los usan para realizar tareas o realizar predicciones de resultados sin supervisión o instrucciones directas de una persona.

Por ejemplo, un programa de IA de generación de imágenes como Midjourney que ha ingerido un gran número de fotografías puede aprender a crear imágenes “originales” de acuerdo con las instrucciones o “propmts” de un usuario. De forma similar, un chatbot de IA de servicio al cliente que ha sido entrenado con grandes volúmenes de texto puede aprender a interactuar con clientes de forma similar a los agentes humanos de servicio a cliente.

Ya que cada sistema es diferente, los modelos de IA usualmente se programan siguiendo el mismo proceso de cinco pasos:

- Entrenamiento: el modelo de IA ingiere grandes cantidades de información y usa una serie de algoritmos para analizar y evaluar la información.

- Razonamiento: el modelo de IA categoriza la información que ha recibido e identifica los patrones existentes.

- Afinamiento: conforme el modelo de IA prueba distintos algoritmos, aprende cuáles tienden a tener mejores resultados y afina sus acciones de acuerdo con ello.

- Creación: el modelo de IA usa lo que ha aprendido para realizar tareas asignadas, tomar decisiones o crear música, texto o imágenes.

- Mejora: finalmente, el modelo de IA realiza ajustes continuos para mejorar, efectivamente “aprendiendo” de su experiencia.

Machine learning vs. deep learning

La mayoría de los sistemas modernos de IA usan una variedad de técnicas y tecnologías para simular los procesos de la inteligencia humana. Los más importantes de estos son el deep learning y el machine learning (ML). Aunque los términos deep learning y machine learning a veces se intercambian entre ellos en el uso normal, en realidad se tratan de procesos muy distintos en el contexto del entrenamiento de modelos de IA.

Machine learning usa algoritmos para analizar, categorizar, aprender y comprender grandes cantidades de información para producir modelos precisos y predecir resultados sin necesidad de decirle exactamente cómo hacerlo.

El deep learning es una subcategoría del machine learning que logra los mismos objetivos por medio del uso de redes neuronales para imitar la estructura y función del cerebro humano. Exploraremos ambos conceptos a mayor profundidad más abajo.

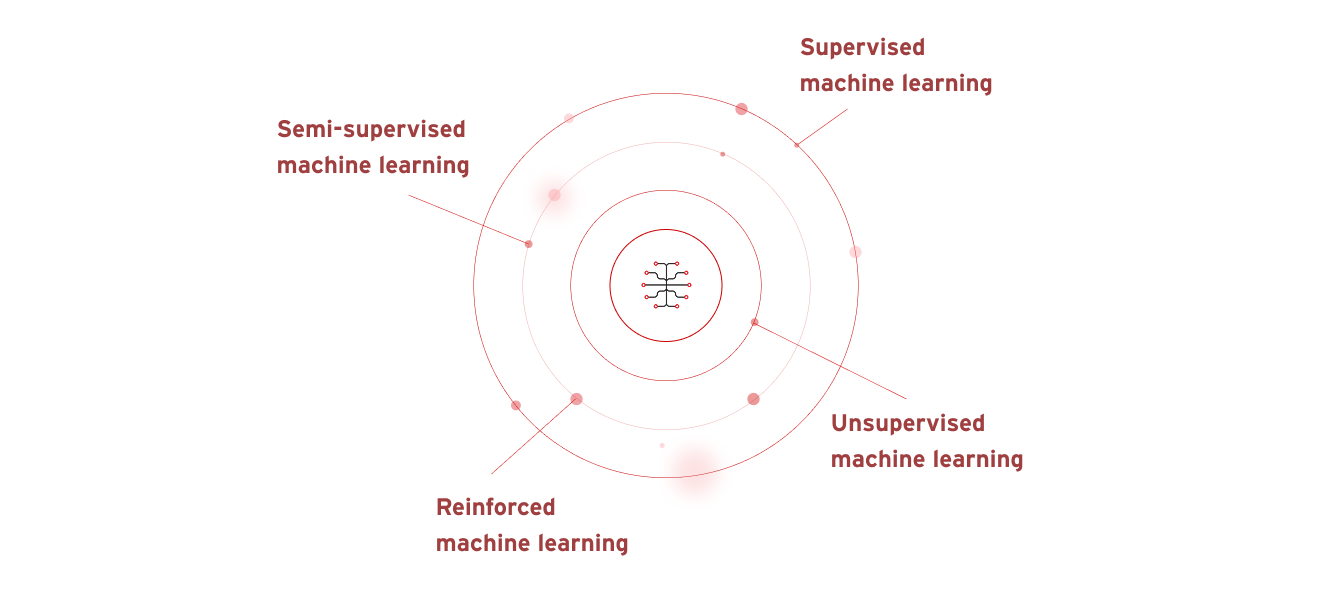

Principios básicos de machine learning

Existen 4 tipos principales de machine learning:

- Machine learning supervisado: la IA usa conjuntos de datos que son conocidos, y son establecidos y clasificados para descubrir patrones antes de dárselos al algoritmo.

- Machine learning semi-supervisado: la IA se entrena con un conjunto pequeño y etiquetado de datos conocidos, lo cual entonces se aplica a conjuntos de datos más grandes, desconocidos y sin clasificar.

- Machine learning sin supervisión: la IA aprende de conjuntos de datos desconocidos, sin etiquetar y sin clasificar.

- Machine learning reforzado: el modelo de IA no está entrenado inicialmente con ningún conjunto de datos, por lo que aprende de prueba y error y altera sus comportamientos hasta que logra sus objetivos.

El machine learning es lo que habilita a los carros autónomos para responder ante cambios en el ambiente para llevar a sus pasajeros sanos y salvos a su destino final. Otras aplicaciones del machine learning abarcan una gama de funciones que van desde programas de reconocimiento de imágenes y voces, aplicaciones de traducción de idiomas, agentes de IA y minería de datos para detectar fraudes crediticios, realizar diagnósticos médicos y realizar recomendaciones de productos, marcas o posteos en redes sociales.

Deep learning y redes neuronales

El deep learning es una forma de machine learning que se basa en el uso de redes neuronales avanzadas, o algoritmos de machine learning que emulan el funcionamiento de las neuronas en el cerebro humano para identificar patrones complejos en grandes conjuntos de datos.

Por ejemplo, incluso los niños más jóvenes pueden distinguir a sus padres de entre otros adultos debido a que sus cerebros analizan y comparan cientos de detalles distintivos en un abrir y cerrar de ojos, desde el color de su cabello y ojos, hasta expresiones o rasgos faciales distintivos.

Las redes neuronales replican la forma en que funcionan los cerebros humanos de manera similar, analizando miles o millones de pequeños detalles en la información que reciben para poder detectar y reconocer patrones de alto nivel. Los sistemas de IA generativa (o “GenAI”) como ChatGTP de OpenAI o el generador de imágenes Midjourney, por ejemplo, usan deep learning para ingerir y analizar grandes cantidades de imágenes o textos, y entonces usan la información para crear nuevos textos o imágenes que son similares a, pero distintos de, la data original.

¿Cuáles son los últimos desarrollos en IA?

En años recientes, innovaciones en el procesamiento del lenguaje natural, la visión informática (computer vision), el aprendizaje de refuerzo y las tecnologías de vanguardia como las redes generativas adversarias (GANs), los modelos de transformación y las máquinas habilitadas por IA (AIEMs) han expandido de forma importante las capacidades de los sistemas de IA para imitar los procesos de la inteligencia humana, generar contenidos más realistas y realizar tareas cada vez más complejas.

Avances en machine learning y deep learning

En años recientes, innovaciones en el procesamiento del lenguaje natural, la visión informática (computer vision), el aprendizaje de refuerzo y las tecnologías de vanguardia como las redes generativas adversarias (GANs), los modelos de transformación y las máquinas habilitadas por IA (AIEMs) han expandido de forma importante las capacidades de los sistemas de IA para imitar los procesos de la inteligencia humana, generar contenidos más realistas y realizar tareas cada vez más complejas.

Avances en machine learning y deep learning

Los avances en los algoritmos de machine learning y deep learning han permitido que los investigadores y los desarrolladores puedan crear sistemas increíblemente sofisticados de IA para aplicar en una gran variedad de contextos en el mundo real.

Los chatbots de IA, por ejemplo, se usan en millones de negocios todos los días para responder preguntas, vender productos e interactuar con los cilentes. Las empresas también usan algoritmos de IA para descubrir tendencias de acuerdo con las compras anteriores de un cliente y realizar recomendaciones personalizadas de nuevos productos, marcas o servicios.

En el campo del reconocimiento automático de voz (ASR), los servicios de IA como Siri y Alexa usan procesamiento de lenguaje natural (NLP) para traducir el habla humana a contenido escrito. De forma similar, los avances en las redes neuronales de “visión informática” potenciadas por IA han hecho más fácil etiquetar fotos en redes sociales y han hecho más seguros a los coches autónomos.

Otros ejemplos de IA usando machine o deep learning incluyen algoritmos automatizados de comercio de acciones, robots inteligentes que pueden realizar tareas repetitivas en fábricas o líneas de ensamblaje y el uso de machine learning para ayudar a bancos a detectar transacciones sospechosas y evitar fraudes.

El rol de la IA en la ciberseguridad

Cuando se trata del rol de la IA en la ciberseguridad, existen dos áreas distintas pero relacionadas que deben considerarse: Seguridad de IA y IA para la ciberseguridad

La seguridad de IA (también llamada seguridad para IA) se refiere al uso de medidas de ciberseguridad para proteger el stack de IA de una organización, reducir o eliminar los riesgos de seguridad de IA y proteger cada sistema, componente y aplicación de IA a través de la red, desde los endpoints hasta los modelos de IA. Incluye:

- Proteger el stack, modelos, infraestructura y datos de entrenamiento de la IA ante ataques

- Mantener la integridad de la información de los pipelines de machine learning y deep learning

- Abordar los problemas de sesgos, transparencia y otras preocupaciones éticas respecto a la IA

Asegurar que el uso o el desarrollo de la IA cumple completamente con todas las leyes, políticas y regulaciones relevantes.

La IA para la ciberseguridad cubre todas las formas en las que las herramientas habilitadas por IA pueden mejorar proactivamente las defensas de una organización de forma más rápida y efectiva de lo que podría cualquier equipo humano de ciberseguridad o centro de operaciones de seguridad (SOC). Esto incluye usar la IA para:

- Identificar las ciberamenazas y defender ante ciberataques en tiempo real

- Eliminar brechas y vulnerabilidades más rápido y con mayor precisión

- Automatizar la detección y respuesta ante amenazas y otras herramientas de ciberseguridad para una respuesta más rápida ante incidentes

- Mejorar la inteligencia de amenazas para una gestión de amenazas más eficiente

- Automatizar las tareas de rutina como escaneo de vulnerabilidades y análisis de logs para liberar a los equipos humanos para abordar tareas más complejas.

Ejemplos de las aplicaciones de la IA en la ciberseguridad

Las organizaciones ya están usando la IA en una gran variedad de formas para mejorar su postura de seguridad, detectar y responder ante los ciberataques y defender sus redes contra amenazas como brechas de datos, ataques DDoS (distributed denial-of-service), ransomware, malware, phishing y amenazas a identidades.

En el área de detección y respuesta ante amenazas, la IA puede identificar y predecir las ciberamenazas, analizar patrones en logs de actividades y el tráfico de la red, autentificar y proteger contraseñas e inicios de sesión de usuarios, usar reconocimiento facial y CAPTCHAs, simular ciberataques, escanear para detectar vulnerabilidades en la red y crear defensas automatizadas contra amenazas nuevas o emergentes. Esto incluye herramientas como:

- Firewalls de próxima generación impulsados con IA (NGFWs)

- Gestión de eventos e información de seguridad de IA (SIEM)

- Sistemas de seguridad de IA para la nube y para endpoints

- Detección y respuesta en la red con IA (NDR)

- Detección y respuesta extendidas con IA (XDR)

En caso de ocurrir un ataque, la IA también puede ofrecer estrategias efectivas de remediación o responder automáticamente ante los incidentes de seguridad de acuerdo con las políticas y playbooks existentes de la organización. Esto puede ayudar a reducir los costos y minimizar los daños sostenidos en un ataque, y permitir una recuperación más rápida.

¿Cuáles son las consideraciones éticas en el desarrollo y el uso de la IA?

La IA claramente ofrece una variedad de ventajas sobre otros tipos de sistemas de cómputo. Pero, como con cualquier otra tecnología, existen riesgos, desafíos y cuestiones éticas que necesitan considerarse en el desarrollo, adopción y uso de la IA.

Sesgos

Los modelos de IA son entrenados por seres humanos usando información existente. Esto crea un riesgo de que el modelo pueda reflejar o reforzar cualquier sesgo implícito en el contenido que consume. Estos sesgos podrían potencialmente dar lugar a discriminación, injusticias o inigualdades en los algoritmos, predicciones o decisiones que se toman usando esos modelos.

Además, debido a que el contenido que crean puede ser muy realista, las herramientas de GenAI tienen el potencial de ser usadas con fines maliciosos para propagar desinformación y contenidos dañinos, además de video, audio e imágenes tipo deepfake.

Inquietudes de privacidad

También existen preocupaciones alrededor del desarrollo y el uso de la IA, especialmente en sectores como el financiero, servicios legales o el sector salud que lidian todos los días con información altamente sensible, personal y/o confidencial.

Para proteger esta información, las aplicaciones impulsadas por IA deben seguir mejores prácticas alrededor de seguridad, privacidad y protección de datos. Esto incluye usar técnicas de anonimización de datos, implementar encriptaciones robustas y usar defensas avanzadas de ciberseguridad para proteger contra el robo de información, brechas de datos y hackers.

Cumplimiento de normativas

Muchas agencias y marcos regulatorios como el GDPR (General Data Protection Regulation) requieren que las empresas sigan reglas muy claras cuando se trata de la protección de información personal, asegurando la transparencia, la rendición de cuentas y la protección de la privacidad.

Para cumplir con estas regulaciones, las organizaciones deben asegurarse de contar con políticas corporativas de IA para monitorear y controlar la información que se usa para crear nuevos modelos de IA, y para proteger cualquier modelo de IA que pudiese contener información sensible.

¿Cuál es el futuro de la IA?

Lo que sucederá en el futuro respecto a la IA es, por supuesto, imposible de predecir. Pero es posible asumir con base en la información que tenemos actualmente algunas tendencias en el uso de la IA y de la tecnología misma.

Tendencias emergentes en la investigación de IA

Respecto a la investigación de IA, innovaciones en los sistemas autónomos de IA, meta-AI y meta-learning, modelos de lenguaje de gran tamaño (LLMs) de código abierto, gemelos digitales, el uso de red teams para validar riesgos y la toma conjunta de decisiones entre IA y humanos podrían revolucionar la forma en que se desarrolla la IA.

Nuevos y complejos sistemas como la IA neurosimbólica, las máquinas habilitadas con IA (AIEMs) y el machine learning cuántico también podrían incrementar el alcance de las capacidades de los modelos, herramientas y aplicaciones de IA.

Otra tecnología que tiene el potencial de revolucionar la forma en que funciona la IA es el agentic AI de próxima generación; es decir, una IA que tiene la capacidad de tomar decisiones y actuar por sí misma, sin dirección, supervisión o intervención humana.

De acuerdo con Gartner, para el 2028 el agentic AI podría usarse para tomar hasta el 15% de las decisiones diarias en un espacio laboral. Las interfaces de usuario (UI) del agentic AI también podrían volverse más proactivas conforme aprenden a actuar como agentes humanos con personalidades definidas, llevar a cabo tareas complejas, tomar decisiones importantes y brindar recomendaciones más personalizadas.

Impactos potenciales de la IA en la fuerza laboral

Conforme la IA incrementa sus eficiencias operativas y se adueña de las tareas rutinarias; y conforme motores de GenAI como ChatGPT y Midjourney se vuelven más poderosos y se usan de forma más común, existen inquietudes válidas acerca de su posible impacto en los empleos en distintas industrias.

Pero, al igual que la introducción el internet, las computadoras personales, los teléfonos celulares y otras tecnologías que en su momento cambiaron el mundo, la IA probablemente también creará nuevas oportunidades, incluso tal vez nuevas industrias enteras que requieran de personal altamente capacitado.

Como resultado, en lugar de pensar en la pérdida de empleos, el desafío mayor podría ser determinar cómo capacitar a los empleados para estas nuevas oportunidades, y facilitar su transición a nuevas ocupaciones.

El rol de la IA en los desafíos globales

Además de mejorar la eficiencia operativa y mejorar la ciberseguridad, la IA tiene el potencial de ayudar a resolver algunos de los desafíos más grandes que enfrenta la humanidad actualmente.

En el sector salud, la IA puede ayudar a los doctores a realizar diagnósticos más precisos y de forma más rápida, dar seguimiento a epidemias y pandemias futuras, y acelerar el descubrimiento de nuevos medicamentos, tratamientos y vacunas.

La IA podría mejorar la velocidad y la eficiencia de los servicios de respuesta a emergencias como desastres naturales y eventos climáticos severos.

La IA también podría ayudar a abordar el tema del cambio climático al optimizar el uso de la energía renovable, reducir la huella de carbono de las empresas, dar seguimiento a la deforestación y al nivel de contaminación en los océanos, y mejorar la eficiencia de los procesos de reciclaje, tratamiento de agua y gestión de desechos.

Otras tendencias y desarrollos probables

Otras posibles tendencias, funcionalidades y aplicaciones de la IA incluyen:

- Seguridad para modelos de lenguaje de gran tamaño (LLMs) para proteger a los LLMs ante ataques maliciosos, malos usos en general, accesos no autorizados y otras ciberamenazas. Esto incluye medidas para proteger la información, modelos y sistemas y componentes asociados de los LLMs.

- IA personalizada y centrada en el usuario para brindar un servicio a clientes más personalizado e inteligente, incluyendo para marketing.

- Uso de los modelos de IA para facilitar la operación de los red teams y gemelos digitalesal simular ataques a los sistemas de la organización para detectar vulnerabilidades y mitigar cualquier falla o debilidad.

¿Dónde puedo obtener ayuda con IA y ciberseguridad?

Trend Vision One™ entrega una protección de punta a punta incomparable para el stack completo de IA en una sola plataforma unificada.

Aprovechando las funcionalidades variadas de Trend Cybertron, la primera IA proactiva de ciberseguridad del mundo, Trend Vision One incluye una suite de funcionalidades de IA agentic que continúan evolucionando de acuerdo con la inteligencia del mundo real y las operaciones de seguridad.

Esto le permite adaptarse rápidamente a las amenazas emergentes para mejorar la postura de seguridad de una organización, mejorar las eficiencias operativas, transformar las operaciones de seguridad de un enfoque reactivo a uno proactivo, y proteger cada capa de la infraestructura de IA.

Fernando Cardoso es el Vice Presidente de Gestión de Productos en Trend Micro, enfocándose en el siempre cambiante mundo de la IA y la nube. Su carrera comenzó como Ingeniero de Ventas y de Redes, donde desarrolló sus habilidades en data centers, la nube, DevOps y ciberseguridad, áreas que continúan apasionándolo.

Preguntas Frecuentes

¿Qué es la IA?

La inteligencia artificial (o IA) es una computadora que usa tecnología para imitar la forma en que los humanos piensan y toman decisiones.

¿Qué es lo que realmente hace la IA?

Los modelos de IA usan algoritmos complejos que aprovechan grandes cantidades de información "aprendida" para calcular respuestas a las preguntas de los usuarios o generar contenido de acuerdo con los “prompts” o solicitudes de los usuarios.

¿Siri es una IA?

Siri, por ejemplo, es una forma sencilla de IA que usa tecnologías como machine learning y reconocimiento de voz para comprender y responder ante el habla humana.

¿La IA es buena o mala?

Como todas las tecnologías, la IA no es inherentemente buena o mala. Es una herramienta que puede usarse de forma tanto positiva como negativa.

¿Cuál es el objetivo principal de la IA?

El objetivo principal de la IA es que las computadoras tomen decisiones más inteligentes, logren realizar tareas más difíciles y aprendan de su experiencia sin necesitar intervención humana constante.

¿Por qué fue creada la IA?

La IA se desarrolló para ayudar a automatizar tareas repetitivas, resolver problemas complejos e impulsar la innovación a través de múltiples industrias.

¿Cuáles son los riesgos de la IA?

Algunos riesgos que trae consigo la IA tienen que ver con sesgos, riesgos de privacidad, riesgos de ciberseguridad y que potencialmente reemplace la labor humana en algunas cosas.

¿Quién hizo la IA?

Se considera que los “padres de la IA” de forma no oficial son los científicos computacionales Alan Turing (1912 – 1954) y John McCarthy (1927 – 2011).

¿Qué es la IA en la vida real?

Hay muchos ejemplos de la IA en nuestras vidas diarias, desde el software en los smartphones hasta los chatbots que responden a preguntas comunes en el servicio a clientes.

¿Qué es una IA simple?

Algunos ejemplos de IAs sencillas incluyen asistentes como Siri o Alexa, motores de búsqueda como Google, chatbots de servicio al cliente e incluso aspiradoras inteligentes.

¿Cuáles son las desventajas de la IA?

Algunas desventajas de la IA incluyen riesgos de ciberseguridad, de privacidad, sesgos y el potencial de reemplazar la labor humana en ciertos campos.

¿Cuáles son 5 desventajas de la IA?

Dependiendo de cómo se use, la IA puede causar la pérdida de empleos, generar desinformación, comprometer la información privada, reducir la creatividad y llevar a que se dependa demasiado de la tecnología.

¿Cómo puedo apagar la IA?

La mayoría de las herramientas de IA se pueden encender o apagar en las configuraciones de los teléfonos, computadoras, aplicaciones o sitios web.

¿Puedo usar IA gratis?

Muchas herramientas de IA como motores de búsqueda o Alexa son completamente gratuitos. Otros, como ChatGPT, tienen opciones gratuitas y pagadas. La IA de grado comercial usualmente sólo existe en modalidad pagada.

¿Cuál es la IA que es totalmente gratis?

La mayoría de las empresas de IA ofrecen versiones gratuitas introductorias, incluyendo a Microsoft Copilot, Grammarly, Google Gemini y ChatGPT.

¿Cuál es la aplicación de IA más popular actualmente?

Actualmente, las aplicaciones más populares de IA incluyen a ChatGPT, Google Maps, Google Assistant, Microsoft Copilot y Google Gemini.

¿Cuál es la aplicación de IA para escribir que todos están usando?

Algunas de las aplicaciones de IA más populares para escritores son Grammarly, ChatGPT, Writesonic, Jasper y Claude.

¿Cuál es la aplicación de IA que todos están usando gratis?

Google Gemini, Microsoft Copilot y ChatGPT son algunas de las aplicaciones más usadas actualmente.

¿Cuál es el mejor chatbot de IA actualmente?

El “mejor” chatbot va a depender de para qué lo requiera, pero algunos de los más populares son Perplexity, Google Gemini, Jasper y ChatGPT.

¿Cuál sería un ejemplo de la IA en la vida diaria?

Ejemplos comunes de la IA en la vida diaria incluyen los smartphones, motores de búsqueda de IA, chatbots de servicio a clientes y asistentes de voz digitales como Siri y Alexa.

Artículos Relacionados