Cyberbedrohungen

Gegen KI-generierten Betrug

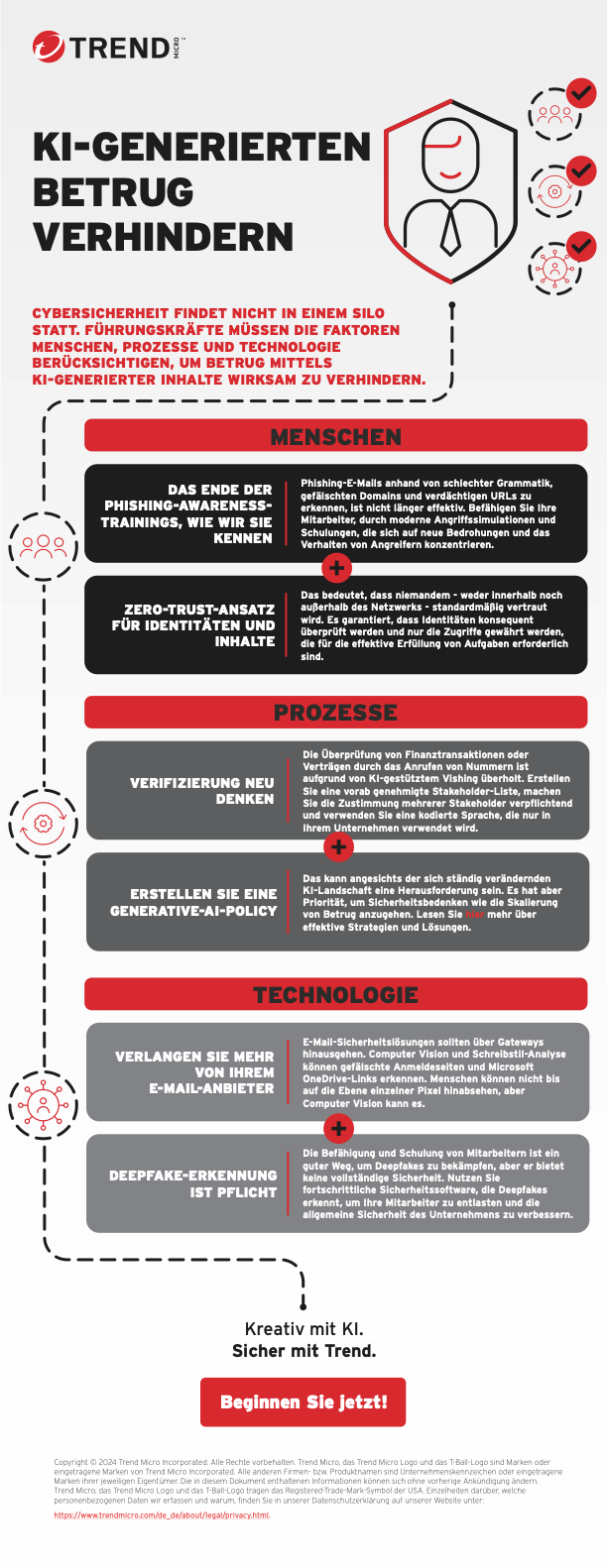

Kriminelle verbessern und beschleunigen mit KI-Tools ihre Betrugs- und Erpressungsmaschen, ob Deepfakes, Vishing et al. Für den Schutz davor bedarf es des Zusammenspiels verschiedener Maßnahmen, die Menschen, Prozesse und Technologie betreffen.

Seit dem Aufkommen von generativer KI vor zwei Jahren beschäftigt sie die Phantasie der Menschen und durchdringt immer mehr Bereiche des Lebens – klar, mit zahlreichen Vorteilen, aber auch neuen Risiken. Für 2025 sehen die Sicherheitsforscher von Trend Micro KI als wesentlichen Antrieb für kriminelle Machenschaften. KI-generierter Betrug entwickelt sich rasant weiter und ist immer schwerer zu erkennen. Das FBI warnt ebenfalls davor, dass Betrüger zunehmend künstliche Intelligenz einsetzen, um die Qualität und Wirksamkeit ihrer Online-Betrugsmaschen zu verbessern und ihren Zeit- und Arbeitsaufwand, um ihre Ziele zu täuschen, zu verringern.

Die vielfältigen Gesichter des KI-Betrugs

KI-basierte Technologien, wie generative KI-Tools sind legale Hilfsmittel, die bei der Erstellung von Inhalten unterstützen. In den Händen von Kriminellen jedoch dienen sie dazu, Verbrechen wie Betrug und Erpressung zu erleichtern. Diese potenziell bösartigen Aktivitäten umfassen den Missbrauch von Texten, Bildern, Audios und Videos.

Kürzlich berichtete Google Mandiant, dass nordkoreanische IT-Fachkräfte mit KI Persona und Bilder erstellen, die sie als Nicht-Nordkoreaner ausgeben, um bei Organisationen weltweit eine Anstellung zu finden. Sobald das funktioniert hat, generieren diese Personen Einnahmen für das nordkoreanische Regime, betreiben Cyberspionage oder versuchen gar, Malware zum Informationsdiebstahl in den Unternehmensnetzwerken zu verbreiten.

Zu den am häufigsten angewendeten kriminellen Methoden gehören Deepfakes. Diese KI-generierten Videos können Personen täuschend echt darstellen und ihnen Aussagen in den Mund legen. Sie dienen für Desinformationskampagnen, Erpressung, Identitätsdiebstahl oder sogar für betrügerische Finanztransaktionen.

Des Weiteren beliebt sind Stimmklone: Mit Hilfe von KI können Stimmen nachgebildet werden. Vishing (Voice Phishing) nutzen Betrüger dazu, um sich am Telefon als Angehörige, Geschäftspartner oder Behördenmitarbeiter auszugeben und so an sensible Informationen oder Geld zu gelangen.

KI-generierte automatisierte Fake-Profile in sozialen Medien können für Social Engineering, das Verbreiten von Falschinformationen oder sogar für Finanzbetrug genutzt werden. Ebenso können KI-gestützte Chatbots Nutzer in gefälschten Online-Shops oder auf betrügerischen Webseiten täuschen, um so an persönliche Daten oder Zahlungsdaten gelangen.

Und schließlich lassen sich mit KI personalisierte und überzeugende Phishing-Mails verfassen, die schwer von echten Nachrichten zu unterscheiden sind. Diese Mails können nun noch gezielter auf die Opfer zugeschnitten sein, was die Erkennung erschwert. Last but not least sind KI-Tools sind auch bei der Fälschung von Dokumenten nützlich, beispielsweise für gefälschte Bewerbungen oder Kreditanträge.

Schutz auf allen Ebenen

Die Bekämpfung von KI-generiertem Betrug erfordert ein Zusammenspiel verschiedener Maßnahmen: Menschen, Prozesse und Technologie müssen berücksichtigt werden.

Menschen

- Sensibilisierung und Medienkompetenz: Eine breite Aufklärung über die Möglichkeiten von KI-basierten Manipulationen ist entscheidend. Nutzer müssen lernen, kritisch mit Informationen umzugehen und Inhalte zu hinterfragen. Das traditionelle Phishing-Awareness-Training, das sich auf fehlerhafte Sprache, schlechte Grammatik und Rechtschreibung und verdächtige URLs als Indizien konzentrierte, reicht nicht mehr aus. Zu empfehlen sind moderne Angriffssimulationen und Schulungen, die sich auf neue Bedrohungen und das Verhalten von Angreifern konzentrieren. Dazu gehört auch die Förderung von Medienkompetenz, um gefälschte Inhalte besser erkennen zu können.

- Das FBI rät außerdem dazu,

- skeptisch gegenüber unerwarteten Anfragen zu sein und Informationen direkt bei der Quelle zu überprüfen.

- In Bildern/Videos sollten Empfänger zudem auf subtile Unvollkommenheiten achten (z. B. unnatürliche Handhaltung, Unregelmäßigkeiten in Gesichtern, seltsame Schatten oder unrealistische Bewegungen).

- Bei Anrufen auf unnatürlichen Tonfall oder Wortwahl, um KI-generiertes Stimmklonen zu erkennen.

- Schließlich hilft es, die öffentlich zugänglichen Inhalte der eigenen Bilder/Stimmen einzuschränken, Social-Media-Konten auf privat zu stellen und die Follower auf vertrauenswürdige Personen zu beschränken.

- Zero-Trust-Ansatz: Das Prinzip dahinter ist, niemandem standardmäßig zu vertrauen und Identitäten sowie Inhalte konsequent zu überprüfen.

Prozesse

- Verifizierung muss neu gedacht werden: Die Überprüfung von Finanztransaktionen oder Verträgen durch Verifizierungsanrufe von in Listen festgehaltenen Nummern ist aufgrund von KI-gestütztem Vishing überholt. Es wird empfohlen, eine vordefinierte Stakeholder-Liste zu erstellen, die Zustimmung mehrerer Stakeholder zu verlangen und eine kodierte Sprache zu verwenden, die nur im eigenen Unternehmen genutzt wird. Für den Einzelnen empfiehlt etwa das FBI, ein geheimes Wort oder einen Satz mit der Familie auszumachen, um die Echtheit des Anrufers zu prüfen.

- Eine Policy für GenAI: In einer unternehmensweiten Richtlinie für den Einsatz generativer KI lassen sich die Maßnahmen für die Sicherheit des KI-Einsatzes durchsetzen.

Technologie

- Authentifizierungsmethoden: Stärkere Authentifizierungsverfahren, wie z.B. die Zwei-Faktor-Authentifizierung, können den Zugriff auf sensible Konten erschweren.

- Deepfake-Erkennung: Tools, die Deepfakes automatisch erkennen können, sind noch in der Entwicklung und funktionieren nicht immer zuverlässig. Trend Micro forscht aktiv in diesem Bereich, um effektive Erkennungsmethoden zu entwickeln.

- KI-basierte Betrugserkennung: KI kann auch zur Erkennung von Betrug eingesetzt werden, indem sie Muster in großen Datenmengen analysiert und verdächtige Aktivitäten identifiziert. Trend Micro bietet mit ScamCheck hierzu eine Lösung für Privatanwender an, die auf künstlicher Intelligenz basiert.

- Erweiterte E-Mail-Sicherheit: E-Mail-Sicherheitslösungen sollten über herkömmliche Gateways hinausgehen. Um etwa gefälschte Anmeldeseiten zu erkennen, können Schreibstil-Analysen und Computer Vision, also computerbasiertes Sehen, eine wichtige Rolle spielen, denn die Technik kann bis auf die Ebene einzelner Pixel „sehen“.

Fazit

KI-generierter Betrug ist eine ernstzunehmende Bedrohung, die uns alle betrifft. Durch die Kombination von technischen Lösungen, klaren Prozessen, Aufklärung und Wachsamkeit können sowohl Verbraucher als auch Unternehmen sich besser gegen die zunehmende Bedrohung schützen. Es ist wichtig, sich der Risiken bewusst zu sein und kritisch mit Informationen umzugehen. Die stetige Weiterentwicklung der KI erfordert eine kontinuierliche Anpassung unserer Schutzmaßnahmen, um den Betrügern immer einen Schritt voraus zu sein.

Wie die einzelnen Maßnahmekategorien zusammenhängen zeigt die Infografik: