人工智慧 (AI) 是一項能讓電腦和機器學習、理解、創造、解決問題、預測結果以及做出決策的技術。

目錄

從最基本的層面來看,AI 是指使用機器學習 (ML)、神經網路、認知架構等技術來執行人類之前所能完成的複雜工作的電腦或機器系統。

包括:建立內容、規劃、推理、溝通、從經驗當中學習,以及做出複雜決策等等。儘管如此,由於 AI 系統與工具非常廣泛且各有不同,因此沒有任何單一定義可以完美應用在所有AI 系統身上。

自從 1950 年代 AI 出現以來,幾乎徹底改變了現代生活、社會和技術等各個層面。AI 能分析大量資料、了解模式並取得新的知識,幾乎成為人類活動不可或缺的工具,從商業、交通運輸、醫療到網路資安,無所不在。

除了其他應用程式之外,企業還可運用 AI 來:

- 降低成本

- 推動創新

- 賦能團隊

- 簡化營運

- 加快決策速度

- 整合和分析研究結果

- 提供即時的客戶支援與服務

- 將重複性工作自動化

- 協助產生想法

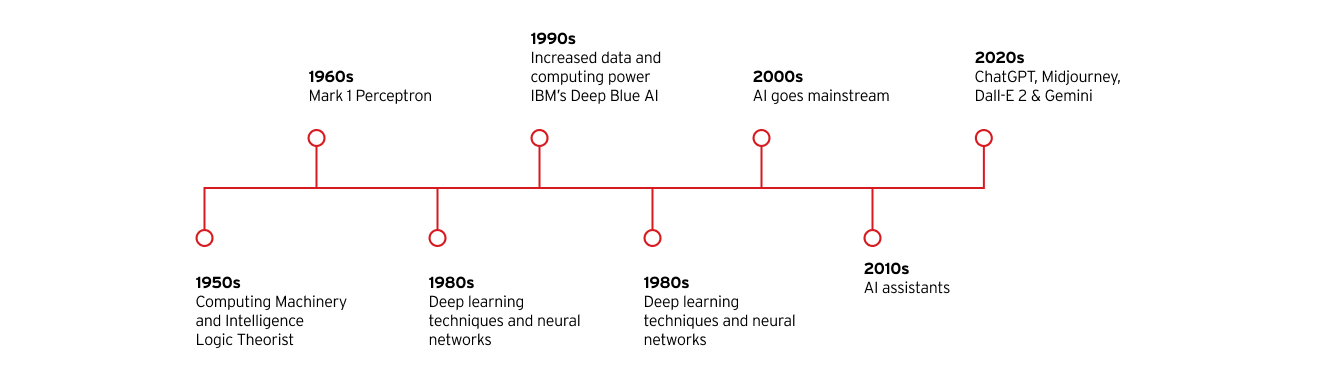

AI 的簡史

一台能夠自行思考的機器這項概念可追溯至數千年前。在現代化情境中,人工智慧這個明確的概念可追溯至 1950 年,當時知名「Turning Test (圖靈測試)」的創作者 Alan Turing 發表了一份他對人工智慧、 運算機器與智慧的概念,來判斷電腦是否能夠像人類一樣思考。

自從 Turing 發表論文以來,AI 的應用範圍和功能都出現了劇烈的演進,其動力、演算法精密度、資料可用性,以及機器學習、資料探勘和神經網路等技術所帶動的大幅進步。

人工智慧演進的重要里程碑

年度

里程碑

1950 年代

- 發表 Alan Turing 的「運算機器與智慧」

- John McCarthy 首次提出「人工智慧」一詞。

- Logic Theorist(邏輯理論家),第一個 AI 電腦程式誕生

1960 年代

- Mark 1 Perceptron問世,這是第一台可以從錯誤中學習的電腦。

1980 年代

- 深度學習技術與神經網路的成長

1990 年代

- 提升資料與運算能力,加速 AI 的成長與投資

- IBM 的 Deep Blue (深藍) AI 擊敗了世界西洋棋冠軍 Garry Kasparov

2000 年代

- 人工智慧進入主流應用,包括Google 人工智慧搜尋引擎、Amazon 商品推薦引擎、Facebook 人臉辨識系統以及第一輛自駕車推出。

2010 年代

- 像 Apple 的 Siri 和 Amazon 的 Alexa 這樣的 AI 助理相繼推出。

- Google 推出開放原始碼機器學習框架 TensorFlow

- AlexNet 神經網路利用圖形處理器 (GPU) 來訓練人工智慧模型

2020 年代

- OpenAI 發表其廣受歡迎的 ChatGPT 大語言模型 (LLM) 生成式 AI (GenAI) 第三版。

- GenAI 浪潮延續到像是 Midjourney 和 Dall-E 2 這樣的影像產生器,以及像 Google Gemini 這樣的 LLM 聊天機器人。

AI 如何運作?

AI 系統的運作方式是經由輸入或擷取大量資料,並使用類似人類的認知流程來分析及評估資料。如此一來,AI 系統就能識別並分類模式,利用這些模式來執行任務或預測未來結果,而不需人類的直接監督或指令。

例如,像 Midjourney 這樣的影像生成 AI 程式,如果收到了大量的照片,就能學習根據使用者輸入的提示來產生“『原創性』的影像。同樣的,受過大量文字訓練的客戶服務 AI 聊天機器人,也會學習如何模仿客服人員來與客戶互動。

雖然每個系統有所不同,AI 模型通常是依照相同的五個步驟進行設計。

- Training (訓練):AI 模型會匯入大量資料,並使用一系列演算法來分析和評估資料。

- Reasoning (推理):AI 模型對接收到資料進行分類,並找出其中的模式。

- Fine-tuning (微調):當 AI 模型嘗試不同的演算法時,它會學習哪些演算法更接近成功,並據此微調其動作。

- 創作:AI 模型會運用所學到的知識來執行指派的工作、做出決策,或是製作音樂、文字或影像。

- 改善,最終,AI 模型會不斷調整以改善其準確性,並從經驗中有效學習。

機器學習與深度學習

大多數現代 AI 系統都使用多種技術與方法來模擬人類智慧的運作過程。其中最重要的就是深度學習與機器學習 (ML)。雖然「機器學習」與「深度學習」這兩個術語有時會被交替使用,但在 AI 訓練的情境中,它們其實是非常不同的過程。

機器學習使用演算法來分析、分類、排序、學習及理解大量資料,進而產生精準的模型並預測結果,而不需被明確告知該如何執行。

深度學習是一種機器學習的子類別,它利用類神經網路來模擬人類大腦的結構和功能,進而達成相同的目標。以下我們將詳細說明這兩個概念。

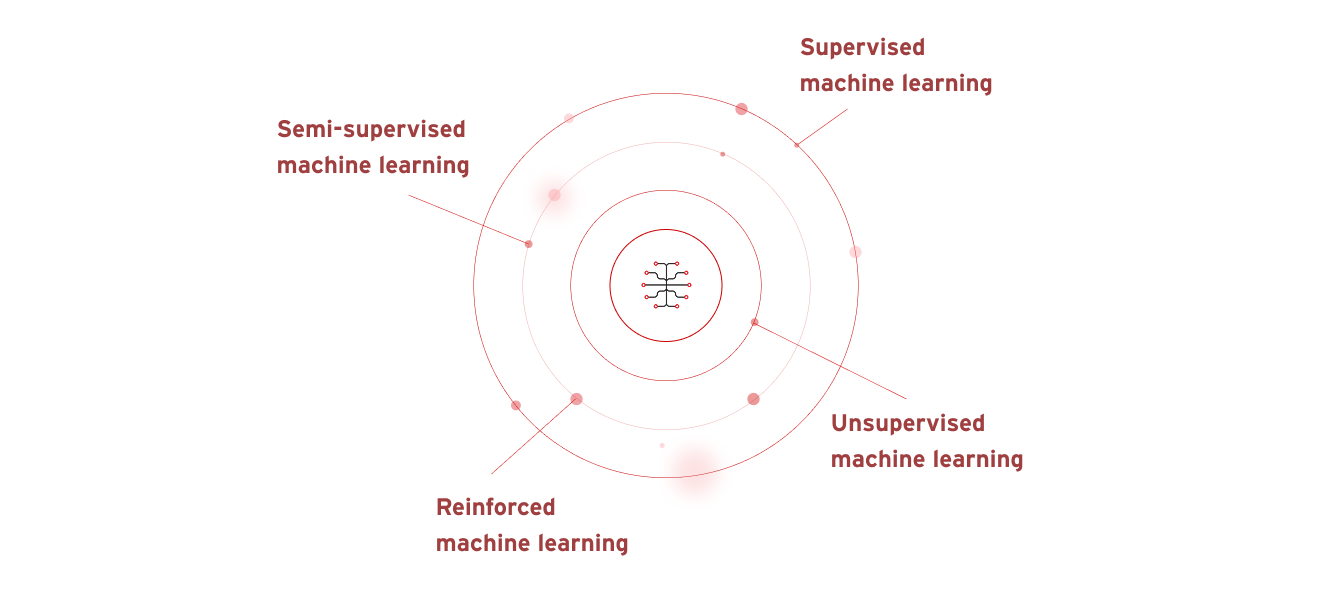

機器學習的基本原則

機器學習主要分為四種類型:

- 監督式機器學習:AI 使用已知、既有及已分類的資料集來發現模式,然後再將這些資料匯入演算法。

- 半監督式機器學習:AI 運用一個小型的已知且有標記的資料集進行訓練,接著將所學套用至較大型、未標記及未知的資料集上。

- 非監督式機器學習:AI 從未知、未標記、且未分類的資料集當中學習。

- 強化機器學習:AI 模型一開始並未使用任何資料集進行訓練,而是透過嘗試與錯誤的方式學習,並持續調整其行為直到成功為止。

機器學習使自駕車能夠因應環境變化,並將乘客安全送達其選定的目的地。其他機器學習應用程式則從影像和語音辨識程式、語言翻譯應用程式、角色導向 AI 代理程式、資料探勘到信用卡詐騙偵測、醫療診斷,以及社群媒體、產品或品牌推薦等等。

深度學習和神經網路

深度學習是一種機器學習形式,以進階神經網路為基礎,機器學習演算法可模擬人類大腦中的神經元如何運作,用於從大量資料中識別複雜模式。

例如,即使是非常年幼的孩子,也能立即分辨父母與其他成人,因為他們的大腦可以瞬間分析並比較數百個獨特或可辨識的細節,從眼睛和頭髮的顏色,到獨特的表情或臉部特徵。

神經網路會模仿人類大腦的運作方式,分析輸入資料中的成千上萬個細節,進而偵測並辨識它們之間更大的模式。生成式 AI (簡稱「GenAI」) 系統,如 OpenAI 的 ChatGTP 或 Midjourney 影像產生器,利用深度學習來擷取並分析大量的影像或文字,然後使用這些資料來產生新文字或影像,這些文字或影像與原始資料相似但不同的。

AI 的最新發展為何 ?

近年來,自然語言處理、電腦視覺、強化學習等領域的突破式創新,以及生成對抗網路 (GAN)、transformer 模型、真正具備 AI功能 的機器 (AIEM) 等尖端技術,已大幅擴大了人工智慧系統功能,可更仔細地模擬人類的智慧流程,產生更真實的內容,並執行日益複雜的工作。

機器學習與深度學習的突破

近年來,自然語言處理、電腦視覺、強化學習等領域的突破式創新,以及生成對抗網路 (GAN)、transformer 模型、真正具備 AI功能 的機器 (AIEM) 等尖端技術,已大幅擴大了人工智慧系統功能,可更仔細地模擬人類的智慧流程,產生更真實的內容,並執行日益複雜的工作。

機器學習與深度學習的突破

機器學習與深度學習演算法的革命性突破,讓研究人員和開發人員能夠打造出高度先進的AI系統,應用於各種真實世界的情境中。

例如,AI 聊天機器人每天都被數百萬家企業用來回答問題、銷售產品,以及與客戶互動。此外,企業也會運用 AI 演算法,根據客戶過往購物行為發掘趨勢,並且針對新產品、品牌或服務提供個人化推薦。

在自動語音辨識 (ASR) 領域,Siri 和 Alexa 等 AI 服務會使用自然語言處理 (NLP) 技術來將人類語音轉換成文字內容。同樣地,AI 驅動的「電腦視覺」神經網路技術的進步,讓人們更容易在社群媒體上標記照片,也讓自駕車更安全。

其他採用機器學習或深度學習的 AI 應用範例包括:自動化股票交易演算法、可在工廠或組裝線上重複執行任務的智慧機器人,以及運用機器學習來協助銀行偵測可疑交易並阻止金融詐騙。

人工智慧在網路資安領域的角色不斷演進

談到 AI 在網路資安領域所扮演的角色時,有兩個截然不同但彼此相關的面向需要考量:AI 防護 (AI security) 與 AI 驅動資安 (AI cybersecurity)。

AI 防護 (亦稱為 security for AI) 是指採用網路資安措施來保護企業的 AI 架構,降低或消除 AI 資安風險,並確保整個網路中所有AI系統、元件與應用程式的安全,涵蓋端點設備到AI模型。包括:

- 保護 AI 堆疊、基礎架構、模型及訓練資料,避免遭受攻擊

- 維持機器學習與深度學習流程中的資料完整性

- 處理 AI 偏誤、透明度、可解釋性以及其他倫理相關議題

確保 AI 的使用或開發完全符合所有相關法律、政策和法規。

AI 驅動資安 (AI Cybersecurity) 涵蓋了 AI 工具主動強化企業網路資安防護的所有不同方式,這些工具在速度、準確性與效能方面,遠超過人力資安團隊或資安營運中心 (SOC) 所能達成的水準。包括使用 AI 來:

- 即時識別網路威脅並防範網路攻擊

- 更快、更準確地消除防禦缺口與資安漏洞。

- 自動化威脅偵測與回應 以及其他資安工具,以加快事件回應速度。

- 強化威脅情資 ,以強化或支援更有效率的威脅管理。

- 將漏洞掃描 和資料記錄檔分析等例行作業自動化,讓網路資安團隊能專注處理更複雜的威脅。

AI 在資安中的應用範例

企業已經在多種情境中運用 AI 來提升資安防禦能力,例如偵測及回應網路攻擊,保護其網路免於各種網路威脅,例如資料外洩、分散式阻斷服務 (DDoS) 攻擊、勒索病毒、惡意程式、網路釣魚攻擊以及身分盜用威脅。

在威脅偵測及回應方面,AI 可偵測及預測網路威脅、分析活動記錄檔與網路流量的模式、認證及保護密碼與使用者登入、使用臉部辨識與 CAPTCHA 登入、模擬網路攻擊、掃瞄網路漏洞,以及建立自動化的網路資安防禦來防範最新或新興的威脅。包括以下工具:

- AI 驅動次世代防火牆 (NGFW)

- AI 資安事件管理 (SIEM)

- AI 雲端與端點防護系統

- AI 網路偵測及回應 (NDR)

- AI 延伸式偵測及回應 (XDR)

當攻擊發生時,AI 還可根據企業預先設定的政策和教戰手冊來提供有效的處置策略,或者自動回應資安事件。這有助於降低攻擊帶來的成本與損害,讓組織更快恢復運作。

AI 發展與應用中,有哪些需要考慮的倫理考量?

與其他類型的運算系統相比,AI 顯然提供了許多強大的優勢。但如同任何新技術一樣,AI 的發展、導入和使用過程,也有一些風險、挑戰和倫理問題需要考量。

偏誤與公平性

AI 模型是由人類使用既有內容所擷取的資料來訓練。這樣就有可能讓模型反映出或強化原始內容中隱含的偏見。這些偏見可能導致演算法、預測結果與決策出現不平等、歧視或不公平的情形。

此外,由於 GenAI 工具所產生的內容極具真實感,因此有可能遭到濫用或散播錯誤資訊、虛假訊息、有害內容,以及深偽 (deepfake) 的影片、音訊和影像。

隱私權疑慮

此外,AI 的開發和應用也伴隨多項隱私疑慮,尤其是醫療、銀行、法律服務等涉及高度個人、敏感或機密資訊的產業中。

為了保護這些資訊,AI 導向的應用程式必須遵守一系列關於資料安全、隱私與資料的良好作法。包括:採用資料去識別化技術、實施強化的資料加密機制,以及部署進階網路資安防禦來防範資料竊取、資料外洩以及駭客攻擊。

法規遵循

許多監管機構與法規框架,如歐盟一般資料保護規範 (GDPR) 要求企業在保護個人資訊、確保透明度和問責性,以及保護隱私方面,必須遵守一套明確的規則。

為了遵守相關法規,企業應確實制定企業層級的 AI 政策,來監控和管控用於建構全新 AI 模型的資料,並且保護任何可能含有敏感或個人資訊的 AI 模型,以免遭到駭客攻擊。

AI 技術的未來是什麼?

當然,我們無法精確預測 AI 的未來將發生什麼。但我們可以根據目前 AI 的應用和技術發展趨勢,還是可能針對未來發展做出一些合理的推測。

AI 研究的新興趨勢

在 AI 研究方便,自主 AI 系統、meta AI 和 meta 學習、開放原始碼大型語言模型 (LLM) 、用於風險驗證的數位分身與紅隊演練,以及人與 AI 聯合決策的創新,都可能徹底改變 AI 的發展方式。

複雜的新系統,如:混合式神經符號 AI (neuro-symbolic AI)、真正AI 賦能的機器 (AIEM) 以及量子機器學習等,也很可能進一步提升 AI 模型、工具和應用的能力與影響力。

另一項可能徹底改變 AI 運作方式的技術,就是新一代代理式 AI (agentic AI),這類AI具備自主決策與行動的能力,無需人類指示、監督或介入。

根據 Gartner 的預測,到了 2028 年,代理式 AI 就有可能參與多達15%的日常工作決策的。此外,代理式 AI 的使用者介面也可能變得更主動、更有個性,讓他們學習如何具備特定個性的『人類代理人』一樣行動,執行更複雜的商業任務、做出更重要的業務決策,以及提供更個人化的客戶建議。

AI 對員工的潛在影響

隨著 AI 提升營運效率並接手例行性工作,而像 ChatGPT 和 Midjourney 這樣的 GenAI 引擎日益強大且普及,因此對於許多產業的工作可能帶來的衝擊,仍有相當程度的疑慮。

但如同過去的網際網路、個人電腦、手機以及其他顛覆性技術出現一樣,AI 也很可能創造了新的機會,甚至催生出全新產業,進而創造對專業人才的需求。

因此,與其說面臨的是工作消失的問題,更大的挑戰可能是如何有效培訓員工以把握新興機會,並協助他們順利轉型。

AI 在因應全球性挑戰時所扮演的角色

除了提升營運效率與強化資安防護之外,AI 也有機會協助解決當今人類所面臨的一些最大挑戰。

在醫療領域,AI 能協助醫師更快且更準確地診斷、追蹤未來疫情的傳播,並加速新藥物、治療方法和疫苗的研發。

AI 技術可提升對天然災害、人為災難以及極端天氣的緊急應變速度與效率。

此外,AI 還能協助因應氣候變遷,將再生能源的使用最佳化、降低企業碳足跡、追蹤全球森林砍伐與海洋污染情形,以及提升資源回收、水處理與廢棄物管理的效率。

其他可能的趨勢和發展

AI 未來其他可能的發展趨勢、功能和應用包括:

- 大型語言模型 (LLM) 防護,保護 LLM 免於惡意攻擊、濫用、未經授權的存取以及其他網路威脅。包括保護 LLM 資料、模型以及相關系統與元件的防護措施。

- 個人化、以使用者為中心的 AI,提供更客製化、更智慧的個人化服務,包括電子郵件端點行銷。

- 運用 AI 模型執行紅隊演練與數位分身模擬,模擬對企業 IT 系統的攻擊,進而測試並修補系統漏洞。

我可以在哪裡獲得 AI 和網路資安的協助?

Trend Vision One™ 以單一整合式的 AI 平台,為整個 AI 技術堆疊提供無可匹敵的端對端防護。

Trend Vision One 採用全球首款主動式資安 AI——Trend Cybertron 的強大功能,內建一系列具代理能力的 AI 特性,能根據真實世界的威脅情報與資安營運持續進化。

這使其能迅速因應新興威脅,強化企業整體資安防禦力、提升營運效率、將資安營運從被動變成主動,並且保護 AI 基礎架構的每一層。

Fernando Cardoso 是趨勢科技產品管理副總裁,專精於不斷演進的 AI 與雲端世界。在他職業生涯的一開始,曾擔任過網路與銷售工程師,磨練了他在資料中心、雲端、DevOps 以及網路資安領域方面的技能,而這些領域至今依然能持續激發他的熱情。

常見問題 (FAQ)

何謂 AI?

人工智慧 (AI) 是一套運用科技來模仿人類思考、運作及決策方式的電腦。

AI 到底在做些什麼?

AI 模型使用複雜的演算法,並利用大量「學習到的」資訊來計算使用者問題的答案,或者根據使用者的提示生成內容。

Siri 是人工智慧嗎?

Siri 是一種簡單的 AI 形式,使用機器學習和語音辨識等技術來了解並回應人類說話的內容。

AI 是好還是壞?

如同所有技術一樣,AI 本身並無所謂好壞,它是一個可用於正面和負面用途的工具。

AI 的主要目標是什麼?

AI 的主要目標是讓電腦做出更聰明的決策、完成更困難的工作,並且從經驗中學習而不需持續的人為介入。

為何要開發 AI?

AI 的開發目的是為了協助將重複性工作自動化、解決複雜的問題,以及協助不同產業從事更進階的研究與創新。

AI 有哪些風險?

AI 帶來的一些風險包括:偏誤與公平性、隱私權風險、網路資安風險,以及工作被取代的可能性。

AI 是由誰開發的?

電腦科學家 Alan Turing (1912 – 1954 年) 和 John McCarthy (1927 – 2011 年) 一般被視為非正式的「人工智慧之父」。

現實生活中有哪些 AI?

我們的日常生活中有許多 AI 的範例,從智慧型手機上的軟體、到回答客戶服務常見問題的聊天機器人。

什麼是簡易的 AI?

一些簡易的 AI 範例包括:Siri 或 Alexa 之類的語音助理、Google 智慧型搜尋引擎、客戶服務聊天機器人,甚至是掃地機器人。

AI 有什麼缺點?

AI 的缺點包括:隱私權與偏誤、網路資安風險,以及某些領域的工作被取代。

AI 的五大缺點是什麼?

視其使用方式而定,AI 可能造成失業、生成錯誤資訊、洩露私密資訊、減低創造力,以及過度仰賴技術。

如何開啟 AI?

大多數的 AI 工具都可以在手機、電腦、軟體應用程式或網站的設定功能中開啟或關閉。

我可以免費使用 AI 嗎?

許多 AI 工具,如搜尋引擎或 Alexa 都是完全免費的,其他則同時提供免費和付費版本 (如 ChatGPT)。商業級 AI 通常需要付費使用。

哪些 AI 完全免費?

絕大多數的 AI 廠商都提供免費的入門版本,包括:Microsoft Copilot、Grammarly、Google Gemini 以及 ChatGPT。

目前最熱門的 AI 應用程式是什麼?

目前最熱門的 AI 應用程式有 ChatGPT、Google Maps、Google Assistant、Microsoft Copilot 和 Google Gemini。

大家都在使用的 AI 寫作應用程式有哪些?

一些最熱門的 AI 輔助寫作應用程式包括:Grammarly、ChatGPT、Wresonic、Jasper 和 Claude。

大家都在使用的免費 AI 應用程式有哪些?

Google Gemini、Microsoft 的 Copilot 以及 ChatGPT 都是目前最普遍使用的免費 AI 應用程式。

目前最棒的 AI 聊天機器人是哪個?

所謂的「最棒的」聊天機器人取決於您的需求而定,但一些最受歡迎的 AI 聊天機器人包括:Perplexity、Google Gemini、Jasper 和 ChatGPT。

AI 在日常生活中的範例有哪些?

日常生活中常見的 AI 範例包括:智慧型手機、AI 搜尋引擎、客戶服務聊天機器人,以及 Siri 和 Alexa 這類數位語音助理。